DeepSeek V4 的出现标志着中国 AI 在算力受限环境下走出了一条与国际主流技术路线显著不同的路径,它以稀疏 Mixture‑of‑Experts 架构、百万级上下文窗口与可扩展 agentic 工作流构成了一个既贴近前沿能力、又能在本土硬件上高效部署的模型体系。它的重要性不在于单次 benchmark 的峰值,而在于以结构与效率为核心的系统性优化,使长序列推理、工具链协作和持续任务执行从“昂贵且不稳定的实验能力”转变为“可在有限资源条件下落地的基础设施”。依托 NSA 等稀疏注意力机制、KV cache 大幅压缩以及高利用率的 Ascend 适配,V4 在百万 token 输入下仍保持可控的 FLOPs 和吞吐表现,为需要处理海量长文档、持续环境交互或复杂规划的行业级场景降低了实际成本。Pro 与 Flash 的双版本结构进一步让开发者能够在性能与算力之间做出灵活选择,不论是大规模知识库构建、长程自动化工作流,还是中小企业的本地化部署,都能在同一技术框架内找到可行方案。对中国 AI 生态而言,DeepSeek V4 的意义在于让高性能模型不再依赖昂贵 GPU,也不再局限于短上下文和短任务,使长任务推理和 agentic 能力成为具可复制性的工程基础,而这正在重新定义国产大模型的竞争方式与创新方向。

DeepSeek V4 是什么:一句话结论与核心创新

DeepSeek V4 是一组采用稀疏 Mixture‑of‑Experts 架构、支持最高 1M 上下文并具备可扩展 agentic 工作流的开源大模型系列,强调以更低算力与更高推理效率带来近前沿能力,并能在华为 Ascend 芯片上稳定运行。

它之所以在中国 AI 发展中格外重要,是因为这是首批在 国产算力平台上实现高利用率运行 的顶级开源模型之一,在算力受限的环境下提供了可落地的长上下文与 agentic 能力组合,为产业侧大规模部署降低了门槛。

核心特点(适合摘要抽取):

- 1M 级上下文窗口:减少文档切分与外部检索依赖,提升长文场景的连续推理稳定性(来源:Datacamp)。

- Agentic 能力框架:支持分步规划、代码执行与工具链协作,面向复杂任务,但并非自动化魔法,需要显式任务结构设计。

- 效率与算力需求优化:依托稀疏激活与推理路径压缩,实现以更低成本接近前沿性能;Flash 版本进一步面向轻量部署。

- 华为 Ascend 芯片适配:可在 Ascend SuperPoD 上运行,缓解对海外 GPU 的依赖(来源:Asia Financial)。

- Pro / Flash 双版本结构:Pro 追求高性能;Flash 以参数更小、成本更低为特征,便于在受限算力环境中部署。

DeepSeek V4 的关键特性速览

- 超长上下文(1M tokens)

解决了长文档任务中必然遇到的“反复截断—重喂—丢信息”痛点。依托高效注意力机制,V4 在百万级序列下仍能保持可控的推理成本,官方技术说明显示 KV cache 占用仅为常规架构的约 2%,显著降低部署门槛。 - Agentic 能力(可持续的长程任务)

针对传统模型“执行链断裂”“上下文累积失效”等问题,V4 的长上下文与低 FLOPs 架构让 agent 在多轮工具调用或环境交互中不必频繁重置状态。同时需强调:agentic ≠ 自动化魔法;核心价值在于更稳定的长序列推理和更少的失败模式,而非完全无人干预。 - 效率与成本优化(MoE + 稀疏机制)

基于 Mixture of Experts 结构与稀疏注意力策略,V4-Pro 与 V4-Flash 在推理时仅激活少量参数,实现高性价比与低延迟。独立测试报告指出其在近前沿性能下提供极具竞争力的定价,对需要大上下文但预算有限的开发团队尤为友好。 - 华为 Ascend 芯片适配

V4 在 Ascend 上可达到高利用率,有助于在非 Nvidia 环境中保持稳定吞吐。这缓解了供应链受限地区的训练与部署压力,特别适用于本地化算力集群。相关报道表明其可在 Ascend SuperPoD 全系上运行。 - 版本差异(Pro vs Flash)

• V4-Pro:1.6T 总参数、49B 活跃参数,面向高强度长上下文与复杂推理场景。

• V4-Flash:体积更小、13B 活跃参数,成本敏感任务的更优选择,仍拥有完整的 1M 上下文能力。

这些特性共同指向同一目标:在资源弹性、长序列推理与 agent 工作流中提供可实际部署的性能,而非单纯追求峰值指标。

架构、上下文与效率:DeepSeek V4 的技术路线为何不同

DeepSeek V4 的技术路线核心在于“高效支撑超长上下文”和“面向 agent 的稳态推理”,而不是一味堆叠参数量。这条路径由两部分构成:一种能保持长序列可计算的整体架构思路,以及一套显著降低推理成本的效率机制。

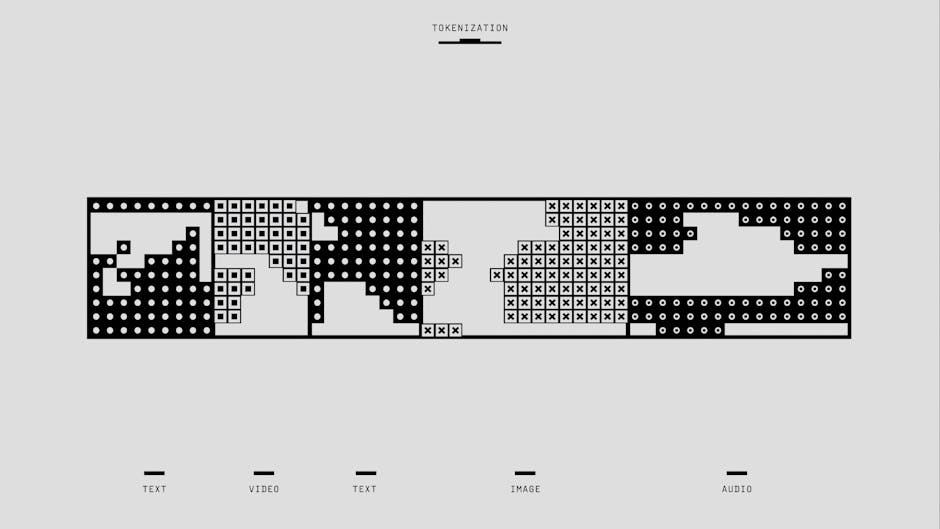

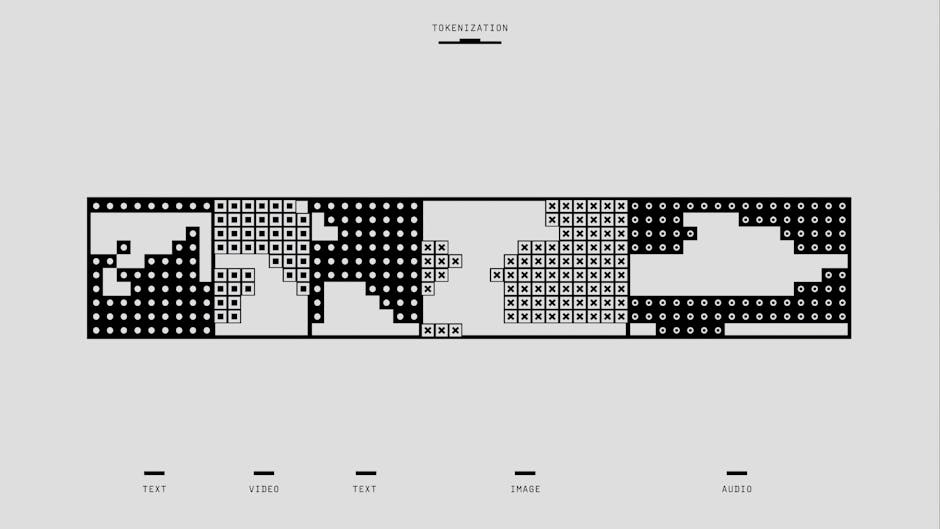

在架构层面,V4 通过多种稀疏注意力与分工式机制来承担 1M-token 的上下文量。公开资料显示,模型使用了 Mixture-of-Experts 结构,并结合了诸如 Neighborhood-based Sparse Attention(NSA)与 SPCT(一种长上下文优化的 Transformer 变体)等方法,以限制注意力计算只聚焦于局部或必要的区域,从而在“长序列但高实时性”的场景下维持稳定吞吐。例如,NSA 通过邻域稀疏化显著降低显存与计算量,使其在资源有限的环境中仍能支撑百万级输入,这一特点对中国本地算力体系尤其关键(如国内芯片的 FP8 支持与深度优化)。

效率提升机制则更为直接:减少推理路径长度、降低单位 token 的计算成本、压缩 KV cache。根据公开技术报告的分析,DeepSeek V4 在百万级上下文下的单 token FLOPs 仅为上一代的约三分之一,KV cache 占用也显著下降,这类改动对长时运行的 agent 特别重要。长任务的瓶颈往往不是算力本身,而是 KV cache 随时间线性膨胀导致的 GPU 内存耗尽;V4 将这一痛点压低到可在单机或中小规模集群上跑通的水平。

一个典型受益场景是文档级任务:例如让 agent 对 1500 页 PDF 建立知识索引,再执行跨章节一致性检查。传统模型需要频繁 reprompt、截断上下文、甚至分段推理拼接结果;V4 则可以保持任务连续性,使 agent 的“思考轨迹”不被上下文限制截断。这并不意味着“上下文越长越好”——长上下文如果缺乏检索策略,仍会带来噪声累积和无效注意力;V4 的意义在于把“有能力使用长上下文”变成一个稳定、可控的基础能力,而非偶然可用的边缘功能。

总体来说,DeepSeek V4 在中国 AI 体系中代表了一条务实的技术路径:围绕算力约束和长任务需求,优先优化结构与效率,而不是追求纯规模。这种取向让模型在 agentic 应用中具备了可长期运行、可扩展的工程化特征。

1M 上下文窗口的实际意义

在实践中,百万级上下文并不是“能放更多字”这么简单,而是直接决定模型能否在长链条推理里保持连贯性,尤其是当任务跨越多个文档、多个阶段或多个工具调用时。长上下文让模型在每一步推理中保留更完整的状态,无需频繁重置,减少因遗忘早期信息而产生的偏差。对于需要跨文档整合的任务,例如比较两份相隔数百页的合同条款,1M 窗口让模型可以直接在全局语境下判断冲突条款,而无需人工分段喂入或反复提示。

一个典型 mini case 是企业合规审核:内部可能包含十余份合同、邮件往来与政策文档。过去模型很容易在多轮推理中遗失上下文,或者因为 KV cache 爆满而中断,而基于更高效压缩与稀疏选择的长上下文机制(在 Hugging Face 的分析中有详述:https://huggingface.co/blog/deepseekv4)让这种大规模整合可以一次性完成。同样的模式也适用于大型代码库的审计,模型能够在一次会话中跨越数十万行代码追踪依赖链,而无需开发者不断维护状态。

当然,这并非“上下文越大越好”。更长的窗口意味着更高的显存占用与推理成本,无论在本地还是云端都需要评估预算。对于高度局部的任务(如仅分析单个函数或短篇文档),使用百万级上下文不会带来明显收益,甚至可能增加延迟。理想策略是在任务规模、成本与需要的跨文档深度之间做平衡:当你确定任务需要在长流程中保持一致逻辑、或必须一次性吸收极大量材料时,1M 上下文窗口才真正发挥价值。

高效率推理:低算力时代的中国路线

降低算力需求对开发者和企业最直接的价值是把可用模型从“理想能力”变成“可落地能力”。在资源受限的场景(本地 GPU 不足、云端预算有限、需要海量并发)中,推理效率往往比峰值基准更能决定整体可行性。DeepSeek V4 在这一点上强调得很明确:Flash 版本在许多简单 agent 工作流中能与 Pro 表现接近,同时以更低的缓存命中/未命中成本运行,这一点在公开说明中已有披露,例如其输入侧百万级 token 计费显著低于多数同规模模型。这种定价结构让“扩一个工作流”变得比“扩一台机器”更现实。

从应用侧看,效率的收益具体体现得更明显。

在轻量化部署场景中,工程团队可以把 V4-Flash 放在中档 GPU 上处理日常的工具调用任务,如文档转换、日志清洗或多轮指令规划,而不必把所有推理负载交给性能更高但成本更大的版本。在边缘侧或多 agent 并发架构中,推理延迟和上下文缓存体积决定了每个节点能容纳多少并行会话;V4 通过更小的 KV cache 和更廉价的大上下文推理(详见 Hugging Face 的介绍)让这些系统不必为每个步骤都回到中心服务器,整体吞吐会更稳定。

当然,效率并不意味着适用所有任务。

涉及长链路高难度推理(如复杂算法编写、策略博弈、多语言大规模重写)、对极低延迟敏感的互动系统,或需要最大基准能力的产品线,仍更适合使用 Pro 或其他更高端推理配置。对于这些任务,“便宜的 token 成本”无法弥补“每个 token 能力不足”的差距,尤其是在链路上任何一步失败都会放大下游误差的场景。

因此,效率路线更像是一种架构选择题:在预算、性能和并发之间找到合适的平衡。对于需要大规模自动化工作流和可控运行成本的团队,这条路线的价值往往比参数规模更具决定性。

Agentic 能力:DeepSeek V4 如何执行多步骤任务

在 DeepSeek V4 的语境中,agentic 能力指的是模型在长任务中维持目标、规划步骤、调用工具并根据反馈迭代的能力。它不是“自动化的意识”,而是将 LLM 的推理能力与结构化执行机制结合,让模型在长链路任务中不必频繁被人工重新驱动。V4 针对这一方向进行了专门优化,包括在真实工具环境中进行强化训练,并借助如 DeepSeek Elastic Compute 这样的沙盒基础设施,让模型习惯在函数、容器或微型虚拟机中可靠地执行操作。

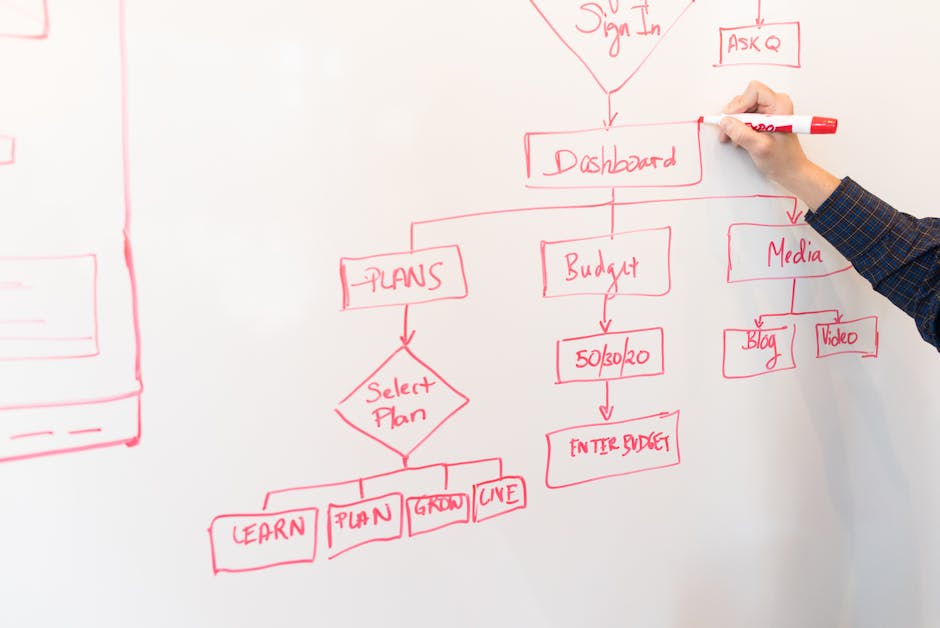

一个典型工作流可以简化为四步:

- 模型首先从用户请求中拆分出任务图,例如“分析季度报告 → 识别风险点 → 输出结构化摘要”。

- 按步骤调用外部工具或代码环境,如通过容器执行解析脚本、检索数据、生成中间结果。

- 读取执行结果后更新计划,再决定下一步是否继续分析、补充材料或校验异常。

- 最终生成稳定格式的输出,如 JSON 摘要或复盘笔记。

实际使用中,常见误解是将 agentic 与完全自治混为一谈。V4 的设计仍然依赖开发者设置目标、提供工具接口、定义安全边界;模型不会自行推断权限或无限延长任务链路。

在工程环节需要特别注意几点边界条件:

- 错误传播效应:一旦早期步骤的结构化数据偏离预期,后续所有推理都可能偏航,需要在关键节点加入校验器。

- 上下文积累压力:即使 V4 针对长任务做了改进,长链路工作流仍容易在未清理中间状态时膨胀上下文,最好设计显式的“状态快照”或摘要机制。

- 工具调用的透明度:确保返回结果具备可解析结构,否则模型可能误判执行是否成功。

在这些约束下,V4 的 agentic 能力更像是一个可编排的智能执行器,擅长中长链条、工具密集型任务,但仍需要开发者为其定义可靠的轨道与护栏。

Agentic 工作流示例:从规划到执行

理解 DeepSeek V4 的 agentic 能力,最直观的方法是看它如何在一个任务中自行规划、调用工具并验证结果。下面以“根据产品日志生成周报并检查异常指标”为例,用 6 步展示一个常见的 agentic 流程。

- 任务解析(Task Parsing)

模型先分析输入的业务目标,例如“根据过去一周的访问日志,生成一份结构化周报并找出明显异常”。它会将目标拆成若干可操作的子任务,例如获取数据、筛选异常、生成总结等。 - 步骤规划(Plan Generation)

V4 会生成一个带约束的计划,通常包含输入依赖、工具需求与预期输出格式。可用的伪结构如下:

PLAN:

- step: loadlogs

- step: detectspikes

- step: summarize

- step: verify_output- 工具调用(Tool Invocation)

当需要文件、数据库或脚本结果时,模型会根据步骤自动选择工具。例如在 detect_spikes 环节,它可能调用内部统计模块:

toolcall:

name: stats/spikedetector

args: {threshold: 3σ}Agentic 能力的关键在于模型能判断何时需要外部计算,而不是全部依赖语言推理。

- 中间结果评估(Intermediate Checkpoints)

每个步骤后,V4 会判断结果是否合理,例如 spike_detector 返回的峰值数量是否在历史区间内;如果相差过大,模型可能回滚到前一步重新设定参数。

这里经常出现失败点:异常数据格式、工具调用失败、结果不满足约束。一个常见测试方法是注入坏数据(如缺失字段)观察模型是否能自恢复。 - 任务执行修正(Self‑Correction)

若发现异常,例如“检测出的峰值为 0,但日志量激增”,模型会自动调整策略:

- 换用更宽松的阈值

- 切换到备选分析工具

- 请求用户确认数据源

这一阶段是验证 agentic 是否真正“自主”的关键。

- 最终输出组合(Result Assembly)

当所有检查点都通过后,模型将中间数据组合成最终周报,包括趋势图描述、异常解释与建议。若用户需要可追溯性,还能输出完整的执行轨迹,便于审计或调试。

通过这种流程,可以系统地评估 agentic 功能的可靠性。实践中建议将每一步独立做压力测试,例如模拟工具响应延迟、注入随机错误,观察模型是否按预期回滚或修正。

在华为芯片上的表现:现实能力与限制

DeepSeek V4 宣布能够在华为 Ascend 系列芯片上运行,这一点已被公开报道,例如 DeepSeek 表示模型已适配华为 Ascend,并得到华为全系 SuperPoD 的支持(见 Asia Financial 的报道)。这一适配不仅影响推理部署的可行性,也关系到企业在国产算力环境中的长期规划。

本节将从技术验证角度,概述 V4 在国产硬件上的部署意义,包括

- 为什么 Ascend 适配成为商业与研发场景中的关键因素;

- Ascend 可能带来的推理效率与成本优势,以及硬件峰值差异导致的潜在限制;

- 哪些本地化场景更可能从国产芯片部署中获益;

- 当前公开信息的边界,以及仍未披露的实现细节。

后续小节将进一步拆解这些取舍与评估方法,帮助读者掌握在实际架构中如何进行算力与性能决策。

本地化部署的取舍:算力、成本与性能平衡

在评估是否将 DeepSeek V4(含 Pro/Flash 版本)落地到华为 Ascend 芯片时,一个可靠的分析框架仍然是算力、成本和延迟三要素。Ascend 910B/950 已在官方渠道中被证实与 V4 有较高适配度,并且在推理阶段可达到 80% 以上的有效利用率,这一点在多方报道中均有提及,例如 DeepSeek 宣称已将 V4 调整为可在 Ascend 芯片上运行(见 Asia Financial 的报道:DeepSeek says new V4 can run on Huawei chips)。因此,问题不在于“能不能跑”,而在于“是否值得在你的业务结构中本地化部署”。

1. 算力:峰值性能不是全部

Ascend 的原始峰值算力与高端 Nvidia 卡仍有差距,但 V4 在推理路径上的 kernel 已做过针对性优化,使其在实际吞吐下相对接近。即使如此,团队在评估时仍需要关注:

- 批处理大小是否受限;

- 模型并发量是否会触及系统 IO 或内存带宽瓶颈;

- 是否需要重新调整已有的离线/在线混合架构。

适配成本主要来自工具链迁移(算子替换、调试、稳定性回归测试),迁移本身比算力差距更实际地影响时间成本。

2. 成本:硬件账单与能耗往往更关键

多个行业消息称,Ascend 的硬件成本与同级推理集群相比有明显优势,但实际节省多少取决于:

- 集群规模(小规模部署的成本下降比例通常不如大规模部署明显);

- 维护团队是否已有 Ascend 生态经验,否则初期人力成本会上升;

- 使用 V4-Pro 还是参数更少、成本更低的 V4-Flash(后者在 Asia Financial 报道中被描述为更“高效、经济”的版本)。

对于需要长期、大规模推理的企业(如推荐系统或海量知识库检索),成本优势更容易体现。

3. 延迟:本地化带来的真实体验差异

延迟通常是本地化部署的最大卖点,但需要对业务模式进行拆解:

- 在线问答类场景:延迟主要取决于单次推理的算子执行效率与调度路径,Ascend 已可满足大部分中等规模在线推理,但极限低延迟业务仍需验证。

- 批量生成类任务(总结、结构化抽取):延迟敏感度低,本地化的价值来自成本和隐私。

- 内部知识库推理:这是最常见且最适合的场景。数据不出域、成本可控、负载可预测,Ascend 的稳定性要求也较容易满足。

一个典型案例是企业内部的文档检索与摘要:模型需要读取公司文档、本地知识图谱,以中等速率生成摘要。此类任务通常 CPU/GPU 混合部署亦可,但在 Ascend 上部署可在同等预算下提升并发数,同时避免跨境云资源的合规问题。

常见误判(值得避免)

- 假设 V4 在 Ascend 上与 Nvidia 的推理性能“完全等同”;

- 认为只要模型适配成功,整个工具链(训练、微调、监控)就能无缝迁移;

- 忽略小规模集群的运维成本,导致成本预期过度乐观;

- 过度依赖未经验证的第三方性能对比表。

从工程视角看,是否部署到 Ascend,不是性能单指标的选择,而是工程成本、合规约束、长期迭代路线和工具链控制力的综合权衡。企业应优先通过小规模 PoC 验证自己的调度逻辑、模型负载模式和业务延迟目标,再决定是否扩大投入。

DeepSeek V4 Pro vs Flash:如何选择与应用场景对齐

这一部分为读者建立一个决策框架,用以理解 V4 Pro 与 V4 Flash 在目标定位、速度/质量取向以及典型使用方式上的根本差异。重点不是给出简单的“哪个好”,而是说明两者在架构规模、任务深度、推理密度与实际工作负载上如何形成不同的取舍,并帮助读者快速判断自身任务是更偏向高质量分析、还是更需要高吞吐量与低延迟。

接下来的小节将进一步给出基于任务类型的匹配策略,展示在不同工作流(如快速应答、长文档处理、推理密集任务、工具链集成)下如何做出稳健的选择。

选择指南:按任务类型匹配合适版本

在实际项目中,选择 Pro 还是 Flash 往往不是“更强 vs 更弱”的问题,而是“任务结构与资源约束是否匹配”。下面按常见工作负载分成四类,并给出可直接套用的匹配逻辑。

1. 快速应答类任务:Flash 更稳妥

如客服自动回复、轻量检索问答、运营文案草稿生成。此类任务通常要求低延迟、高并发,且问题结构清晰,推理深度有限。Flash 的小型化 MoE 设计(13B active)在这些场景下能保持响应迅速,同时控制成本。实测基准中 Flash 的平均任务时长低于 Pro(见 FundaAI 基准),符合高频场景的吞吐需求。

常见误选:为了“保险”使用 Pro,但生成速度反而拖慢交互体验。

2. 长文档与大输入处理:两者都能胜任,但策略不同

两者均具备 1M-token 上下文窗口(如在人工分析中所示的 超长上下文能力),关键差别在于你的目标:

- 需要高精度跨文档推理、结构化抽取、跨章节一致性:倾向 Pro。

- 需要高吞吐的批量长文档摘要或代码库预处理:Flash 更经济。

常见误选:把 Flash 用在复杂跨章节推断,得到表面准确但缺乏全局一致性的回答。

3. 推理强化类任务:优先 Pro

包括系统设计评审、多步骤数学推导、生成可执行计划等。Pro 在多项真实任务评测中于 Agentic 工作负载上占优,例如其在人工分析测试中位居开放权重模型前列。较高的 active 参数量让 Pro 在“链式推理 + 多轮验证”模式下更稳定。

常见误选:希望 Flash 通过“thinking 模式”弥补推理差距,但遇到深度推理链仍可能出现早停或局部错误。

4. 工具链集成与自动化流水线:以 Flash 为默认,Pro 为关键节点

自动化流程通常包含多个工具调用步骤,如检索 → 结构化理解 → 模型调用 → 外部 API 操作。Flash 的速度与低成本非常适合作为默认执行器;但当某个步骤输出会被后续大量复用(如生成统一决策报告或推断关键变量),使用 Pro 进行一次“重计算”能提升整体稳定可靠性。

常见误选:全链路使用 Pro,导致成本与延迟不成比例上升。

总体建议:先按任务的“推理深度—延迟敏感度”二维来定位,再根据吞吐与成本约束做微调。这种方式比“哪个更强”更贴近实际工程选择逻辑。

开发者指南:集成、API 思路与常见陷阱

集成 DeepSeek V4 的流程与主流 LLM API 相似,但要真正稳定跑在生产环境,仍需要关注身份管理、长上下文处理方式与 agentic 请求的状态控制。官方文档强调兼容 OpenAI/Anthropic 风格,并在多轮对话、工具调用与 1M 长上下文上做了优化,这为开发者减少了迁移成本,但也意味着一些新的陷阱需要提前规避。

典型的使用路径通常包括三步:

1) 身份与密钥管理:在控制台生成密钥后,将其以环境变量的形式注入运行环境,避免硬编码。密钥只展示一次的机制也在官方平台中被强调,换用新密钥应立即废止旧密钥。

2) 构造请求与上下文管理:DeepSeek V4 延续 ChatCompletions 结构,常见字段包括系统指令、用户内容与可选的工具调用设定。长上下文场景中,建议将上下文拆分为“指令区 + 文档区 + 当前任务区”,便于模型在 1M 窗口内保持信息优先级。

3) 处理响应与状态:对于 agentic 模式(例如需要模型分步规划),关键在于明确“每步输入”和“中间状态”的边界,避免让模型在隐藏状态中积累无关信息。

下面的伪代码示例展示两个常见模式:长上下文一次性推理与带步骤的 agentic 指令。结构与 DeepSeek 官方 API 说明 中保持一致,但不包含真实 endpoint。

# 长上下文示例

ctx = loadlargedocument() # 文档预处理并按章节切分

messages = [

{"role": "system", "content": "你是负责技术总结的助手。"},

{"role": "user", "content": f"以下是文档,请总结关键决策点:\n{ctx}"}

]

resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=messages,

stream=False # 长输出可换用流式

)

print(resp.choices[0].message["content"])# agentic 模式简化示例(分步规划)

planresp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "逐步推理,但每步只输出计划。"},

{"role": "user", "content": "为这段代码生成重构策略。"}

]

)

plan = planresp.choices[0].message["content"]

exec_resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "依据用户计划执行相应代码转换。"},

{"role": "user", "content": plan}

]

)常见错误也集中在上下文规模与状态管理:

- 上下文溢出:虽然模型支持超长输入,但不意味着可以直接堆砌未处理文本。未结构化的长输入会导致内容重要性“漂移”,表现为总结不聚焦或多轮对话偏题。将长文本分段、加标题或使用摘要链式结构通常更稳健。

- 对话状态过度累积:长线程容易积累噪声,导致模型“重复”“卡住”,在一些案例中简化约束或清空历史能显著改善输出,这与社区经验一致。

- 约束冲突:同时给模型多组互斥规则,会导致思维模式混乱,尤其在 thinking 模式下更明显。

为了验证是否正确集成,可采用一个可复现的小测试流程:

- 构造一个 短上下文 + 长上下文 的对照组,比较两者输出一致性,验证分段策略是否生效。

- 发送一组固定提示(如“总结三点、保持格式稳定”)测试模型在五次调用中的格式漂移情况。

- 对工具调用或链式思考的任务,观察第一步和第二步之间的“状态泄漏”——并非所有模型都处理得一致,DeepSeek V4 在这类任务上则提供了相对稳定的分步响应,但仍需明确边界。

遵循这些流程可以显著降低集成风险。开发者如果来自其他兼容 API(例如 SeedDance 或 glm 系列),迁移路径通常较平滑,这一点在一些开发者分享与第三方说明中也被提到,例如 SIIT 的集成经验。

集成示例:如何构建一个长文档问答服务

要在实际系统中利用百万级上下文构建长文档问答服务,一个可行的最小流程通常包含四个环节:数据准备、切片与索引、上下文注入策略、以及响应解析与结果合成。下面的示例基于模型在长上下文中“信息优先级会发生变化”的经验判断,这一点在多份开发者笔记中被强调,尤其是当输入内容结构混乱时模型更容易偏离用户预期(示例可见 这篇分析长上下文误区的文章)。

- 数据准备

先将原始文档从 PDF、HTML 或内部知识库中抽取为纯文本,并进行轻量清洗,例如移除页眉页脚、多余换行和重复段落。目标是在不损失语义的前提下减少“噪声 token”。 - 文本切片与索引

将文本以段落或语义块为单位切片。例如按 800–1200 字符一段,同时保留原始位置索引。这样做可以在后续检索阶段快速定位候选片段,避免整篇文档直接塞入上下文导致成本膨胀。 - 上下文注入与请求构造

构建请求时将用户问题与检索到的候选片段拼接到模型上下文中。保持结构化格式尤为重要,能降低模型在长提示中“优先级漂移”的概率。下面是一个不含任何真实地址或密钥的伪代码示例:

POST /v4/completions

{

"model": "deepseek-v4-pro",

"messages": [

{ "role": "system", "content": "你是文档问答助手。" },

{ "role": "user", "content": "问题: <userquestion>" },

{ "role": "assistant", "content": "相关文档片段:\n<chunk1>\n<chunk2>\n..." }

],

"maxtokens": 800,

"temperature": 0.2

}一般做法是同时注入“任务约束”与“上下文来源标签”。保持各段清晰标注,能减少模型在长文本里误解来源或混合片段的风险。

- 响应解析与合成

返回结果后,需要解析模型回答、提取引用的段落位置,必要时将答案与“可信片段”匹配再返回给用户。如果模型出现重复或卡住的现象,清理上下文或减少冲突指令通常能改善表现(参见上面链接的故障排查建议)。

关键注意事项:

- 成本控制:即使具备百万级上下文,也不意味着所有请求都应塞满。每增加一段文本都会增加推理成本,应优先使用高相关片段。

- 上下文相关性:长上下文中,模型对段落优先级的判断可能随输入规模上升而变化,因此要尽量保证“越靠后越重要”的结构避免被稀释。

- 提示结构化:保持片段清晰编号、范围标注,是缓解长上下文质量衰减最实际的工程手段之一。

这个最小示例足以让读者理解长上下文的真实使用方式,后续可根据业务规模加入缓存、检索加速或分布式服务等优化。

局限性、已知问题与风险边界

DeepSeek V4 在长上下文与多步推理上具备明显进展,但这些能力也伴随新的工程代价与使用边界。超长上下文会带来额外延迟,并在极端情况下出现信息优先级漂移,正如部分用户在讨论中提到的,当输入越庞杂、越无结构,模型越可能出现质量衰减或重复性输出(相关案例可见在关于模型误用的讨论中,例如对长文本堆叠导致模型“卡住”或输出退化的分析)。同时,agentic 工作流虽然能够长时间自主运行,但任何一步的误判都可能在后续步骤中被放大,形成“错误链式扩散”并累积成本。

在企业侧部署时,应将这些限制视为可管理的风险,而非禁用理由。本节将提出一个适用于生产环境的检查清单,包括上下文预算的规划、延迟与开销监控、agent 工作流的边界设定,以及针对关键节点的可观测性建设。随后的小节将进一步拆解稳定性、安全性与一致性方面的具体风险点,并给出工程化的缓解策略。

安全性与一致性:开发者需要监控的关键点

在长上下文和多步骤推理成为主流后,V4 的稳定性问题不再是“偶尔卡住”这种浅层体验,而是涉及规划一致性、上下文优先级偏移,以及 agent 在长任务中的行为可控性。以下是生产环境最值得盯紧的几类风险,以及相应的工程化缓解手段。

1. 上下文漂移(Context Drift)

在百万级上下文中,模型会根据内部优先级机制动态压缩与重排信息。当输入组织不当时,V4 可能对早期指令“遗忘”或弱化,最终导致推理路径偏离目标。根据实践经验,不结构化堆叠文本尤为容易触发这一问题。

缓解策略:

- 将长文档进行主题化切片,按意图分段注入。

- 用摘要与显式指令“重申关键约束”,降低模型优先级误判风险。

2. 幻觉与链式扩散(Hallucination Cascade)

在 agentic 任务中,前一步的小偏差可能在多轮推理中被放大,最终导致结构化输出严重偏离事实。这一风险在长时间运行的 agent 特别明显。

缓解策略:

- 对每轮关键步骤引入结构化验证(schema/类型检查)。

- 限制每次任务的最大步骤数,必要时强制回溯或重置对话状态。

3. 规划失效(Planning Degradation)

长任务中,随着 KV cache 增长与注意力分布变化,V4 可能在中后段出现计划不连贯、重复尝试等表现。这在官方描述的长期 agent 工作负载中属于可预期现象,可参考 Hugging Face 的解释性文章 “DeepSeek-V4: a million-token context that agents can actually use”。

缓解策略:

- 使用外部任务计划器,将模型从全局规划中解耦,减少持续规划压力。

- 为回合式推理提供显式的“已完成步骤 / 待完成步骤”记录。

4. 多工具调用过程中状态累积异常

若 agent 工具链较复杂,前一次工具调用的噪声或失败输出可能污染下一步推理,使模型误判环境状态。

缓解策略:

- 对每次工具调用结果做规范化:空值、错误栈、无关日志全部过滤或结构化。

- 将任务分块,把“执行”与“解释结果”分离,让模型在更干净的状态下继续推理。

5. 演化式对话中的约束遗失

长时间运行的服务可能累积噪声,特别是在复合指令下(多目标、多排除条件)。来自实践社区的建议认为,当模型表现出重复、停滞或忽略指令时,清理历史上下文常能恢复质量,可参考文章《Mastering Deepseek V4: Common Mistakes and How to Avoid Them》中的相关说明(https://veo4.dev/blogs/common-deepseek-v4-mistakes-and-how-to-avoid-them-20260323)。

缓解策略:

- 定期重建 prompt,将仍然需要的约束重新显式声明。

- 对对话状态设置“上下文寿命”,过期内容自动剔除。

6. 成本与负载波动导致的服务不稳定(特别是 agent 工作流)

多步骤 agent 推理的负载呈指数式不稳定:一次微小分支选择可能引发额外十余次工具调用。长时间持续运行会导致资源占用过高或响应延迟上升。

缓解策略:

- 为 agent 任务设置预算(最大 token 用量、最大工具次数)。

- 实时度量 KV cache 使用率,必要时触发分段推理或重新加载策略。

7. 非预期循环(Unintended Loops)

当模型为完成任务而反复尝试同类步骤时,可能陷入逻辑循环,尤其在没有上层调度器的情况下。

缓解策略:

- 引入循环检测(对最近 N 步输出做指纹比对)。

- 配合外部执行环境,如在官方 DSec 框架那样,将执行结果与模型决策明确分离,从而降低自反馈造成的重复路径。

整体原则是:让模型的每一步都在约束内运行,并保持足够的可观测性。日志、步骤上限、schema 校验、分段规划,是当前 V4 体系下最具性价比的四种稳定性手段。