在搜索系统算法岗位的面试角逐中,候选人往往陷入一个典型的误区:过分沉迷于 Transformer 或 DeepFM 等具体模型的数学推导,却忽视了工业级系统最核心的“全链路视角”。真正的搜索系统设计并非孤立算法的简单堆砌,而是一个精密运转的数据漏斗与决策流水线,其本质是在极短的延迟约束下对海量信息进行层层过滤与精选。从 Query 语义理解对用户模糊意图的精准翻译与结构化重组,到多路召回策略在毫秒级内完成百亿级数据的广度覆盖,再到粗排与精排模型对点击率与转化率的极致预估,每一个环节的演进都不仅仅关乎算法选型,更涉及算力预算、响应速度与业务目标之间的复杂博弈。面试官所寻找的,正是能够跳出单一模型局限,将这些零散的技术模块串联成一条逻辑严密的“数据旅程”的架构设计者。这种宏观思维要求你深刻理解“Garbage In, Garbage Out”的上下游依赖关系,清晰阐述如何在召回率与准确性之间进行工程权衡,以及如何利用全链路评价指标来驱动系统迭代。掌握这套从意图识别到最终排序的完整叙事逻辑,不仅是应对高难度系统设计面试的通关秘籍,更是从初级算法工程师进阶为具备全局视野的搜索架构师的必经之路。

搜索面试的核心:全链路视角与“讲故事”的方法论

在搜索系统的 AI 面试中,候选人最常犯的错误不是“不懂算法”,而是“只见树木,不见森林”。许多候选人能熟练推导 Transformer 的公式,却无法解释当用户输入一个 Query 时,系统是如何在 200 毫秒内从百亿级数据中返回最相关结果的。

面试官寻找的不仅仅是算法工程师,更是具备架构思维的系统设计者。在 45 分钟的系统设计面试中,你需要将零散的技术点串联成一条逻辑严密的线索——这就是“全链路视角”。

为什么选择“流水线叙事”?

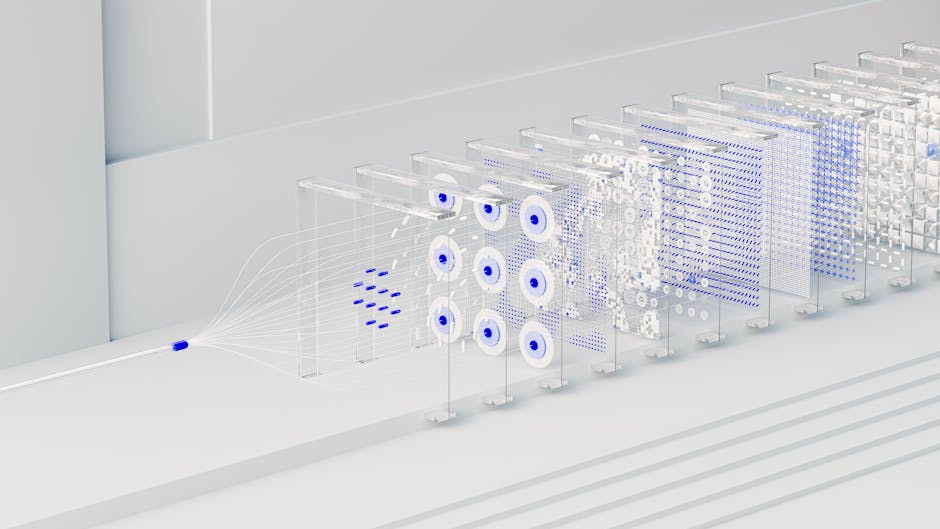

搜索系统本质上是一个漏斗(Funnel)。数据量随着链路层级逐级递减,而模型的复杂度逐级递增。将你的回答构建为一个“Query 的旅程”,能有效避免思维跳跃,向面试官展示你对工程约束(Trade-offs)的理解:

- Query 理解 (QU):解决“用户想要什么”的问题,是系统的指挥棒。

- 召回 (Recall):解决“海量数据筛选”的问题,核心是覆盖率与速度。

- 排序 (Ranking):解决“谁更好”的问题,核心是精准度(CTR/CVR 预估)。

- 重排与机制 (Re-ranking):解决“业务规则与生态”的问题,如多样性、去重和广告插入。

这种叙事结构不仅符合工业界的真实数据流向,还能帮助你掌控面试节奏,避免在某个细节(如具体的 Loss 函数)上纠缠过多而导致超时。正如系统设计面试指南所强调的,时间管理至关重要,你需要先建立高层级的设计蓝图并获得面试官认可,再深入细节。

面试速查表:搜索链路核心要素

为了在白板面试或口述中快速建立框架,建议熟记以下“作弊表”(Cheat Sheet)。它定义了每个阶段的输入输出接口、时间预算(Latency Budget)以及算法选型重点。

阶段 (Stage) | 输入 (Input) | 输出 (Output) | 核心目标 | 典型耗时 (Budget) | 主要算法/技术 |

|---|---|---|---|---|---|

Query 理解 (QU) | 原始用户 Query | 结构化意图 (Term, Entity, Intent) | 语义解析与纠错 | < 10ms | NLP, NER, BERT (离线/蒸馏), Trie树 |

召回 (Recall) | 结构化意图 | 候选集 (Candidates, e.g., 1000+) | 广度覆盖 (Recall Rate) | 10-20ms | 倒排索引, 向量检索 (ANN), 双塔模型 |

粗排 (Pre-rank) | 候选集 (1000+) | 精选集 (Top ~200) | 算力与精度的折中 | 10ms | 轻量级双塔, 简单 LR/GBDT |

精排 (Ranking) | 精选集 | 排序列表 (Score List) | 精准预估 (Accuracy) | 20-50ms | DeepFM, DIN, Multi-Task Learning |

重排 (Re-rank) | 排序列表 | 最终展示结果 (Final Page) | 体验与业务约束 | < 10ms | MMR (多样性), 规则引擎, 强插逻辑 |

面试官视角:

当我问“如何设计一个电商搜索系统”时,我并不希望你立刻开始写代码。我希望你先画出上述流程图,并主动询问约束条件(如 QPS、数据规模、延迟要求)。如果你的设计中缺少了“粗排”层,或者在召回层直接使用了高耗时的复杂模型,这通常意味着你缺乏处理大规模工业级流量的经验。

架构思维:从“模型”到“系统”

掌握上述表格只是第一步,更高级的回答需要体现各模块之间的联动与制衡:

- 上游决定下游上限:如果 QU 阶段的分词错误(如将“n95口罩”切分为“n95”和“口红”),后续的排序模型再精准也无法挽回,这就是典型的 Garbage In, Garbage Out。

- 下游反哺上游:重排层的曝光与点击数据,是训练排序模型最核心的样本来源;而排序层的打分分布,又可以用来动态调整召回层的截断阈值。

在接下来的章节中,我们将沿着这个漏斗,逐一拆解每个模块的“必考题”与“加分项”,教你如何把枯燥的技术点讲成一个引人入胜的系统设计故事。

第一阶段:Query 语义理解 (QU) —— 意图识别的基石

在搜索系统的全链路叙事中,Query 语义理解(Query Understanding,简称 QU)扮演着“翻译官”的角色。它的核心使命是解决用户表达与索引数据之间的语义鸿沟。用户输入的 Query 往往是模糊、非结构化甚至包含错误的自然语言(如“苹果最新款价格”),而底层的检索引擎需要的是精确的结构化指令(如 Brand: Apple, Category: Mobile, Sort: Price_Desc)。

在面试中阐述这一阶段时,必须强调 “Garbage In, Garbage Out” (GIGO) 原则。QU 模块位于整个系统的最上游,它决定了后续召回阶段的“天花板”。如果 QU 阶段对意图判断错误(例如将“苹果”误判为水果而非电子产品),那么召回层检索到的候选集将完全偏离用户需求。此时,无论下游的 排序层(Ranking) 模型多么复杂、特征工程多么精细,都无法挽回结果不相关的问题。因此,QU 不仅是 NLP 技术的堆砌,更是整个搜索系统的流量守门员和精准度基石。

为了将非结构化的文本转化为机器可理解的意图,工业界通常采用一套标准化的串行处理流水线。我们将重点拆解其中最关键的三个子模块:纠错(Correction)、分词(Segmentation) 与 实体链接(Entity Linking),展示它们如何协同工作以锁定用户的真实需求。

核心模块拆解:纠错、分词与实体链接

在面试中,当面试官问到“Query 理解具体做了什么”时,切忌像背诵 NLP 教科书一样罗列算法。你需要展示的是一个工业级的处理流水线,说明每个模块是如何逐步消除用户输入的不确定性,并为下游的召回(Recall)提供结构化指令的。

通常,这一阶段包含三个必不可少的串行步骤:

1. 纠错(Spell Check):第一道防线

用户的输入往往充满噪声(如拼写错误、误触)。纠错模块的任务是在分词之前,将非标准的 Query 映射为标准 Query。

- 面试考点:面试官常问“如何平衡纠错的召回率与准确率?”。

- 关键策略:你需要提到高置信度纠错(High Confidence Correction)。对于明显的错误(如 "iphoe" -> "iphone"),系统会自动改写并搜索;对于模棱两可的输入,通常保留原词,但在界面上提示“您是不是要找……”。

2. 分词与实体链接(Segmentation & Entity Linking/NER)

这是将非结构化文本转化为结构化数据的核心。

- 分词(Tokenization):将连续的字符串切分成有意义的词单元。在电商或垂直领域,单纯的通用分词(如 jieba)往往不够,需要结合行业词库。

- 实体链接(Entity Linking / NER):识别词汇背后的“身份”。仅仅把词切开是不够的,系统需要知道哪个词是“品牌”,哪个是“品类”,哪个是“属性”。这直接决定了召回时是查倒排索引的文本字段,还是查结构化字段(如

category_id)。

实战案例演示

假设用户输入:iphone 14 pro max price

1. 纠错:无明显错误,跳过。

2. 分词与 NER:

*iphone-> Entity: Brand (Apple)

*14 pro max-> Entity: Model/Series

*price-> Intent: Attribute (价格/比价)

3. 意图判定:Shopping(购物意图),且带有明确的比价需求。

3. 词权重计算(Term Weighting):解决“丢词”问题

这是连接 QU 与召回环节的关键接口。并非 Query 中的每个词都同等重要。如果直接用所有词去取交集(AND 逻辑),可能导致零结果;如果取并集(OR 逻辑),又会引入大量噪声。

- 核心逻辑:系统需要计算每个 Term 的权重(Weight),区分核心词(Core Terms)与修饰词(Optional Terms)。

- 应用场景:在上述案例中,

iphone和14 pro max是核心词,必须在召回文档中出现;而price是意图词,不需要文档标题里一定包含“价格”二字,它更多用于后续的排序逻辑或展示样式(如直接显示比价卡片)。

在腾讯搜索架构等成熟系统中,这一流程被严格执行,以确保进入召回阶段的 Query 是清晰、结构化且带有权重指令的。在面试中,清晰地画出从“Raw Text”到“Structured Query”的转化过程,能有效体现你对搜索系统“Garbage In, Garbage Out”原则的深刻理解。

难点攻坚:长尾 Query 与意图漂移的处理

在面试中,讲述 Query 理解(QU)模块时,最忌讳的是只停留在“分词”和“实体识别”等基础 NLP 概念上。面试官通常会通过长尾查询(Long-tail Queries)和多义词歧义(Ambiguity)这两个边缘场景,来考察候选人处理“坏的 Case”的能力。你需要展示的是一套从识别问题到降级策略的完整治理方案。

1. 意图漂移与多义词消歧 (Ambiguity Resolution)

当用户输入“苹果”时,是指水果还是电子产品?这是一个经典的搜索歧义问题。初级回答通常止步于“基于概率的最大似然估计”,而高阶回答需要引入上下文感知(Context-Awareness)。

- 利用个性化与会话上下文:

解决歧义的核心在于引入额外信号。你可以提到,在 QU 阶段不仅分析当前 Query 的文本特征,还需结合用户的实时行为序列。例如,如果用户在过去 5 分钟内浏览过“数码配件”,那么“苹果”的意图置信度应向“科技”倾斜。这种利用用户行为序列建模来辅助当前意图识别的思路,能体现你对全链路数据的敏感度。 - 多意图保留策略:

如果上下文不足以完全消歧(例如冷启动用户),不要试图“猜”一个唯一答案。成熟的系统设计会允许 QU 模块输出多路意图(Multi-intent),并携带各自的置信度分数传递给下游召回层。例如,80% 概率召回“手机”,20% 概率召回“生鲜”,最终由排序层(Ranking)根据 CTR 预估模型来决定展示顺序。

2. 长尾 Query 与“少无结果”治理

长尾 Query 往往面临字面匹配无结果(No Result)或结果极少的问题。这是考察你如何平衡精准率(Precision)与召回率(Recall)的关键点。

- Query 改写(Query Rewriting):

针对长尾词,最有效的手段是进行改写。你可以介绍丢词(Term Dropping)和同义词扩展策略。 - 丢词逻辑:对于“2024年新款红色耐克透气跑步鞋”这样极其具体的 Query,如果完全匹配无结果,系统应识别出核心词(耐克、跑步鞋)与修饰词(2024年、红色),通过逐步丢弃修饰词来换取结果的有无。

- 风险控制:改写必须有边界。面试中要主动提到“漂移风险”——即改写虽然召回了结果,但完全偏离了用户意图。因此,改写后的 Query 通常需要经过一个轻量级的相关性验证模型(Relevance Model)。

- 语义匹配兜底 (Semantic Matching):

当基于关键词的改写仍然失效时,语义向量召回是最后的防线。解释如何利用 Embedding 技术将 Query 映射到向量空间,通过计算向量相似度来召回“字面不同但语义相近”的商品。这能有效解决用户输入错别字或非标准描述(如搜“去油”找“洗面奶”)的问题。

3. 面试中的“高光”叙述技巧

在总结这一部分时,建议用指标驱动的方式收尾。不要只说“我们做了改写”,而要说:

“为了解决长尾 Query 的少无结果率(Zero Result Rate),我们引入了基于语义的改写机制,虽然这可能会在一定程度上牺牲 Precision,但我们通过上线后的改写接受率和无结果率下降幅度来动态调整改写的激进程度,最终在业务指标上取得了平衡。”

这种表述方式不仅展示了技术深度,还体现了你对业务结果(Business Outcome)的负责态度。

第二阶段:多路召回 (Recall) —— 漏斗的广度与精度

在搜索系统的全链路漏斗中,召回层(Recall)是“大浪淘沙”的第一道关卡。如果说 Query 理解决定了系统能听懂什么,那么召回层则决定了系统能提供什么。在面试中,面试官考察这一层时,关注的核心并非某个单一模型的数学推导,而是你对效率与覆盖率(Efficiency vs. Coverage)这一核心矛盾的工程权衡能力。

漏斗模型与工程约束

召回层的核心任务极其明确且严苛:在毫秒级(通常要求 <50ms)的延时约束下,从百万甚至亿级的海量 Item 库中,快速筛选出几百个(通常为 500-1000 个)用户可能感兴趣的候选集。

这是一个典型的系统设计(System Design)问题。单纯依靠一种算法很难同时满足“查得全”和“查得准”的要求。例如,倒排索引擅长精确匹配,但难以捕捉语义关联;向量检索擅长模糊语义,但可能在专有名词上出现漂移。因此,工业界通用的解决方案是多路召回(Multi-path Recall)。

为什么要设计“多路”?

多路召回的核心思想是“互补”。每一路召回策略就像一个不同视角的雷达,负责捕捉不同维度的相关性:

- 文本相关性:保证 Query 中的核心词被精确命中。

- 语义相关性:解决“苹果”与“手机”虽无文本重叠但意图相关的语义鸿沟。

- 行为相关性:基于用户历史行为(User-to-Item)或物品关联(Item-to-Item)进行个性化挖掘。

在面试叙述中,你需要展示出全链路视角:多路召回产生的结果必然存在重叠,因此必须包含一个融合(Merge)与去重(Deduplication)的步骤。你需要向面试官解释,你是如何根据业务特点(如新闻的时效性、电商的转化率)来动态调整各路召回的配额(Quota),以及如何处理“无结果”时的兜底策略。

接下来的部分,我们将深入探讨几种最主流的召回策略及其在实际业务中的组合应用。

常见召回策略:倒排、向量与图算法的组合拳

在面试中,当被问及“你们的召回层是如何设计的”时,切忌只罗列算法名称(如“我们用了双塔和 FM”)。高分的回答应当展现出组合拳(Combination Punch)的思维:即针对不同的业务痛点,利用不同召回通路的特性进行互补。

最经典的架构通常由文本匹配(倒排)与语义匹配(向量)构成双轮驱动,再辅以图算法或I2I策略处理个性化需求。

1. 核心对比:文本匹配 vs. 向量召回

这是面试中最高频的考点。你需要清晰地指出,传统的倒排索引虽然在精确匹配上不可替代,但面对“语义鸿沟”时往往力不从心;而向量召回虽然能捕捉语义,却存在可解释性差的问题。建议使用以下框架进行对比分析:

维度 | 倒排索引 (Inverted Index) | 向量召回 (Vector Retrieval) |

|---|---|---|

匹配逻辑 | 字面匹配 (Term Match):基于 TF-IDF/BM25,强调查询词与文档词的重合度。 | 语义匹配 (Semantic Match):基于 Embedding 向量空间,通过计算 Cosine 相似度寻找近邻。 |

核心优势 | 精确与可控:对于搜索特定型号(如 "iPhone 15 Pro")、人名或特定短语,能保证 100% 命中,且易于 debug。 | 泛化能力强:能解决“多词一义”或“一词多义”问题(如搜“苹果”召回“水果”或“手机”),能处理长尾模糊意图。 |

主要劣势 | 语义鸿沟:无法理解同义词(如“手机”搜不到“移动电话”)或拼写错误,召回率(Recall)存在天花板。 | 不可解释性:属于“黑盒”模型,偶尔会出现语义相关但业务不相关的 Bad Case,且 ANN 检索对内存和计算资源消耗较大。 |

面试话术 | “倒排是保底,保证用户搜什么出什么;向量是增量,负责挖掘用户‘没说出口’的潜在需求。” | “向量召回如 双塔模型 (DSSM/Two-Tower) 重点在于提升覆盖率,弥补倒排的漏召回。” |

2. 个性化补充:图算法与 I2I/U2I

除了上述两路基础召回,面试官通常会追问:“如果用户意图非常模糊,或者是在推荐场景下,如何进一步提升惊喜感?” 这时需要引入基于行为的召回策略。

- Item-to-Item (I2I) 协同过滤:

这是工业界最“抗打”的策略。通过分析海量用户的共同点击行为("看了又看"),构建物品间的关联。这种方法不依赖语义,而是依赖群体智慧,能发现很多语义上不相关但用户兴趣强相关的组合(如“啤酒”与“尿布”)。 - 图神经网络 (Graph Algorithms):

为了捕捉更高阶的邻居关系,可以使用图算法(如 GraphSAGE 或 PinSAGE)。相比简单的 I2I,图算法能在用户-物品构成的异构图上进行多跳游走,将“看了 A 的人也看了 B,看了 B 的人常买 C”这种二度、三度关系挖掘出来,极大地丰富了候选集的多样性 (Diversity)。

3. 融合策略:不仅仅是相加

最后,必须简要提及多路召回后的融合(Fusion)逻辑,否则系统设计是不完整的。

- 去重 (Deduplication):不同通路可能会召回相同的热门商品,必须在融合层通过 Item ID 进行去重。

- 截断与配额:由于下游精排层的算力有限(通常只能处理几百到上千个候选),需要根据各路召回的历史 CTR 表现或业务优先级(如倒排优先级最高),动态分配每一路的截断阈值。

通过这种“倒排保精度 + 向量拓宽广度 + 图/I2I 挖深度”的组合拳描述,你能向面试官证明你不仅懂算法原理,更懂如何构建一个高可用、高覆盖的工业级搜索系统。

召回截断与融合:如何平衡系统负载与覆盖率

在面试中,许多候选人能熟练讲解双塔模型或倒排索引的原理,但在被问及“多路召回的结果如何汇总给下游”时,往往回答得过于简单。实际上,召回融合(Merge & Fusion) 是工程复杂性极高的环节,它直接决定了系统的“覆盖率”与“延迟”之间的平衡。

面试官关注的核心在于:当你有 10 路召回(文本匹配、向量检索、协同过滤、热门兜底等),每路都返回 1000 个 Item,而粗排层只能处理 2000 个时,你该如何做截断?

1. 归并与去重 (Merge & Deduplicate)

这是最基础的工程动作。多路召回通常是并发执行的(Scatter-Gather 模式),系统需要收集所有链路的返回结果。

- 去重策略:同一个 Item 可能同时出现在“文本匹配”和“向量召回”中。此时不仅要去重,还需要记录该 Item 命中了哪些路(Source Tracking),这些信息后续通常会作为 Feature 喂给排序模型,表明该结果的置信度。

- 并发控制:这是展示工程经验的好机会。由于系统总耗时取决于最慢的那一路召回,因此必须设置严格的超时截断(Timeout)。例如,如果“向量召回”超时,系统应设计为仅使用其他几路的已返回结果,而不是阻塞整个请求,这就是所谓的“降级策略”。

2. 配额分配问题 (The Quota Problem)

如何从汇总的几千个候选中截断出 Top N 给粗排?这通常有两种策略:

- 固定比例截断 (Fixed Ratio/Quota)

这是冷启动阶段或中小型系统最常用的方案。例如,规定 Top 2000 的槽位中,文本相关性占 40%,向量召回占 40%,热门兜底占 20%。 - 优点:能够强制保证结果的多样性,避免某一强势链路(如热门内容)挤占所有名额。

- 缺点:不够灵活。对于长尾生僻 Query,可能文本召回只有 5 个结果,却预留了 800 个槽位,造成算力浪费;而对于模糊意图 Query,向量召回效果更好,却被限制了数量。

- 动态打分与截断 (Dynamic Scoring)

进阶方案是让各路召回在同一把尺子上竞争。但这面临分数不可比的难题:倒排索引返回的是 BM25 分数(可能是 10.0~50.0),而双塔模型返回的是 Cosine Similarity(0.0~1.0)。 - 解决方案:通常会在各路召回内部做归一化(Normalization),或者训练一个极轻量级的“融合模型”(通常是逻辑回归或简单的 GBDT),将各路原始分映射为统一的 CTR 预估分,再按分数 Top N 截断。

- 算力博弈:美团等大厂在实践中会探索动态算力分配,即根据 Query 的意图(精准 vs. 泛搜)动态调整各路召回的截断阈值,在不降低效果的前提下减少下游粗排的计算压力。

3. 覆盖率与负载的 Trade-off

在设计系统时,必须向面试官阐述你对“代价”的理解。增加一路新的召回(例如引入图神经网络召回),虽然理论上能提升 Recall 指标,但会带来:

- RPC 开销与序列化成本:更多的结果传输。

- 长尾延迟风险:新模型如果响应慢,会拖累 P99 延迟。

因此,成熟的回答不仅要追求“召回率高”,还要强调“有效召回”。可以通过离线分析,计算某一路召回结果在精排后的曝光率。如果某路召回截断了 500 个结果,但最终只有 0.1% 能进入精排 Top 10,说明该路召回效率极低,应当缩减其配额或下线优化。

第三阶段:排序系统 (Ranking) —— 粗排与精排的算力博弈

在面试的这一阶段,面试官通常会从考察“广度”的召回环节,转向考察“精度”的排序环节。这是算法面试中最核心的部分,也是最容易暴露工程经验不足的环节。很多候选人会直接提出使用复杂的深度学习模型(如 DeepFM 或 Transformer 类模型)对召回结果进行打分,这往往是一个陷阱。

在实际的工业级搜索系统中,我们面临着严苛的算力约束与时延要求(通常全链路需在 200ms 内完成)。召回阶段输出的候选集规模通常在千级别(例如 5,000~10,000 条),如果对所有候选集直接使用复杂的精排模型,计算量将远超系统负载。因此,成熟的推荐与搜索系统普遍采用级联架构(Cascade Architecture),将排序过程拆分为“粗排(Pre-ranking/Coarse Ranking)”和“精排(Fine Ranking)”两个阶段。

这一阶段的核心在于“算力博弈”:如何在有限的计算资源下,平衡筛选效率与排序效果。

- 粗排(Rough Ranking):定位于“海选”后的初筛。其输入是召回阶段产出的数千个 Item,目标是将候选集规模迅速压缩至几百个(例如 500 条)。粗排更侧重于系统性能与召回率,要求模型结构简单、推理速度极快,确保不漏掉后续精排可能打高分的优质 Item。

- 精排(Fine Ranking):定位于“决赛”。其输入是粗排筛选出的几百个精英 Item,目标是输出最终展示给用户的 Top K 结果。由于处理数量级大幅降低,精排可以“奢侈”地使用复杂的特征交叉、用户行为序列建模以及多目标优化(CTR、CVR 等),以最大化业务指标。

在面试中阐述这一架构时,不仅要展示对美团等大厂级联排序架构的认知,更要强调你对不同阶段评价指标的理解:粗排看重与精排结果的对齐度(如 Recall@K),而精排则直接对业务转化负责。接下来的内容将深入拆解这两个阶段的设计细节与技术选型。

粗排 (Pre-ranking):双塔模型与低延时设计

在面试中,粗排(Pre-ranking)往往是一个容易被候选人轻视,但面试官非常看重“工程Sense”的环节。它的核心任务非常明确:以极低的算力成本,从召回的数千个候选集中筛选出几百个高质量结果输送给精排。

如果说精排是在“雕花”,那么粗排就是在“过筛”。在这一节,你需要向面试官证明你懂得如何设计一个既快又准的过滤器。

1. 核心架构:为何选择双塔(Two-Tower)?

在粗排阶段,业界最主流的基准架构是双塔模型(DSSM及其变种)。在回答“为什么要用双塔”时,不要只停留在模型结构图上,而要从算力与延时(Latency)的角度切入:

- 解耦计算(Decoupling): 双塔结构将“用户侧(User Tower)”和“物品侧(Item Tower)”的特征处理完全分离,直到最后一层才通过点积(Dot Product)或简单的余弦相似度进行交互。

- 离线预计算与缓存: 由于物品侧特征(如Item ID embedding、类目、静态属性)不依赖当前请求的用户信息,我们可以离线(Offline)或近线(Near-line)预先计算好所有Item的Embedding并存入缓存(如Redis或向量检索引擎)。

- 在线极速打分: 当用户发起请求时,系统只需实时计算一次User Embedding,然后将其与候选集中的Item Embeddings进行批量点积运算。这种向量运算在工程实现上极其高效,能够轻松支撑几千甚至上万的候选集打分,满足几十毫秒级的SLA要求。

面试加分项:你可以提到,虽然双塔速度快,但它牺牲了特征的交叉能力。为了弥补这一点,许多大厂(如美团、阿里)会在粗排引入知识蒸馏(Knowledge Distillation)技术。即让复杂的精排模型作为“Teacher”,简单的粗排模型作为“Student”去学习精排的打分分布(Logits),从而在保持双塔速度的同时,尽可能逼近精排的排序效果。

2. 特征选择:克制与取舍

粗排和精排最大的区别在于特征的复杂度。在面试中,你需要明确指出哪些特征适合粗排,哪些必须留给精排:

- 可用特征(Lightweight Features):

- ID类特征: User ID, Item ID(通过Embedding学习隐式表达)。

- 用户画像与历史行为: 用户的长期兴趣分布、最近点击序列(通常经过简单的Pooling或Attention处理)。

- 上下文特征: 时间、地理位置、设备类型。

- 慎用特征(Complex Cross-Features):

- 高阶交叉特征: 如“用户最近点击的类目”与“当前候选物品类目”的显式交叉。在双塔结构中,底层特征无法直接交互,强行引入复杂的实时交叉计算会破坏“预计算”的优势。

- 复杂的序列模型: 虽然可以使用简单的序列建模,但像超长序列的Transformer(如DIN/DIEN的复杂版)通常算力开销过大,不适合在粗排对全量候选集运行。

3. 常见误区:界定复杂度边界

很多候选人在设计粗排时,习惯性地堆砌模型复杂度,这是面试中的常见红线。

- 误区描述: “我会在粗排阶段使用DeepFM模型,因为它能自动学习特征交叉。”

- 实际问题: DeepFM、DCN等模型依赖于底层的特征交互,这意味着每一个 (User, Item) 对都需要经过完整的网络前向传播(Inference)。如果你有5000个召回结果,就要运行5000次复杂的深度模型预测,这在在线系统中几乎是不可能完成的任务(会导致超时截断)。

- 正确回答范式: “考虑到粗排面临的候选集规模(~10k级别),直接使用依赖底层特征交叉的精排模型(如DeepFM)会导致严重的算力瓶颈。因此,我倾向于使用向量内积模型或极简的MLP模型,并通过特征筛选和蒸馏技术来保证在低延时下的排序效果。”

这种对系统边界和算力成本的敏感度,正是面试官在考察高级工程师时寻找的特质。有关粗排在实际工业界(如美团)的优化实践与算力分配策略,可以参考相关的技术探索与实践来丰富你的回答细节。

精排 (Ranking):多目标优化 (MTL) 与特征工程实战

在面试的精排环节,面试官不仅仅考察你是否知道 DeepFM 或 DIN 的网络结构,更看重你是否理解业务目标与模型架构的对齐。精排模型通常是算力消耗最大、特征最复杂的环节,因此如何平衡精度(Accuracy)与系统性能(Performance),以及如何处理多目标之间的冲突,是区分中高级候选人的关键。

1. 多目标优化 (Multi-Task Learning, MTL) 的业务价值

大多数搜索和推荐场景都面临着“既要点击率(CTR),又要转化率(CVR)”的挑战。在面试中,不要只机械地列举 MMOE 或 ESMM 的公式,而应从样本偏差和数据稀疏性的角度切入:

- 解决样本选择偏差 (SSB):传统的 CVR 模型只能在用户点击后的样本上训练,但线上预测是对所有曝光样本进行的。你可以提到 ESMM (Entire Space Multi-Task Model) 架构,它通过引入 CTR 和 CTCVR(点击后转化)两个辅助任务,利用全空间样本进行训练,有效解决了 CVR 预估的偏差问题。

- 平衡冲突目标:点击高的内容未必转化好(例如“标题党”)。在讨论 MMOE (Multi-gate Mixture-of-Experts) 时,应强调其通过门控机制(Gating Networks)自动学习不同任务对共享专家的依赖程度。

- 话术建议:“在之前的项目中,我们发现直接共享底层参数会导致‘负迁移’(Negative Transfer),即优化 CTR 反而损害了 CVR。引入 MMOE 后,模型能根据不同任务的特性动态调整特征权重的分配,使离线 AUC 在两个指标上均有提升。”

2. 特征工程:高阶交叉特征的“贵”与“值”

尽管深度学习能自动进行特征组合,但在精排阶段,显式的交叉特征 (Cross Features) 仍然是提升模型天花板的利器。

- 为什么重要:单特征(如“用户喜欢电子产品”、“商品是iPhone”)的信息量有限,而交叉特征(“用户历史点击过Apple品牌” AND “当前商品是iPhone 15”)能精准捕捉用户意图。

- 工程权衡:笛卡尔积式的特征组合会导致特征空间爆炸,增加线上推理延时。

- 面试应对:展示你对算力的敏感度。可以提到使用 Hash Trick 压缩特征空间,或者在网络结构中引入 DCN (Deep & Cross Network) 来显式学习高阶组合,代替人工暴力的特征工程。

3. War Story:从“唯点击论”到“用户体验”的救赎

面试官非常喜欢问:“如果模型上线后 CTR 涨了,但用户留存跌了,可能是什么原因?” 这正是展示你实战经验(Experience)的最佳时机。

- 陷阱:模型过度拟合了容易诱导点击的特征(如色情擦边球、震惊体标题),导致出现“高点击、低满意度”的现象。正如推荐系统AI面试全链路清单中所述,单纯优化 CTR 可能会牺牲长期的用户体验。

- 解决方案:

- 引入辅助目标:在 MTL 框架中加入 “停留时长 (Dwell Time)” 或 “有效点击 (Valid Click)” 作为回归任务或二分类任务。只有当用户点击且停留超过一定阈值(如 3 秒)才算正样本。

- 负向反馈建模:将“用户点击后迅速退出”或“负反馈(Dislike)”作为惩罚项加入 Loss Function。

- 在线与离线的一致性:强调离线评估时不能只看 AUC,还需要关注 GAUC(Group AUC)以及不同分桶下的指标表现,避免模型在长尾流量上表现极差却被平均指标掩盖。

通过这样一个完整的故事——从发现指标背离(War Story),到分析原因(点击不等于满意),再到技术落地(MTL 引入 Dwell Time),你能向面试官证明你不仅懂算法,更懂如何用算法解决真实的业务痛点。

评价指标 (Evaluation) —— 离线与在线的一致性难题

在搜索与推荐系统的面试中,评价指标不仅仅是列举公式,更是考察候选人是否有工业界实战经验的试金石。面试官最常追问的核心痛点往往集中在“离线指标与在线指标的不一致性”上。

离线与在线指标的二元世界

首先,你需要清晰地界定两套评价体系的边界。在面试中,建议用对比的方式阐述:

- 离线指标 (Offline Metrics):主要用于模型迭代阶段,评估模型的拟合能力和排序能力。

- AUC / GAUC:点击率预估中最核心的指标。面试中务必强调 GAUC (Group AUC) 的重要性,因为它消除了用户活跃度差异带来的偏差,更真实地反映了模型在“同一个用户”视角下的排序能力。

- Recall@K / Precision@K:常用于召回阶段,评估Top K结果的覆盖率。

- Log Loss:评估预估分数的准确性(Calibration),而不仅仅是排序。

- 在线指标 (Online Metrics):用于A/B测试阶段,直接关联业务价值。

- CTR (点击率) / CVR (转化率):最直接的流量反馈。

- GMV (成交总额):电商场景的终极目标。

- Latency (延迟) / QPS:工程系统的健康度指标。

核心面试题:为什么离线 AUC 涨了,线上 CTR 却跌了?

这是区分“调包侠”与“资深工程师”的分水岭问题。如果离线训练时 AUC 提升显著(例如 +0.5%),但上线后业务指标(如 CTR 或 GMV)反而下跌,这通常被称为“离在线不一致”或“Generalization Gap”。

在回答时,不要只笼统地提到“过拟合”,应从以下几个具体的工程维度展开分析:

- 样本选择偏差 (Sample Selection Bias):

离线训练使用的是“冰山一角”的曝光点击数据(已有模型认为好的数据),而线上模型需要面对全量的候选集(包括大量从未曝光过的“冰山下”数据)。如果模型只学会了在“高个子”里拔将军,却无法在海量粗糙样本中识别潜力股,就会导致线上效果崩塌。 - 特征一致性 (Training-Serving Skew):

这是最常见但也最容易被忽视的工程问题。离线特征往往来自于 T+1 的 Hive 表,经过了精细清洗;而线上特征依赖实时流计算,可能存在延迟或逻辑差异。例如,离线AUC和线上CTR不一致 的情况常发生于特征穿越或实时数据流处理滞后。 - 评估目标与业务目标错位:

AUC 衡量的是整体排序能力,但业务往往只关心 Top N 的效果。离线/在线评估差异 的研究表明,如果模型优化的是 ROC 曲线两端(极高或极低分段),虽然整体 AUC 涨了,但在实际展示的阈值区间(Practical Operating Points)效果可能并未提升,甚至因为对坏样本的过度拟合而挤占了优质内容的展示机会。

建议回答策略:全链路排查清单

当面试官抛出这个问题时,建议采用“排查清单”式的结构化回答,展示你解决实际问题的逻辑:

- 第一步:特征一致性校验 (Sanity Check)

“首先,我会进行 Log Replay,将线上的实时特征落盘,与离线训练生成的特征进行逐条 Diff。确保同一个 User-Item 在同一时间点的特征值完全一致,排除代码逻辑不一致或数据延迟导致的问题。” - 第二步:模型校准 (Calibration)

“其次,我会检查 COPC (Click over Predicted Click) 指标。如果 AUC 涨了但 COPC 严重偏离(预估值普遍虚高),说明模型校准失效,这会直接影响下游的截断策略和流量分配。” - 第三步:更细粒度的离线评估

“我会从单纯看 AUC 转向看 GAUC,并检查测试集的分布是否与线上真实流量一致。例如,是否剔除了冷启动用户?是否存在未来的数据泄露(特征穿越)?” - 第四步:A/B 测试验证

“最后,离线指标只能作为参考。我会强调‘小流量实验’的重要性。即使离线表现优异,也必须通过在线 A/B Testing 来验证对 CTR、GMV 以及用户停留时长等综合指标的影响,因为离线 AUC 与在线业务的 Gap 是常态,最终决策应以线上实验为准。”

面试加分项:工程权衡与“填坑”经验 (Trade-offs & Edge Cases)

在面试中,能够流畅描述“Query 理解 → 召回 → 排序”的标准流程只能证明你具备基础知识。真正能让你脱颖而出,甚至拿到 Senior Offer 的,往往是你对系统边界、工程权衡(Trade-offs)以及极端情况(Edge Cases)的处理能力。面试官不仅想知道“怎么做是对的”,更想知道“出问题时你如何应对”。

以下是三个最常被考察的工程难题及其高分回答策略:

1. 延迟与精度的博弈 (Latency vs. Accuracy)

搜索系统通常面临严格的 SLA(Service Level Agreement),例如要求端到端响应时间在 200ms 以内。这就要求我们在模型复杂度和系统性能之间做极其艰难的取舍。

- 面试痛点:很多候选人只谈论使用了最新的 BERT 或超大参数模型,却忽略了在线推理的耗时成本。

- 高分回答逻辑:

- 多级漏斗架构:强调“粗排”(Coarse Ranking)的重要性。在召回海量(万级)候选集后,先用简单的双塔模型或轻量级 GBDT 进行一轮筛选,将进入精排(Fine Ranking)的候选集压缩到几百个,从而为精排上复杂的深度模型(如 DIN/DIEN)争取计算时间。粗排模型如何进行性能与效率的权衡 是工业界优化的重点。

- 降级策略 (Graceful Degradation):提及系统高负载时的动态调整。例如,“在流量洪峰期间,我们会自动熔断部分耗时较长的特征(如超长用户行为序列),或者切换到较小的模型版本,优先保证服务的可用性和低延迟,而非追求极致的排序精度。”

2. 冷启动问题的系统化解法 (Cold Start)

“新商品上架没有行为数据,怎么排?”是必考题。单纯回答“用基于内容的推荐”往往过于单薄,面试官更看重你是否具备 Exploration & Exploitation (E&E) 的思维。

- 常见误区:只依赖 CTR 预估。如果完全按预估 CTR 排序,新物品因缺乏历史点击,分数极低,永远无法获得曝光,导致“马太效应”。

- 进阶回答策略:

- 双路召回:对于新物品,利用 Content-based 方法(如基于标题、图片的 Embedding 相似度)生成初始候选集,不依赖 ID 特征。

- 动态保量机制:分享具体的“填坑”经验,例如设计一个基于时间衰减的 Boost 因子,给予新物品一定的“探索流量”。引用 推荐系统AI 面试追问清单 中的观点:在重排层动态插入新内容,并利用 Bandit 算法(如 UCB 或 Thompson Sampling)在“探索新物”与“利用热门”之间寻找平衡点。

- 快速反馈闭环:强调实时流计算的重要性。一旦新物品获得了最初的几次点击,系统应能通过 Online Learning 或实时特征更新,迅速捕捉其潜力并调整权重。

3. 偏见消除与位置去偏 (Position Bias & COEC)

数据总是“脏”的。用户点击排在第一位的结果,往往不是因为它最相关,仅仅因为它在第一位。这就是位置偏见 (Position Bias)。

- 深度洞察:直接指出直接使用原始点击日志训练模型会引入偏差(Bias),导致模型只会推荐“本来就热门”的东西。

- 解决方案:

- 训练阶段 (Training):将“位置信息”(Position)作为特征输入模型。模型会学习到“位置 1 带来的天然点击率加成”。

- 预测阶段 (Serving):这是关键一步。在在线预测时,将位置特征手动置为一个默认值(如 Position=0 或 Position=10),或者直接移除该特征的贡献。这样模型预测的就是“去除位置影响后的纯粹相关性”。

- COEC 指标:提及使用 COEC (Click Over Expected Click) 代替单纯的 CTR 来评估算法迭代的效果,证明你关注的是算法带来的真实提升,而非位置红利。

专家建议:在回答这些问题时,不要只背诵算法名称。结合具体的业务场景(如电商大促、新闻突发事件),描述你曾遇到的 Bad Case 以及你的修复过程,这种“战壕里的经验”比任何公式推导都更有说服力。