随着大模型应用与 RAG 架构的爆发式增长,向量检索(Vector Retrieval)技术已从边缘辅助组件跃升为 AI 基础设施的核心支柱,其面试考察的维度也随之从单一的库函数调用演进为对全链路系统设计的深度拷问。在高级算法工程师与架构师的面试中,面试官不再满足于候选人仅了解 HNSW 或 IVF 的基本概念,而是期望其具备从非结构化数据 Embedding 映射、索引构建与量化(Quantization),到最终近似最近邻搜索(ANN)及重排序(Rerank)的完整闭环视野。这一过程不仅涉及对内积、余弦相似度等度量指标的精准选择,更要求候选人能够量化分析 M、efConstruction 等关键参数在内存开销、构建耗时与查询延迟(Latency)之间的复杂权衡(Trade-off)。本文通过拆解向量检索系统的五阶段生命周期,深入揭示 HNSW 索引底层的多层图结构原理与工程调优实战,旨在帮助读者建立起能够应对海量数据挑战的架构思维。无论是面对召回率(Recall)波动的归因分析,还是在资源受限场景下进行混合检索策略的选型,掌握这些底层逻辑与全链路优化手段,是突破面试中“系统设计”瓶颈、展示解决实际工程问题能力的关键所在,也是从单纯的“调包侠”向具备深厚技术底蕴的资深专家转型的必经之路。

全链路总览:从 Embedding 到 Rerank 的核心流程

在高级向量检索(Vector Retrieval)的面试中,面试官往往不会只盯着某一个算法(如 HNSW)提问,而是更倾向于考察候选人对全链路(Full-Link)的系统设计能力。一个成熟的向量检索系统不仅仅是“把数据存进去再查出来”,它涉及从非结构化数据到最终业务结果的完整生命周期。

掌握以下五个核心阶段,不仅能帮助你构建清晰的答题逻辑,也是在系统设计(System Design)环节展示架构思维的关键。

向量检索系统的五阶段生命周期

为了在面试中条理清晰地描述系统流程,建议按照数据流向,将核心链路拆解为以下五个标准步骤:

- 数据向量化 (Data Embedding/Encoding)

这是链路的起点,核心是将非结构化数据(文本、图像、音频)转化为计算机可处理的数学向量。

- 关键点:选择合适的 Embedding 模型(如 BERT 处理文本、ResNet 处理图像)以捕捉语义特征。

- 进阶考点:面试中常涉及稠密向量与稀疏向量的对比,以及如何处理长文本切片(Chunking)或未登录词(OOV)问题。

- 索引构建与量化 (Indexing & Quantization)

生成向量后,直接暴力搜索(Brute-force)在大规模数据下不可行,因此需要构建索引结构。

- 关键点:利用 HNSW(基于图)或 IVF(倒排文件)等算法组织数据。

- 性能优化:为了降低内存占用和加速计算,通常会引入量化技术(如 PQ 乘积量化、SQ 标量量化),在精度和存储成本之间做权衡。

- 相似度度量 (Metric Calculation)

定义“什么是相似”是检索的基础。

- 关键点:根据业务场景选择度量方式。例如,归一化向量通常使用内积 (IP) 或 余弦相似度 (Cosine Similarity) 来表征语义相关性,而在某些特定空间下可能使用 欧氏距离 (L2)。

- 注意:度量方式必须与 Embedding 模型训练时的损失函数保持一致,否则会导致召回效果大幅下降。

- 近似最近邻搜索 (ANN Search)

这是向量数据库的核心运行时环节,目标是在毫秒级延迟内找到“足够好”的 Top-K 结果。

- 关键点:理解“近似”的含义——为了速度牺牲了绝对的精确度。

- 参数调优:面试中常问及如何调整搜索参数(如 HNSW 的

efSearch)来平衡 QPS(每秒查询数)与召回率。

- 后处理与重排序 (Post-process & Reranking)

向量召回(Retrieval)通常作为粗排阶段,其结果往往包含噪声,需要进一步精炼。

- 关键点:包括基于元数据的前置/后置过滤 (Filtering),以及引入更精细的模型(如 Cross-Encoder)进行精排 (Reranking)。

- 混合检索:在 RAG 等复杂场景中,还需要通过 RRF (Reciprocal Rank Fusion) 等算法,将向量检索结果与关键词检索(BM25)结果进行融合,以提升最终结果的准确性和鲁棒性。

为什么“全链路思维”是高级岗位的必考题?

对于初级工程师,面试官可能只关注“你会用哪个库”;但对于高级或架构师岗位,面试重点在于Trade-off(权衡)。

例如,RAG 系统的架构设计中,如果召回率偏低,问题可能不出在 ANN 算法上,而是源于 Embedding 模型的语义表达能力不足,或者是数据预处理时的切片策略不当。只有具备全链路视野,才能在出现延迟过高或结果不准时,快速定位是应该优化索引参数(ef、M),还是应该更换重排序策略。

在接下来的部分,我们将深入拆解这些环节中的高频技术难点,特别是 HNSW 索引的底层原理与调优实战。

核心组件一:索引原理与 HNSW 调优深挖

在当前的向量检索面试中,HNSW (Hierarchical Navigable Small World) 几乎是内存型向量检索的“事实标准”。相比于传统的 IVF(倒排文件)索引,HNSW 在处理高维数据时表现出了卓越的性能,特别是在对延迟极其敏感的场景下。

对于高级候选人而言,仅仅解释“它是一个图”是远远不够的。面试官期望你能够从算法演进的角度,清晰阐述从 NSW(Navigable Small World)到 HNSW 的核心优化逻辑:

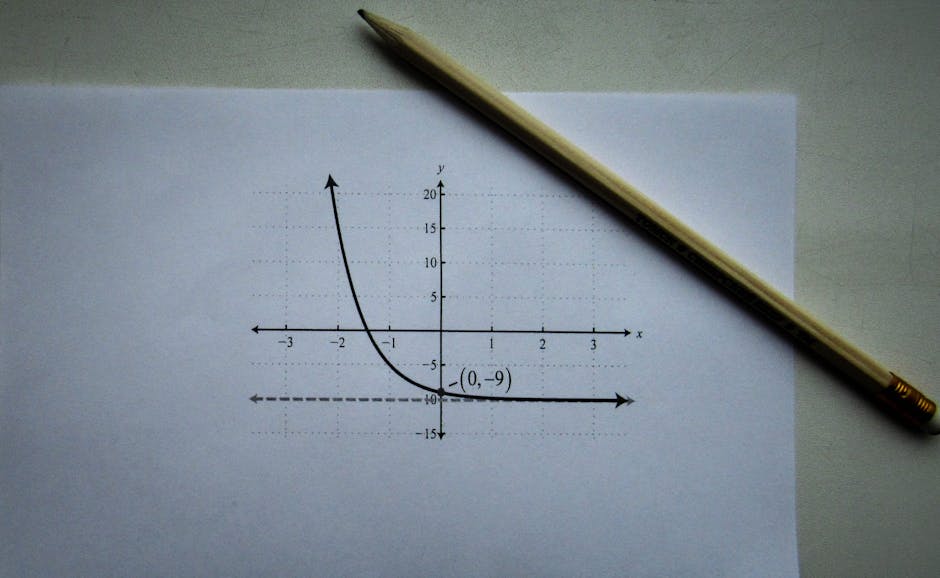

- NSW (Navigable Small World) 的局限:NSW 基于“小世界理论”构建近邻图,通过贪婪路由(Greedy Routing)在图中寻找最近邻。虽然它保证了节点间的连通性,但在大规模数据下,搜索路径可能过长,导致查询效率退化为 甚至更差。

- HNSW 的“分层”跃迁:HNSW 引入了类似 跳表 (Skip-List) 的分层结构。

- 顶层(Expressway):包含极少量的节点,用于快速缩小搜索范围,实现长距离的“跳跃”。

- 底层(Local Roads):包含所有节点,用于精细化的局部搜索。

这种结构将查询复杂度稳定降低到了 。根据 Athena 论文的研究,HNSW 通常构建约 3 层的多层近邻图,上层作为导航捷径,底层承载完整数据。

在工程落地中,HNSW 虽然提供了极高的召回率(往往超过 95%-99%)和极低的查询延迟,但其代价是 显著的内存开销(通常需要原始向量大小的 1.5 到 2 倍)以及较慢的索引构建速度。理解这种“空间换时间”的本质,是进行参数调优和系统选型的前提。

接下来的部分将深入探讨控制这一结构的核心参数,以及如何在具体的业务场景中权衡这些 Trade-off。

HNSW 关键参数:M 与 efConstruction 的 Trade-off

在面试中,深入理解 HNSW(Hierarchical Navigable Small World)的参数调优是区分“调包侠”与资深工程师的分水岭。HNSW 的核心结构类似于多层跳表(Skip-List)与小世界图(Small World Graph)的结合:底层包含所有数据点,上层则是稀疏的导航层。

这种分层结构决定了其性能高度依赖于两个核心构建参数:M 和 efConstruction,以及一个搜索时参数 efSearch。

1. 参数核心定义与物理含义

- M (Max Links per Node):

决定了图中每个节点最大允许连接的边数(邻居数)。M控制了图的连通密度。 - 物理意义:M 越大,图越稠密,节点间的“高速公路”越多,导航到目标点的步数可能更少,且抗“孤岛效应”能力更强。

- 代价:每增加一条边,都需要额外的内存存储邻接表。

- efConstruction (Size of the Dynamic Candidate List):

决定了在构建索引(插入新节点)过程中,算法在每一层搜索最近邻时维护的候选列表大小。 - 物理意义:

efConstruction决定了建图时的“视野范围”。视野越大,找到的邻居越精准,构建出的图质量越高(“导航路标”更准确)。 - 代价:直接影响索引构建耗时。

- 物理意义:

- efSearch (Search Queue Size):

查询时的动态列表大小。这是一个运行时参数,不需要重新构建索引即可调整。 - 物理意义:类似于贪心搜索中的“回溯步数”或“探索广度”。

2. 参数调优 Trade-off 对比表

在工程实践中,我们通常需要在内存、写入速度(建索引速度)、查询延迟和召回率之间做权衡。以下是各参数增加时的连锁反应:

参数 | 对 索引构建时间 的影响 | 对 内存占用 的影响 | 对 查询召回率 (Recall) 的影响 | 对 查询延迟 (Latency) 的影响 |

|---|---|---|---|---|

M (增加) | 显著增加 (需计算更多距离) | 显著增加 (存储更多边) | 提升 (尤其是高维数据) | 轻微增加 (单步计算量变大) |

efConstruction (增加) | 剧烈增加 | 无直接影响 | 提升 (图质量更好) | 无直接影响 (仅影响图结构) |

efSearch (增加) | 无影响 | 无影响 | 显著提升 | 显著增加 |

面试高频考点:为什么efConstruction通常要设置得比efSearch大?

因为索引构建是一次性的(或增量的),我们希望图的基础结构尽可能完美(High Quality Graph),以便在查询时可以用较小的efSearch就能获得不错的召回率,从而实现“慢写入、快读取”。

3. 场景化调优策略

根据业务场景的不同(读多写少 vs 写多读少),参数的选择策略截然不同:

- 场景 A:Read-Heavy(电商搜索、RAG 知识库)

- 目标:极致的查询低延迟和高召回。

- 策略:

- 拉高

M(例如 32~64):牺牲内存换取更好的图连通性,特别是对于高维向量(如 768d 或 1536d),较大的 M 能显著提升召回率稳定性。 - 拉高

efConstruction(例如 100~500):忍受较慢的构建时间,确保生成的图质量极高。 - 运行时微调

efSearch:上线后根据延迟 SLA 动态调整efSearch,在召回率和 QPS 之间找到平衡点。

- 拉高

- 场景 B:Write-Heavy / Real-time(实时推荐流、日志分析)

- 目标:数据实时写入,不能阻塞,对内存敏感。

- 策略:

- 适度降低

M(例如 8~16):HNSW 的内存开销主要来自存储边,降低 M 是优化内存占用最直接的手段。 - 克制

efConstruction:过高的efConstruction会导致单条数据插入延迟飙升(Insert Latency),可能阻塞写入流。 - 接受召回率折损:在实时流场景中,通常可以接受 95% 左右的召回率,而不需要追求 99% 以上。

- 适度降低

- 场景 C:内存受限(Edge Device / Cost Saving)

- 如果内存是瓶颈,HNSW 可能不是最佳选择,因为其内存膨胀系数通常是原始数据的 1.5-2 倍。此时应考虑结合 PQ (Product Quantization) 量化技术,或者切换到内存更友好的 IVF 索引类型。若必须使用 HNSW,则必须严格限制

M的大小。

- 如果内存是瓶颈,HNSW 可能不是最佳选择,因为其内存膨胀系数通常是原始数据的 1.5-2 倍。此时应考虑结合 PQ (Product Quantization) 量化技术,或者切换到内存更友好的 IVF 索引类型。若必须使用 HNSW,则必须严格限制

通过量化分析这些参数的 Trade-off,不仅能展示你对算法原理的理解,更能体现出解决实际工程问题的能力——即在资源约束下寻找最优解。

内存优化必问:向量量化 (PQ) 与倒排索引 (IVF)

在面试中,许多候选人能熟练背诵 HNSW 的图遍历算法,但在面对“十亿级(Billion-scale)向量如何上线”这类考察资源边界的问题时却往往卡壳。HNSW 虽然在召回率和延迟上表现优异,但其基于图的结构需要存储大量的邻居节点关系,显存/内存消耗极高。当数据量突破单机内存瓶颈时,向量量化(Quantization)与倒排索引(IVF, Inverted File Index)便成为了必不可少的优化手段。

1. 为什么需要量化与倒排?

原始的稠密向量通常是 float32 类型,一个 768 维的向量约占用 3KB 空间。如果是 1 亿个向量,仅原始数据就需要约 300GB 内存,这还不包括索引结构(如 HNSW 的图连接)带来的额外开销。

- 倒排索引 (IVF):解决的是“搜索范围过大”的问题。它通过聚类(如 K-Means)将向量空间划分为多个 Voronoi 单元(Bucket/Cluster)。检索时,只在距离查询向量最近的几个 Bucket 内搜索,而非全量扫描。

- 乘积量化 (PQ):解决的是“单向量体积过大”的问题。它是一种有损压缩技术,通过将高维向量切分成多个低维子空间,并用各子空间的聚类中心 ID 代替原始浮点数,从而大幅降低内存占用。

2. 通俗解释乘积量化 (PQ)

面试时可以用一个直观的例子来解释 PQ 的原理:

假设你有一个 128 维的向量。

- 切分(Splitting):将其切分为 8 个子段,每段 16 维。

- 聚类(Clustering):对每一段所在的 16 维子空间分别进行 K-Means 聚类(例如聚成 256 类)。

- 编码(Encoding):将原来的 16 个浮点数替换为它所属聚类中心的 ID(0-255,仅需 8 bit)。

- 结果:原本需要

128 * 32 bit的向量,现在变成了8 * 8 bit,内存压缩比极高。

虽然 PQ 会引入精度损失(Reconstruction Loss),但在大规模检索场景下,这种“空间换时间、精度换规模”的权衡是工业界的标准解法。

3. 算法对比与选型策略

在回答“如何选择索引类型”时,建议使用对比表格来展示你对技术权衡(Trade-off)的理解:

索引类型 | 内存消耗 | 查询延迟 | 召回率 (Recall) | 适用场景 |

|---|---|---|---|---|

Flat (暴力搜索) | 高 (原始向量) | 极高 (全量扫描) | 100% | 小规模数据 (<100k),作为 Ground Truth 基准 |

HNSW | 极高 (向量+图边) | 极低 (<5ms) | 极高 (>98%) | 追求极致性能,内存充足,千万级以下数据 |

IVF-Flat | 高 (原始向量) | 中 (倒排加速) | 高 | 内存能装下原始向量,但需要加速检索 |

IVF-PQ | 极低 (压缩后) | 中/低 | 中/高 (依赖参数) | 十亿级大规模数据,内存受限场景 |

4. 实战经验:由 HNSW 迁移至 IVF-PQ 的内存保卫战

面试官非常看重“解决实际问题”的能力。你可以分享一个类似的优化案例,展示你对参数调优的掌控力:

War Story: 4倍内存优化实录

“在之前的项目中,我们的向量库从 2000 万增长到 1 亿,原本的全内存 HNSW 索引导致服务器成本激增,且频繁触发 OOM(内存溢出)。我们决定迁移到 IVF-PQ 方案。

实施步骤:

1. 训练聚类中心:使用 50 万采样数据训练 IVF 的聚类中心(nlist=4096)。

2. 量化压缩:将 768 维向量切分为 64 个子空间(m=64),每个子空间使用 8 bit 编码。

3. 重排优化(Rerank):由于 PQ 是有损压缩,召回的 Top-K 顺序可能不准。我们策略是先用 IVF-PQ 快速召回 Top-200,再读取磁盘上的原始向量进行精排(Refine),最终截取 Top-10。

最终效果:单机内存占用减少了 4 倍以上,虽然单纯 PQ 的召回率下降了约 5%,但配合重排策略后,最终业务指标的 Recall@10 仅损失不到 2%,完全在可接受范围内。”

这种回答方式不仅展示了你懂算法原理(IVF/PQ),还体现了工程思维(Rerank 补救精度损失),是高级工程师面试中的加分项。

核心组件二:召回策略与混合检索 (Hybrid Search)

在面试中,从“如何存储数据”(索引)过渡到“如何找到数据”(召回)是展示系统设计能力的关键环节。初级候选人往往认为“向量检索”是解决所有搜索问题的万能钥匙,而资深工程师则深知 Vector Search is not a silver bullet(向量检索并非银弹)。在生产环境,特别是 RAG(检索增强生成)场景下,单纯依赖语义检索往往会导致“由于过度泛化而丢失精确信息”的问题。

为什么单纯的向量检索不够用?

稠密向量(Dense Vector)擅长捕捉语义关联(例如将“网络不通”与“连接超时”关联),但在处理以下场景时存在天然缺陷:

- 精确匹配失效:当用户查询特定的产品型号(如 "iPhone 15 Pro Max")或错误代码("Error 503")时,语义模型可能会召回大量泛泛的“智能手机”或“服务器错误”文档,而丢失了精确的目标。

- 长尾与 OOV 问题:预训练模型对于未登录词(Out-of-Vocabulary)、行业黑话或特定缩写往往理解能力有限。

混合检索架构 (Hybrid Search)

为了解决上述问题,工业界普遍采用 混合检索(Hybrid Search) 策略,即“语义检索 + 关键词检索”的双路或多路召回模式。在回答此类问题时,建议描述一个完整的“召回 + 重排”链路:

- 多路召回 (Multi-way Recall):

- 语义路:使用 Embedding 向量进行 ANN 检索,保证语义覆盖率。

- 词法路:使用 BM25 或倒排索引,保证关键词的精确匹配。

- 稀疏向量路:引入如 SPLADE 等稀疏向量技术。根据 腾讯云的技术实践分析,稀疏向量并非稠密向量的压缩,而是对全文搜索的一种替代和增强;IBM 的研究也指出,采用 BM25 + 稠密向量 + 稀疏向量 的“三路召回”往往是 RAG 系统的最佳选择。

- 结果融合 (Fusion):

由于不同链路的打分机制不同(例如 BM25 的分数无上限,而余弦相似度在 0-1 之间),直接相加往往不可行。面试中应提及 RRF (Reciprocal Rank Fusion, 倒数排名融合) 算法,它基于排名而非绝对分数来合并结果,具有很强的鲁棒性。 - 重排序 (Reranking):

在召回 Top-K(例如 500 条)后,通常会接入一个精度的 Cross-Encoder 模型(如 ColBERT 或 BGE-Reranker)进行重排。虽然增加了延迟成本,但这能显著修正召回阶段的噪声,是提升最终准确率(Precision@K)的关键手段。

掌握了召回策略的宏观架构后,我们还需要深入微观层面,去审视决定检索质量的最基础数学工具——距离度量。

距离度量陷阱:余弦相似度 (Cosine) vs 欧式距离 (L2)

这是一个经典的“过滤器”问题。面试官询问你使用的距离度量(Metric),往往不是为了考察数学公式,而是为了确认你是否理解向量归一化(Normalization)对检索性能和精度的影响。

在向量检索的实际生产环境中,选择度量标准通常遵循以下决策路径:

1. 三种核心度量的本质区别

首先,你需要清晰地界定三种常用度量的物理含义,这是回答的基础:

- 欧式距离 (L2 / Euclidean Distance): 衡量多维空间中两点之间的直线距离。

- 适用场景: 当向量的模长(Magnitude)包含重要信息时使用。例如,在某些特定的推荐场景中,模长可能代表用户的活跃度或商品的权重。

- 直觉: 就像现实生活中两点之间的物理距离。

- 余弦相似度 (Cosine Similarity): 衡量两个向量在方向上的夹角余弦值。

- 适用场景: 语义检索的主流选择。因为在语义空间中,我们主要关注“方向”(即内容的含义),而不是“长度”(例如文本的长短)。

- 直觉: 两个向量指向的方向越一致,相似度越高(最高为 1),与它们有多长无关。

- 内积 (IP / Inner Product / Dot Product): 两个向量对应维度的乘积之和。

- 适用场景: 极致追求检索性能的工程实现。

2. 面试高分点:归一化后的“等价性”与性能优化

这是区分初级和高级候选人的关键点。你需要指出:在大多数语义检索模型(如 BERT, OpenAI Embeddings)中,输出的 Embedding 向量通常已经被归一化(或者应当被归一化)到单位长度(Unit Length)。

当向量 和 都经过 L2 归一化(即 )后,这三者在排序结果(Ranking)上是等价的,但在计算效率上天差地别:

- 数学等价性:

- Cosine = Inner Product(因为分母都是 1)。

- L2 距离与 Cosine 呈单调反比关系()。这意味着,L2 距离越小,Cosine 相似度越大。

- 结论: 对于归一化向量,使用 L2、Cosine 或 IP 进行 Top-K 召回,得到的结果列表是完全一样的。

- 工程性能(The "Why IP?"):

- 虽然结果一样,但计算成本不同。

- L2 需要计算平方差、求和、开方。

- Cosine 需要计算点积,还要除以模长(如果未预先归一化)。

- Inner Product (IP) 只需要乘法和加法。

- 决策: 在生产环境中,为了降低延迟(Latency),我们通常会在入库前或模型输出层强制对向量做归一化,然后在向量数据库(如 Milvus, Faiss, Elasticsearch)中配置 Metric Type = IP。这能利用 CPU SIMD 指令集最高效地完成计算,同时享受 Cosine 的语义效果。

3. 常见的“L2 陷阱”

面试中常会追问:“如果我直接用 L2 会有什么问题?”

你需要指出的风险是:如果 Embedding 模型输出未归一化,直接使用 L2 会导致“模长偏差”。

- 场景: 假设向量 A 代表“苹果”,向量 B 代表“香蕉”,向量 C 代表“苹果手机”。

- 问题: 如果模型训练导致长文本或高频词生成的向量模长特别大,原本语义不相关的向量可能仅仅因为模长接近,在 L2 距离上反而比语义相关的向量更近。

- 修正: 除非你有明确的业务理由保留模长信息(例如模长代表置信度),否则在语义搜索中,必须对向量进行归一化,消除模长对相似度计算的干扰。

回答话术总结:

“在我们的系统中,虽然业务逻辑上关注的是语义相似度(即 Cosine),但在工程实现上,我们选择 Inner Product (IP)。因为我们的 Embedding 在入库前都做了 L2 归一化,此时 IP 与 Cosine 在数学上等价,但 IP 计算指令更少,在大规模召回(如 IVFFlat 或 HNSW 索引)中能显著降低 CPU 开销并减少查询延迟。”

RAG 场景下的混合检索策略 (Dense + Sparse)

在 RAG(检索增强生成)系统的面试中,面试官经常会追问一个经典痛点:“如果用户查询的是具体的型号代码(如 iPhone 15 Pro Max)或特定的错误代码(如 Error 503),纯向量检索的效果往往不如传统的关键词搜索,怎么解决?”

这个问题直指 “词汇鸿沟”(Lexical Gap) 现象。虽然 Dense Vector(稠密向量)擅长捕捉语义关联(例如将“手机”与“移动设备”关联),但在处理精确匹配、专有名词、缩写或序列号时,其表现往往不如基于倒排索引的关键词检索。

1. 为什么需要混合检索(Hybrid Search)

在生产环境中,单靠 Embedding 召回容易导致 RAG 系统出现“幻觉”。

- 场景案例:用户查询“A-100 显卡的显存参数”。

- 纯向量检索的问题:Embedding 模型可能认为“A-100”与“H-100”或“高端显卡”在语义上极度相似,从而召回了错误的文档块。

- 后果:LLM 基于错误的召回内容(Context),自信地回答了 H-100 的参数,导致事实性错误。

为了解决这一问题,业界标准的解决方案是采用 混合检索(Hybrid Search),即同时结合:

- Sparse Retrieval(稀疏检索):基于 BM25 或 SPLADE 算法,侧重于关键词的精确匹配(Term Matching)。

- Dense Retrieval(稠密检索):基于 Embedding 向量,侧重于语义理解(Semantic Matching)。

2. 核心架构与融合算法 (RRF)

面试中需要能清晰描述这两路检索是如何合并的。最通用的方法是 倒数排名融合(Reciprocal Rank Fusion, RRF)。

RRF 不依赖于分数的绝对值(因为 BM25 的得分和余弦相似度的得分分布不同,难以直接加权),而是基于排名的位置进行融合。其基本公式逻辑如下:

- 并行检索:系统同时向向量数据库发起向量搜索请求,并向搜索引擎(或支持全文检索的向量库)发起关键词搜索请求。

- 结果融合:对两路返回的 Top-K 文档进行 RRF 计算,重新排序。

- 优势:这种方式不需要对分数进行归一化处理,鲁棒性极强。

3. 技术选型与工具支持

在回答技术选型时,可以提到现代向量数据库对混合检索的原生支持,这体现了你对技术选型实战的熟悉程度:

- Qdrant / Milvus:支持在同一 Collection 中存储稠密向量和稀疏向量(Sparse Vector),并能在内部直接执行混合检索。

- Elasticsearch / OpenSearch:传统的搜索引擎增加了

knn_search功能,是实现“以词为主,向量为辅”架构的常见选择。 - Faiss:虽然作为底层库主要关注稠密向量,但在复杂架构中常与 Lucene 结合使用以支持混合检索架构。

面试加分项:

提到 Re-ranking(重排序)。在混合检索召回 Top-50 或 Top-100 个文档后,引入一个高精度的 Cross-Encoder 模型(如 BGE-Reranker)对结果进行二次精排,是目前提升 RAG 准确率(Recall@K)最有效的手段之一。这一步虽然增加了延迟,但能显著修正“词汇鸿沟”带来的相关性偏差。

进阶难点:分布式架构与生产环境挑战

在面试中,初级工程师通常关注算法原理(如 HNSW 怎么连边),而高级工程师则必须关注系统设计(System Design)。当向量数据规模从百万级(单机内存可存)跃升至十亿级,或者 QPS 要求从几十飙升至上万时,单纯的算法调优已无法解决问题,必须引入分布式架构。

这一部分的考察重点在于你是否理解资源边界(Memory-bound vs. CPU-bound)以及分布式系统中的权衡(Trade-offs)。

1. 扩展性设计的核心:分片(Sharding)与副本(Replication)

在生产环境中,单机内存往往无法容纳海量的高维向量索引。面试官可能会问:“当数据量达到 10 亿级时,如何设计系统?”此时需要明确区分分片与副本的不同职责:

- 分片(Sharding)解决存储与写入瓶颈:

- 原理:将巨大的向量集合(Collection)切分为多个分片(Shard/Partition),分布在不同的物理节点上。

- 向量场景特异性:与传统数据库不同,向量索引(特别是 HNSW)通常需要常驻内存以保证低延迟。如果 10 亿向量占用 3TB 内存,必须通过水平分片(Horizontal Sharding)将内存压力分散到多台机器。

- 查询路径:查询时通常需要“Scatter-Gather”(分散-聚合),即向所有分片发送请求,汇总 Top-K 结果后再重排序。这会带来网络开销,因此分片数量不宜过大。

- 副本(Replication)解决读取(QPS)与高可用瓶颈:

- 原理:为每个分片创建多个镜像副本。

- 场景:向量计算是计算密集型(CPU-bound)任务。如果单节点只能支撑 500 QPS,而业务需求是 5000 QPS,则需要增加副本数来分担查询流量。

- 故障转移:腾讯云向量数据库设计架构 中提到,副本机制是保障系统可靠性的关键,当主节点宕机时,副本可立即接管读写服务。

2. 向量数据库的一致性挑战

“刚插入的向量,为什么搜不到?”这是面试中关于一致性(Consistency)的经典追问。

- 最终一致性(Eventual Consistency)的必然性:

在分布式向量数据库中,追求强一致性往往意味着巨大的性能损耗。Milvus 的技术博客 指出,虽然大规模系统常用最终一致性,但在欺诈检测等关键场景可能需要更严格的一致性模型。 - 索引构建的延迟:

向量写入不仅仅是落盘(WAL),更重要的是构建索引。HNSW 等图索引的动态插入涉及复杂的节点连接和重平衡,极其消耗资源。 - 实时性陷阱:生产系统中常采用“流式写入 + 准实时索引”或“LSM-Tree 架构”(增量数据先在内存暴力搜索,定期合并到底层索引)。面试时需指出:数据可见性(Visibility)通常滞后于写入完成。

3. 冷启动与索引维护成本

除了读写,运维成本也是高级面试的考察点,特别是针对“有状态”的向量服务:

- 冷启动(Cold Start):

重启一个拥有 100GB HNSW 索引的节点是痛苦的。如果采用全量加载到内存(mmap 虽快但可能有缺页中断导致的延迟抖动),启动时间可能长达数分钟甚至数十分钟。 - 解决方案:生产环境常采用预热(Pre-warming)策略,在流量切入前强制将索引数据加载至 RAM。

- 脏数据与重索引(Re-indexing):

HNSW 等算法在处理大量删除操作时,通常只是标记删除(Soft Delete),节点依然存在于图中,影响搜索效率。 - 生产实践:需要定期执行“Compaction”或重建索引操作,以清理无效节点并优化内存布局。这一点与传统数据库的 Vacuum 机制类似,但在向量场景下计算成本更高。

面试避坑指南:不要只背诵 CAP 理论。应结合向量检索的特性(计算密集、内存依赖大)来谈架构。例如,可以提到在 RAG 场景中,为了保证回答的准确性,可能需要配置“Read-your-writes”的一致性级别,但这会牺牲写入吞吐量。

效果评估:如何量化你的检索质量

在面试中,仅仅回答“我们使用了 HNSW 索引”是远远不够的。面试官通常会追问:“你的检索召回率是多少?在什么延迟要求下达到的?QPS 峰值是多少?”。对于资深工程师而言,检索质量不仅仅是一个算法选择问题,更是一个在精度(Recall)、延迟(Latency)和成本(Cost/Memory)之间寻找最优解的工程问题。

核心指标定义与业务含义

在回答评估问题时,建议围绕以下三个核心指标构建你的答案框架,并结合具体的业务场景数据:

- Recall@K(召回率)

这是衡量检索准确性的黄金标准。它表示在你的 ANN(近似最近邻)检索结果的前 K 个候选中,包含了多少个真实的最近邻(Ground Truth)。

- 面试话术:不要只说“召回率很高”。应表述为“在 Top-100 的截断下,我们的 Recall@100 达到了 98%”。

- 注意:对于 RAG 场景,单纯的向量召回率高不代表最终回答准确,但它是基础。正如相关分析指出,技术侧必须确保“找得到、找得对”,否则模型生成就是无米之炊。

- Latency(延迟 P95/P99)

平均延迟(Avg Latency)往往具有欺骗性,生产环境更关注长尾延迟。

- 关键点:明确区分 P99(99% 的请求都在该时间内完成)。例如,在 AWS 的 OpenSearch 测试案例中,即使是 10 亿级向量,P99 延迟也被控制在 32.2 毫秒以内。如果你的简历上写了极低的平均延迟,面试官可能会挑战你的 P99 数据,以考察系统的稳定性。

- QPS(每秒查询数/吞吐量)

这是衡量系统并发能力的指标。高并发往往意味着资源争抢,从而导致延迟上升或召回率抖动。

关键权衡:Recall vs. Latency 曲线

这是面试中最高频的考点之一。你必须展示你理解“召回率不是一个固定的属性,而是一个可供调节的动态参数”这一核心概念。

大多数 ANN 算法(如 HNSW 或 IVF)都允许你在查询时通过参数调整精度和速度的平衡:

- HNSW:通过调整

efSearch(或ef)。efSearch决定了搜索过程中动态候选列表的大小。值越大,搜索越深入,召回率越高,但延迟增加,QPS 下降。 - IVF:通过调整

nprobe。nprobe决定了搜索多少个聚类中心(Voronoi cells)。搜索的桶越多,越不容易漏掉最近邻,但计算量成倍增加。

实战数据举例:

根据详细的算法对比数据,HNSW 在 1K QPS 下可能维持 99.5% 的 Recall@10,但在 100K QPS 的高压下,为了维持吞吐,召回率可能会跌至 92.1%。在面试中,你可以画出这样一条曲线:横轴是 QPS,纵轴是 Recall,解释你的系统是如何根据业务对延迟的 SLA(服务等级协议)来选择这一工作点的。

Ground Truth(真值)的构建

一个常见的陷阱是:“如果不用暴力搜索,你怎么知道 ANN 检索漏掉了正确答案?”

在离线评估阶段,你必须通过暴力搜索(Brute-force / Flat Index)或者是精确的 k-NN 算法来生成基准数据(Ground Truth)。

- 选取一部分查询集(Query Set)。

- 使用暴力全量扫描计算出数学上绝对准确的 Top-K。

- 将 ANN 索引返回的结果与这份 Ground Truth 进行比对,计算重合度。

不要混淆“业务点击率”与“向量召回率”。前者受排序模型和用户界面影响,而后者纯粹衡量向量索引的近似搜索能力。

面试前准备清单(Checklist)

在进入面试前,请确保你对你负责的系统有以下清晰的量化认知:

- [ ] 数据规模:向量维度(如 768, 1536)和总条数(千万级 vs 亿级)。

- [ ] 性能基准:当前的 Recall@K 是多少?对应的 P99 延迟是多少?

- [ ] 调优经验:你是否调整过

efSearch、M或nprobe?调整后带来了什么具体的指标变化(例如:“我们将 nprobe 从 10 降到 5,召回率仅损失 0.5%,但 QPS 提升了 40%”)? - [ ] 资源开销:索引占用了多少内存?是否使用了量化(PQ/SQ)来压缩内存?HNSW 的内存占用通常较高(原始数据的 1.5-2倍),你是如何处理这一成本问题的?

通过这些具体的数据和权衡逻辑,你将从一个只会调包的开发者,转变为一个能够驾驭大规模检索系统的资深工程师。