在深度学习的残酷竞技场中,过拟合不仅是模型训练的头号大敌,更是区分初级调参侠与资深算法工程师的分水岭。尽管教科书式的“Dropout 加 L2 正则化”在理论上构建了基础防御体系,但在面对过参数化的现代深度模型(如 Vision Transformer)与高维稀疏数据时,这些传统手段往往因破坏特征连续性或约束力度不足而显得捉襟见肘。当验证集 Loss 震荡不降,或者 Public LB 与 Private LB 出现严重分布偏移时,仅仅依赖 Early Stopping 无异于掩耳盗铃,无法触及泛化能力的本质天花板。事实上,为了在 Kaggle 激烈的 Leaderboard 上挤进金牌区,或者在工业界的小样本 SOTA 冲榜中突围,我们需要引入更为激进且数学直觉深刻的“黑科技”。这不仅涉及 Mixup 与 CutMix 等打破样本边界的流形混合策略,更包括 Label Smoothing 对决策边界的平滑处理、DropBlock 对空间相关性的结构化破坏,以及对抗训练(Adversarial Training)带来的鲁棒性提升。现代 SOTA 方案的核心逻辑已从显式的权重约束转向了隐式的正则化诱导,通过 R-Drop 的一致性约束与 Flooding 的损失控制,强制模型学习更具鲁棒性的全局特征而非局部噪声。掌握这些偏门但高效的技巧,不仅能让你在面试中展现对底层原理的深刻理解,更能为你的模型构建一套超越传统范式的防御机制,在泛化性能的极限博弈中立于不败之地。

为什么标准的“Dropout + L2”已经不够用了?

如果你在面试中被问到“如何防止过拟合”,标准的教科书式回答通常是:“增加数据量、使用 Dropout、添加 L2 正则化(权重衰减)以及 Early Stopping”。这些方法在经典的机器学习任务或简单的全连接网络中确实行之有效,但在面对现代深度学习模型(如深层 ResNet、Transformer)和高竞争强度的场景(如 Kaggle 竞赛或工业界的小样本 SOTA 冲榜)时,这套“老三样”往往显得力不从心。

传统方法的局限性

标准的正则化手段在过参数化(Over-parameterized)的现代模型面前存在明显的理论与实践短板:

- Dropout 的失效:在卷积神经网络(CNN)中,特征图(Feature Map)的激活单元在空间上具有极强的相关性。传统的 Dropout 随机丢弃独立的像素或神经元,网络依然可以通过相邻的激活单元轻松推断出丢失的信息,导致正则化效果大打折扣。正如 DropBlock 的研究所指出的,只有丢弃连续的“块状”区域,才能真正迫使网络学习更鲁棒的特征,而非依赖局部相关性。

- L2 的天花板:L2 正则化本质上是限制权重的范数,假设“更小的权重意味着更简单的模型”。然而,深度神经网络的解空间极其复杂,很多时候我们需要模型在某些维度上保持较大的权重以捕捉细微特征,单纯的权重压缩反而可能导致欠拟合或训练困难。

- Kaggle 场景的特殊性:在竞赛或实际业务中,我们面临的往往不是单纯的“训练集 vs 测试集”泛化问题,而是Public Leaderboard(LB)与 Private LB 的分布偏移。仅仅依赖 Early Stopping 监控验证集 Loss,极易导致对验证集或 Public LB 的过拟合。

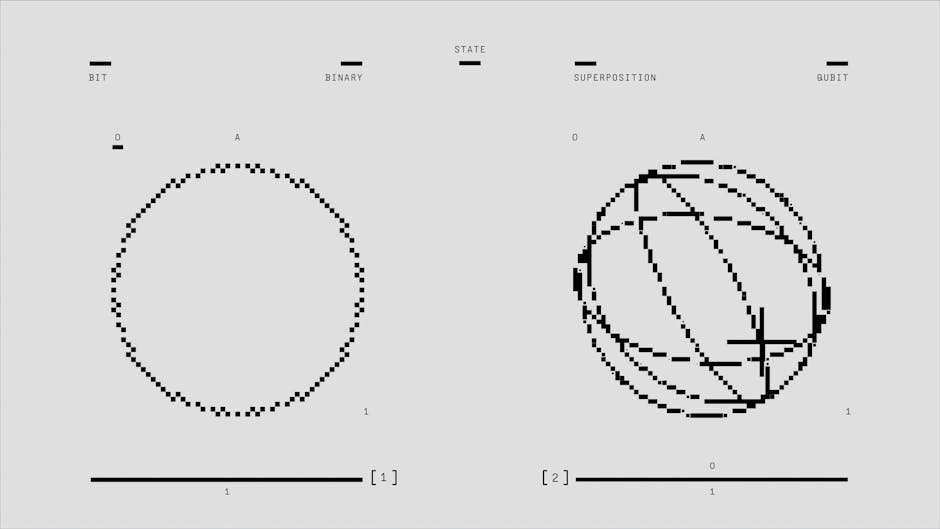

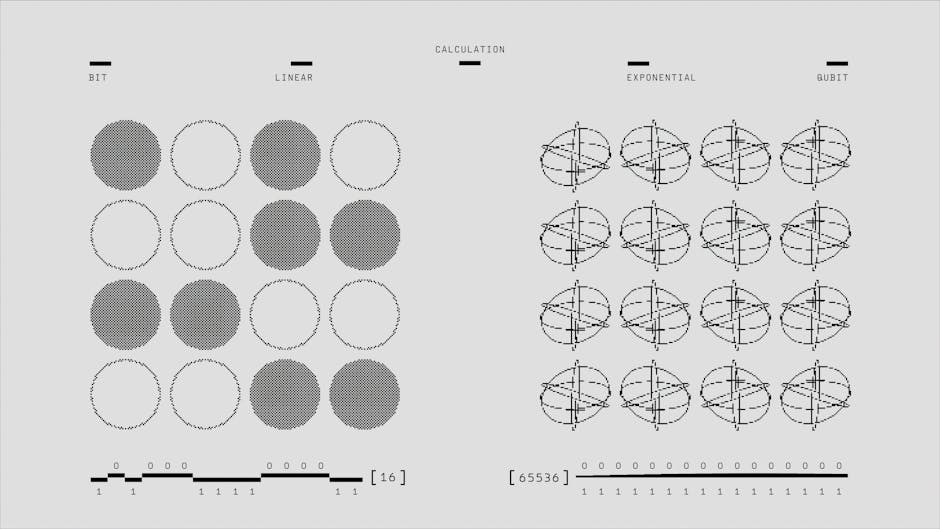

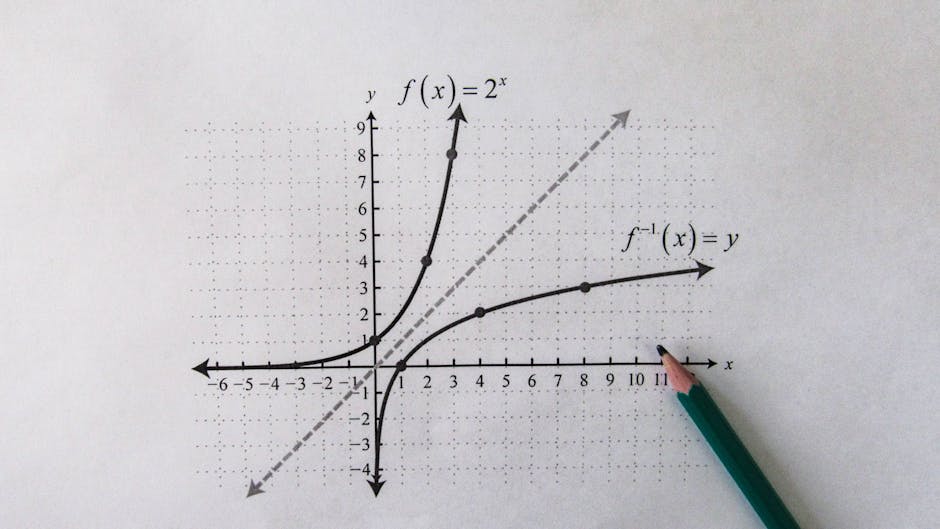

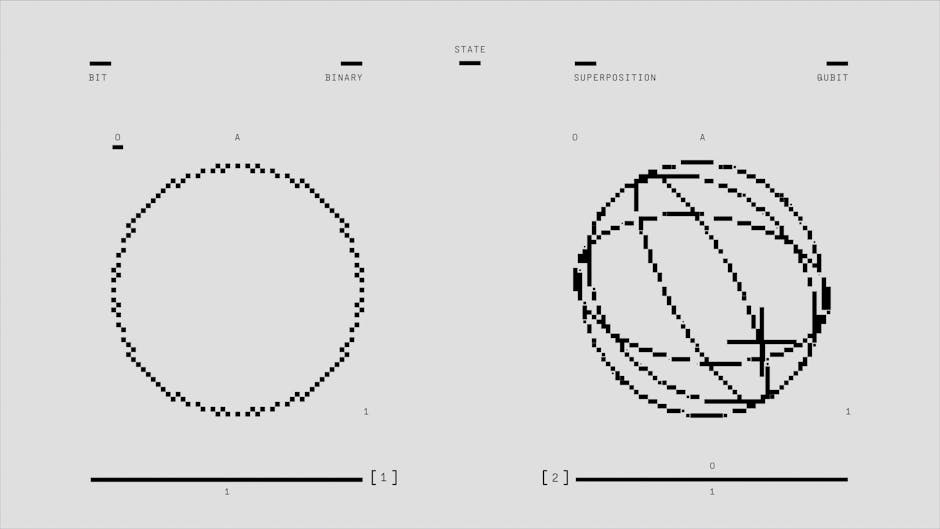

显式正则化 vs. 隐式正则化

要理解为什么需要“偏门”解法,需要区分两种正则化逻辑:

- 显式正则化 (Explicit Regularization):直接修改损失函数或网络结构,如 L2 (

loss + lambda * w^2) 或 Dropout。 - 隐式正则化 (Implicit Regularization):通过改变数据分布、优化算法的动态特性或训练流程来达到正则化效果。例如 SGD 本身引入的噪声、Batch Size 的选择,以及本文将重点介绍的 Mixup、Flooding 等技术。

现代 SOTA 方案更多地转向了数据流形(Manifold)层面的操作和损失函数的魔改,而非简单地给权重加锁。

核心防御体系:从入门到“黑科技”

为了让你在面对过拟合时有更多的武器储备,我们将防御手段分为“基础”与“进阶/偏门”两类。以下列表旨在帮助你快速建立知识索引(Snippet-Ready):

- 🛡️ 基础防御 (Standard Methods)

- Dropout: 随机丢弃神经元(对 CNN 效果有限)。

- L1/L2 Regularization: 权重衰减,稀疏化参数。

- Early Stopping: 监控验证集指标,适时停止训练。

- Batch Normalization: 虽主要用于加速收敛,但也提供了一定的噪声正则化效果。

- 基础数据增强: 旋转、裁剪、翻转(仅保留语义)。

- 🚀 进阶与偏门解法 (Advanced & Niche Tricks)

- 流形混合类 (Manifold Mixup): Mixup、CutMix,通过线性插值打破样本边界。

- 结构化丢弃 (Structural Dropout): DropBlock,针对 CNN 空间相关性的区域丢弃。

- 损失函数魔改 (Loss Engineering): Label Smoothing(标签平滑)、Flooding(防止 Training Loss 过低)、Bi-Tempered Loss。

- 对抗训练 (Adversarial Training): 在输入层加入微小扰动(FGSM/PGD),强制模型对噪声鲁棒。

- 自蒸馏与一致性 (Self-Distillation): R-Drop,强制同一样本的两次 Dropout 输出保持一致。

接下来的章节,我们将跳过那些你已经烂熟于心的基础概念,重点拆解那些能让你在 Leaderboard 上提升千分之五的“偏门”黑科技。

数据层面的黑科技:不只是简单的旋转翻转

在传统的深度学习工程实践中,数据增强(Data Augmentation)往往被局限于几何变换(如旋转、翻转、缩放)或光度变换(如亮度调整)。这些“经典”操作的核心逻辑是语义保持(Semantic Preserving):即变换后的图像在人类眼中仍然是清晰可辨的“猫”或“狗”,数据点仍然停留在原始数据分布的流形(Manifold)附近。然而,在面对高容量模型(如 EfficientNet, ViT)或极度不平衡的数据集时,仅靠这些温和的扰动往往不足以防止模型对特定纹理或背景的过拟合。

现代 SOTA(State-of-the-Art)方案和 Kaggle 冠军解决方案(例如 ImageNet 或 NLP 榜单前列)早已引入了一类更激进的“黑科技”增强策略。与传统方法不同,这些技术——如混合类(Mixing)和擦除类(Erasing)策略——有意破坏或模糊样本的原始语义及物理结构。

根据 arXiv:2212.10888 的分类,这类方法通过线性插值像素与标签,或强制擦除关键信息区域,构建出人类视觉上“不自然”甚至“不可读”的训练样本。这种看似违反直觉的操作,实则在强迫模型放弃对局部特征的死记硬背,转而学习更具鲁棒性的全局特征,并有效平滑了类与类之间的决策边界。接下来的小节将深入探讨这些打破样本边界的具体技术及其背后的数学直觉。

Mixup 与 CutMix:打破样本间的边界

传统的“数据增强”(Data Augmentation)如旋转、裁剪或翻转,本质上仍然是在保持单一主要语义的前提下对样本进行微扰。这种做法虽然增加了数据的多样性,但模型在两个类别的决策边界(Decision Boundary)处往往表现得非常剧烈——即从“猫”到“狗”的判定可能在极小的像素变化下突然跳变,导致模型在对抗攻击或噪声面前显得脆弱。

Mixup 和 CutMix 的出现彻底改变了这一逻辑:它们不再试图保持单一语义,而是通过“强行融合”两个完全不同的样本,迫使模型在样本之间的空白流形(Manifold)上学习线性的过渡关系。

Mixup:线性插值的艺术

Mixup 的核心直觉非常反直觉:给模型看一张“幽灵图”(例如一张 70% 透明度的猫叠加在一张 30% 透明度的狗上),并告诉模型这张图的标签是 [0.7, 0.3]。

从数学角度看,Mixup 在两个随机样本 和 之间进行简单的线性插值:

$$

\begin{aligned}

\tilde{x} &= \lambda xi + (1 - \lambda) xj \\

\tilde{y} &= \lambda yi + (1 - \lambda) yj

\end{aligned}

$$

其中 通常服从 Beta 分布 。

为什么这种“不自然”的数据有效?

Mixup 实际上是在执行一种称为 邻域风险最小化(Vicinal Risk Minimization, VRM) 的策略。它强迫模型在两个类别之间建立线性的过渡区域,而不是非黑即白的陡峭边界。这直接平滑了损失函数的曲面,使得梯度下降更加稳定,且显著降低了模型对未知数据的过度自信(Overconfidence)。

以下是一个简单的 PyTorch 实现逻辑片段:

# Mixup implementation snippet

alpha = 1.0

lam = np.random.beta(alpha, alpha)

# 混合输入

mixedx = lam x + (1 - lam) xshuffled

# 混合标签(计算 Loss 时使用)

criterion = nn.CrossEntropyLoss()

loss = lam criterion(pred, y) + (1 - lam) criterion(pred, y_shuffled)CutMix:解决“幽灵图”的局部性问题

虽然 Mixup 在图像分类(ImageNet)上效果显著,但它有一个缺陷:生成的图像在视觉上是不自然的模糊叠加,这可能会让模型对图像的局部特征(如纹理、边缘)产生困惑。

CutMix 提出了一种更符合人类视觉认知的混合方式:剪切并粘贴(Cut and Paste)。

CutMix 不改变像素值,而是将图像 B 的一个随机矩形区域“裁剪”下来,覆盖到图像 A 的对应位置。标签的混合比例 不再由随机分布直接决定,而是严格等于裁剪面积与总面积的比例。

CutMix 的优势在于:

- 保留了局部特征:图像中的补丁仍然是清晰、自然的物体部分(例如狗头拼在猫身上),模型被迫学习识别局部特征,而不是依赖全局统计信息。

- 增强定位能力:由于模型必须根据可见像素的面积来预测概率,它被迫关注图像中“哪里”是目标,这使得 CutMix 在目标检测(Object Detection)和弱监督定位任务中表现优于 Mixup。

- 防止信息丢失:相比于直接挖掉一块像素的 Cutout(导致信息完全丢失),CutMix 用另一张图的信息填补了空白,保持了训练信号的强度。

在 Kaggle 的计算机视觉竞赛(如 RSNA、Cassava Leaf Disease)中,CutMix 和 Mixup 几乎是 Top 方案的标配。它们不仅是防止过拟合的正则化手段,更是提升模型泛化能力的“核武器”,尤其是在数据量有限或存在噪声标签(Noisy Labels)的场景下,使用软标签(Soft Labels)训练的模型往往比使用硬标签(Hard Labels)的模型更加鲁棒。

Cutout, Random Erasing 与 GridMask:强迫模型“管中窥豹”

如果说 Mixup 是通过“混合”信息来扩充数据边界,那么 Cutout 及其变体则是通过“做减法”来倒逼模型进化。这类方法的底层逻辑非常直观:如果模型总是只盯着狗头来识别狗,那我们就把狗头挡住,强迫它去学习狗的尾巴、毛色或体态。

从“简单粗暴”到“有格调”的遮挡

在实际工程中,我们通常会经历以下几个演进阶段:

- Cutout / Random Erasing:

这是最基础的操作。在图像中随机选择一个矩形区域,将其像素值填充为 0(黑色)、255(白色)或数据集的均值。

- 直觉:模拟现实场景中的物体遮挡(Occlusion)。

- 效果:显著提升了模型的定位能力(Localization Ability)。因为模型不能再偷懒只看最显著的特征(Discriminative Parts),必须关注物体的整体上下文。

- GridMask:

Cutout 有一个明显的缺陷:对于小物体或远景图,随机的一个矩形遮挡可能会把整个目标完全盖住。这时候图片里已经没有“猫”了,但标签依然是“猫”,这就人为制造了噪声标签(Noisy Labels),反而误导了模型。

- 改进:GridMask 不再使用单一的大色块,而是生成一个网格状的掩码(Grid Pattern)。

- 优势:它既保留了部分目标信息(通过网格的缝隙),又破坏了特征的连续性。这种“藕断丝连”的方式,既避免了完全遮挡目标的风险,又维持了对模型的高强度正则化训练。

工程实践中的“坑”与警告

虽然这些方法代码实现简单(通常只需几行 Numpy 或 PyTorch Transform),但在特定场景下极易翻车:

- 小目标检测的噩梦:在 COCO 等包含大量微小物体的数据集上,慎用大面积的 Random Erasing。如果你的目标仅占画面的 1%,随机抹除很容易将其完全覆盖,导致模型训练震荡。

- 语义丢失风险:与 Mixup 不同,Cutout 是破坏性的。在使用时,建议配合目标框(Bounding Box)信息进行约束——即限制遮挡区域不要完全覆盖 Ground Truth Box,或者调节遮挡面积的比例(例如限制在原图面积的 10%-20% 以内)。

- 训练时长:由于人为增加了数据的识别难度(Hard Examples),模型往往需要更长的 Epoch 才能收敛。如果你的算力预算有限,需要权衡这一成本。

总结:这类“管中窥豹”的方法核心在于去偏见(De-biasing)。它强迫模型不再依赖局部纹理,而是学习更鲁棒的全局形状特征,是提升模型泛化能力的高性价比手段。

标签与损失函数层面的魔法 (Label & Loss Engineering)

在讨论了 Cutout、Mixup 等针对输入端(Input Space)的“暴力”数据增强后,我们需要将视线转向模型的输出端(Output Space)。很多时候,过拟合并非源于数据量不够,而是源于我们定义“正确答案”的方式过于绝对,以及惩罚错误的方式过于单一。

在标准的分类任务中,我们习惯使用 One-hot 编码(独热编码) 作为标签(例如 [0, 1, 0])。这种非黑即白的标注方式隐含了一个强假设:这张图“百分之百”是猫,且“绝对”不是狗。从数学角度来看,为了让 Cross-Entropy Loss 降到绝对的 0,Softmax 函数需要输出 1.0 的概率,这迫使模型将对应类别的 Logits 推向正无穷(Infinity)。

这种机制鼓励模型变得“过度自信(Overconfident)”。为了达到这种极端的置信度,神经网络往往会过度拟合训练数据中的噪声或非鲁棒特征(如背景纹理),从而牺牲泛化能力。本章将探讨如何通过引入“软标签(Soft Targets)”或修改损失函数的响应机制,在数学层面为模型通过“去自信化”来实施正则化,从而在源头上抑制过拟合。

Label Smoothing (标签平滑):惩罚“过度自信”

在传统的分类任务中,我们习惯使用 One-Hot 编码(Hard Labels)作为训练目标:如果一张图片是“猫”,由于 Cross-Entropy Loss 的特性,模型为了将 Loss 降到绝对的 0,会倾向于让 Softmax 的输出无限逼近 1.0。这就迫使 Logits(进入 Softmax 前的数值)趋向于正无穷。

这种机制会导致模型变得“过度自信”(Overconfident):它不仅记住了类别,还试图通过推高权重来“以此类推”地拟合训练数据中的每一个细节,包括噪声。

Label Smoothing(标签平滑) 的核心思想就是给这种自信泼一盆冷水。它不再强求模型输出完美的 1 和 0,而是将目标分布进行“软化”。

数学直觉与实现

我们将目标概率从绝对的 1 调整为 1 - ε,并将剩余的 ε 概率均匀分配给所有类别(包括正确类别本身,或者只分配给错误类别,具体实现略有差异)。

公式通常如下:

其中 是类别总数, 是平滑参数(通常取 0.1)。

例如,在一个三分类任务中,标准的 Hard Label 是 [0, 1, 0]。经过 的平滑处理后,目标变成了 [0.033, 0.933, 0.033]。

这实际上是在告诉模型:“虽然这张图大概率是类别 B,但也不要太绝对,给其他可能性留一点余地。”

为什么它能抗过拟合?

- 限制权重爆炸:由于目标概率不再是 1,模型不需要将 Logits 推向无穷大即可达到最优解。这在数学上限制了权重的范数,起到了类似 L2 正则化的作用。

- 容忍噪声:正如 Label Smoothing Explained 中指出的,这种方法让模型保持“谦逊”。当训练数据中存在错误标注(Noisy Labels)时,Hard Label 会强迫模型去拟合错误的 Ground Truth,而 Soft Label 则降低了这种错误信号的强迫性。

- 更好的校准(Calibration):研究表明,使用标签平滑训练的模型,其输出的预测概率更能反映真实的准确率(Expected Calibration Error 更低)。

适用场景与工程建议

- Default Choice for Transformers:在 BERT、Transformer 以及许多 SOTA 图像分类模型(如 EfficientNet)的训练脚本中,Label Smoothing 几乎已成为标配。

- 数据噪声较大时:如果你怀疑数据集的标注质量不高(例如通过爬虫获取的数据),Label Smoothing 是比 Dropout 更直接的防御手段。

- 对比 Hard Labels:

- Hard Labels:适合类别间界限极其分明、且标注绝对准确的简单任务。

- Soft Labels:适合类别多、特征重叠度高、或希望模型具有更好泛化能力的场景。

注意:Label Smoothing 也有副作用。它强制压低了正确类别的概率,可能会在某些需要极高置信度阈值的检索(Retrieval)任务中,导致类内距离(Intra-class distance)不够紧凑。但在纯分类任务中,它通常是稳赚不赔的买卖。

Bi-Tempered Loss 与 Focal Loss:关注难分样本

在处理过拟合问题时,我们通常习惯于在“外部”施加约束(如 Dropout 或 L2 正则化),却往往忽略了损失函数(Loss Function)本身对模型训练动力的塑造作用。标准的 Cross Entropy (CE) Loss 在面对大量简单样本时,其累积梯度往往会主导优化方向,导致模型在“舒适区”过拟合,而忽略了真正决定泛化能力的难分样本(Hard Examples)。同时,CE 对离群点(Outliers)过于敏感,容易强行拟合噪声标签。

通过替换损失函数,我们可以实现“隐式正则化”,在优化景观(Optimization Landscape)层面重塑模型的学习偏好。

Focal Loss:不仅仅用于目标检测

虽然 Focal Loss 最初是为了解决单阶段目标检测(One-Stage Object Detection)中极端的正负样本不平衡问题而提出的,但它在分类任务中也是一种极佳的正则化手段。

Focal Loss 在标准 CE 的基础上引入了一个调节因子 。其核心机制在于动态调整样本权重:

- 降低简单样本权重:当模型对某个样本非常有信心()时,该调节因子趋近于 0。这意味着那些已经被模型“学会”的简单样本,其产生的梯度贡献会被大幅削弱。

- 挖掘难分样本:模型被迫将注意力集中在那些预测概率较低的“难”样本上。

从过拟合的角度看,Focal Loss 防止了模型在训练后期为了进一步降低简单样本的 Loss 而过度自信(Overconfidence),这种过度自信往往是过拟合的前兆。它充当了一种“软性”的 Hard Negative Mining,迫使模型学习数据分布的边界,而不是死记硬背容易识别的特征。

Bi-Tempered Logistic Loss:应对噪声与离群点

如果说 Focal Loss 解决了“学得太容易”的问题,Google 提出的 Bi-Tempered Logistic Loss 则解决了“学得太杂”的问题。在很多真实场景或 Kaggle 竞赛中,数据集中往往包含噪声标签(Noisy Labels)或离群点。标准 CE Loss 是无界的,为了拟合一个错误的离群点,模型可能会产生巨大的梯度,导致决策边界发生剧烈扭曲,从而引发严重的过拟合。

Bi-Tempered Loss 引入了两个“温度”参数( 和 )来双向约束 Loss:

- 温度 (尾部重尾化):通过调整对数函数,使其在处理离群点时具有有界性(Boundedness)。这意味着即使面对极其离谱的样本,Loss 也不会无限增大,从而限制了单个噪声样本对梯度的破坏力。

- 温度 (Softmax 平滑化):通过调整指数函数,使概率分布具有重尾特性,保留更多的类间不确定性,起到类似 Label Smoothing 的作用。

工程实践建议:

当你的过拟合是由于数据集存在 10%~20% 的噪声标签(例如爬虫数据)导致时,直接使用 Bi-Tempered Loss 往往比单纯增加 Dropout 或数据增强更有效。它本质上是一种对噪声鲁棒的损失函数,允许模型在训练过程中“安全地忽略”那些无法被正常逻辑解释的数据点,从而保持决策边界的平滑。

网络结构与训练动力的“破坏” (Structural & Adversarial)

如果说 L2 正则化和 Early Stopping 是对模型的“温柔劝导”,那么本章节涉及的技术则更像是“暴力特训”。在 Kaggle 前排方案和 SOTA 论文的工程实践中,单纯依靠数据增强往往容易触碰天花板,资深算法工程师开始在网络结构和训练动力学(Training Dynamics)层面引入更具破坏性的机制。

这类方法的核心逻辑不仅仅是增加随机性,而是通过对网络拓扑的动态重构(如针对卷积特征的空间遮蔽)或对训练循环的深度介入(如基于梯度的对抗攻击),在训练过程中人为制造“最坏情况”或“结构性缺失”。这种“以破坏求生存”的策略迫使模型放弃对局部噪声和捷径特征(Shortcut Learning)的依赖,转而捕捉更具鲁棒性的全局特征。接下来的内容将探讨如何通过在架构和训练流中引入由于“破坏”带来的强正则化效果。

对抗训练 (Adversarial Training / FGM / PGD):以毒攻毒

在大多数工程师的认知中,对抗样本(Adversarial Examples)通常属于安全防御的范畴,用于防止模型被恶意攻击。但在 Kaggle 竞赛的前排方案(尤其是 NLP 任务)和 SOTA 论文中,对抗训练早已转身成为一种终极正则化手段。

如果说数据增强是随机地“扩充”样本,那么对抗训练就是定向地“制造”最难样本。它的核心逻辑在于Min-Max 博弈:在训练过程中,先通过梯度上升找到让当前 Loss 最大的扰动(Attack),再让模型去最小化这个“最坏情况”下的 Loss(Defense)。通过这种“以毒攻毒”的方式,强迫模型平滑决策边界,从而显著提升泛化能力。

核心算法:从 FGM 到 PGD

对抗训练在工程实现上主要分为两步:生成扰动和更新参数。根据生成扰动的策略不同,主要有两种主流流派:

- FGM (Fast Gradient Method)

基于 Ian Goodfellow 在 2014 年提出的 FGSM 改进而来。它假设损失函数是线性的,通过单次梯度计算即可得到对抗扰动。

- 特点:计算速度快,只需要一次反向传播即可生成扰动。

- 应用:在 NLP 任务中,通常是对 Embedding 层施加扰动(而非像 CV 那样直接修改像素),FGM 因其高效性常被作为首选的 Baseline 方法。

- PGD (Projected Gradient Descent)

由 Madry 等人在 2017 年提出,被认为是“最强的一阶攻击方法”。本质上是迭代版的 FGM:它进行多步小步长的梯度上升,每一步都将扰动“投影”回允许的扰动范围内(例如 -ball)。

- 特点:生成的对抗样本质量更高、攻击性更强,能迫使模型学习到更鲁棒的特征。

- 应用:在对精度要求极高的场景下,PGD 往往能比 FGM 挤出更多的分数,但代价是计算量成倍增加。

工程实现的差异:在 CV 领域,扰动加在输入像素上;而在 NLP 中,由于离散 Token 无法求导,扰动通常是加在 Word Embedding 层上的连续向量中。

代价与权衡 (Trade-off)

对抗训练虽然被称为“Killer Trick”,但它并非免费的午餐。引入对抗训练会显著改变训练循环的动力学:

- 训练时间暴涨:这是最直接的痛点。使用 FGM 需要多一次反向传播来计算扰动,训练时间通常增加 2x;而使用 K 步迭代的 PGD,训练时间可能增加 (K+1)x 甚至更多。

- 难以收敛:由于模型不断在“最坏样本”上训练,Loss 曲线可能会出现剧烈震荡。

- 容量门槛:对抗训练强迫模型学习更复杂的边界,这通常需要模型具有更大的容量(Capacity)。在小模型上强行使用 PGD 甚至可能导致欠拟合。

尽管如此,在数据量有限或模型极易过拟合的场景下,对抗训练提供的正则化效果往往优于 Dropout 和 L2 权重衰减。对于希望快速验证或集成此技术的开发者,可以直接参考成熟的实现库,如 TorchAttacks,它封装了包括 PGD、FGM 在内的多种攻击策略,能够以标准化的接口嵌入到 PyTorch 的训练循环中。

DropBlock 与 Stochastic Depth:Dropout 的进化版

在处理卷积神经网络(CNN)时,很多工程师会发现一个反直觉的现象:经典的 Dropout 效果往往不如人意,甚至完全不起作用。这并非玄学,而是因为卷积特征具有高度的空间相关性(Spatial Correlation)。

在全连接层中,神经元是相对独立的,随机丢弃某些节点能有效打破共适应(Co-adaptation)。但在卷积层的特征图(Feature Map)上,相邻的激活单元通常共享极其相似的语义信息。如果你只是随机“关掉”几个像素点,网络可以轻易通过周围紧邻的像素“推断”出缺失的信息,导致正则化效果大打折扣。

为了解决这个问题,我们需要更具侵略性的“进化版” Dropout。

1. DropBlock:从“坏点”到“遮挡”

DropBlock 的核心思想非常直观:既然单个像素的丢失无法难倒网络,那就直接丢弃一整块连续的区域。

我们可以用一个简单的比喻来理解二者的区别:

- Standard Dropout 就像是图像传感器上的几个随机坏点(Dead Pixels)。网络看一眼周围的像素,就能轻松脑补出坏点的内容,几乎不需要改变学习策略。

- DropBlock 则像是有人随手在图像上贴了一张便利贴(Post-it Note)。这张便利贴可能直接盖住了“狗头”,迫使网络去学习识别“狗尾巴”、“毛发纹理”或“腿部形状”等其他特征来完成分类。

这种方法强迫网络不再依赖单一的显著特征(Discriminative Features),而是去寻找更多样化的证据,从而显著提升了模型的泛化能力。相关的技术讨论也指出,DropBlock 在空间数据上的正则化效果远强于随机 Dropout,因为它真正引入了信息缺失的挑战。

2. Stochastic Depth:在深度维度做减法

如果说 DropBlock 是在“宽度”和“空间”上做文章,那么 Stochastic Depth(随机深度) 就是在“深度”上做减法,专门针对 ResNet 等深层残差网络。

在训练极深的网络(如 ResNet-101 或 ResNet-152)时,Stochastic Depth 会以一定概率随机跳过(Bypass) 整个残差块(Residual Block)。这意味着:

- 训练时:每一次迭代,网络实际上都在训练一个随机的“浅层子网络”。由于路径更短,梯度消失的问题得到缓解,训练速度也会加快。

- 测试时:使用完整的深层网络。这等效于将无数个不同深度的浅层网络进行了隐式集成(Implicit Ensemble)。

工程建议:

在现代视觉任务(尤其是 Kaggle 竞赛或高精度工业场景)中,如果你使用的是 ResNet、ResNeXt 或 EfficientNet 变体,建议优先考虑 DropBlock 或 Stochastic Depth,而不是在卷积层后强行插入传统的 Dropout 层。前者保留了 Dropout “模型集成”的精髓,同时规避了卷积特征冗余带来的失效问题。

面试官视角:如何回答“防止过拟合”才算高分?

当面试官抛出“如何防止过拟合”这个经典问题时,他们期待的往往不是教科书式的名词罗列(如“Dropout、L2 正则、数据增强”),而是你能否展示出系统化的工程思维和针对具体场景的权衡能力。

仅仅背诵八股文只能拿到及格分;要拿到高分,你需要将回答结构化,并主动点出“在现代深度学习中,传统方法的局限性”。以下是一个建议的回答框架和策略。

1. 拒绝“报菜名”,建立分层防御体系

高分的回答应当像构建防御工事一样,从数据源头到模型输出进行分层阐述。建议按以下逻辑组织语言:

- 数据层面(根源治理): 强调数据是过拟合的根本解。除了常规的旋转、裁剪,应重点提及 Mixup 或 CutMix 等现代增强手段。研究表明,基于混合(Mix-based)的数据增强方法在多数情况下比传统增强更能提升模型的泛化边界,尤其是在生理时间序列或图像分类任务中。

- 模型层面(结构约束): 提及模型容量(Capacity)的控制。这里可以顺势引入 DropBlock 或 Stochastic Depth,解释为何在 ResNet 或 Transformer 架构中,它们比标准 Dropout 更有效。

- 训练层面(过程干预): 提及 Early Stopping(早停)和对抗训练(Adversarial Training)。

- 标签层面(目标平滑): 提及 Label Smoothing(标签平滑),防止模型对错误标签过度自信。

2. 展示“Senior”视角的权衡(It Depends)

资深工程师与初学者的区别在于对上下文的敏感度。在列举方法后,必须补上“具体使用取决于场景”的论述:

- Batch Norm 与 Dropout 的冲突: 不要只提 L2 正则化。可以指出在使用了 Batch Normalization (BN) 的现代网络中,传统的 Dropout 可能会导致方差偏移,效果往往不如预期。此时应优先考虑权重衰减(Weight Decay)或专门针对卷积层的正则化手段。

- 验证策略的陷阱: 防止过拟合不仅在于“训练中做了什么”,更在于“如何评估”。引用 Kaggle 竞赛中的经验,始终信任你的交叉验证(CV)分数往往比盯着公共榜单(Leaderboard)更重要。许多初学者过度优化 LB 分数,最终在私有集上崩盘,这本身就是一种典型的“对测试集过拟合”。

3. 避坑指南:不要为了理论而理论

面试中一个常见的扣分点是生搬硬套数学解释而忽略工程现实。例如:

- 慎谈 L1 正则化的稀疏性: 虽然理论上 L1 能产生稀疏权重,但在现代深度学习框架(如 PyTorch/TensorFlow)的 SGD 优化中,真正的稀疏化很难通过简单的 L1 实现,除非配合专门的剪枝(Pruning)算法。

- 数据量与噪声的辩证: 如果数据量极小且噪声大,简单的过采样(Oversampling)可能加剧过拟合;此时提及迁移学习(Transfer Learning)或冻结部分层(Freezing Layers)是更切题的解法。

总结话术示例:

“防止过拟合没有银弹。如果是小样本图像任务,我会优先用迁移学习和 CutMix;如果是结构化数据,我会更关注特征筛选和 CV 策略的一致性。核心原则是:在偏差(Bias)和方差(Variance)之间找到当前数据规模下的最优平衡点。”