在人工智能基础设施被英伟达 GPU 和 CUDA 生态牢牢掌控的当下,提出“后 CUDA 时代”这一概念并非预言硬件巨头的陨落,而是揭示了计算产业正在经历的一场从“硬件定义软件”向“软件定义算力”的深刻范式转移。随着大模型参数量的指数级增长与异构硬件市场的“寒武纪大爆发”,传统的单体开发模式已难以应对日益复杂的计算需求:一方面,AMD、Intel 以及各类针对特定领域架构(DSA)的 NPU 正在打破硬件垄断,迫切需要一种能够跨越厂商壁垒的通用编程方案;另一方面,现代 AI 模型的迭代速度以天为单位,算法工程师难以容忍为了验证一个新算子而等待数周的手工 CUDA 优化。这种算力需求与开发效率之间的巨大裂痕,催生了以 Triton 和 Mojo 为代表的新一代编程工具链。这不仅仅是编程语言的更替,更是底层编译器架构的革命。通过引入 MLIR(多级中间表示)等先进技术,这些新兴工具试图在 Python 的易用性与 C++ 的高性能之间构建一座桥梁。Triton 以其务实的“块级编程”模型,成功将高性能算子开发的门槛大幅降低,成为 PyTorch 2.0 时代的标配;而 Mojo 则野心勃勃地试图通过统一系统级编程与脚本语言,彻底解决生产环境中的性能断层问题。这一变革的核心价值在于,它标志着 AI 开发正在摆脱对底层硬件原语的直接依赖,转而进入一个由智能编译器主导性能优化的新阶段。对于开发者而言,理解这一趋势至关重要,因为未来的竞争优势将不再仅取决于谁拥有最强的 GPU,而在于谁能利用更先进的软件栈,以更低的成本和更高的效率,在异构计算的丛林中释放出硬件的极致潜能。

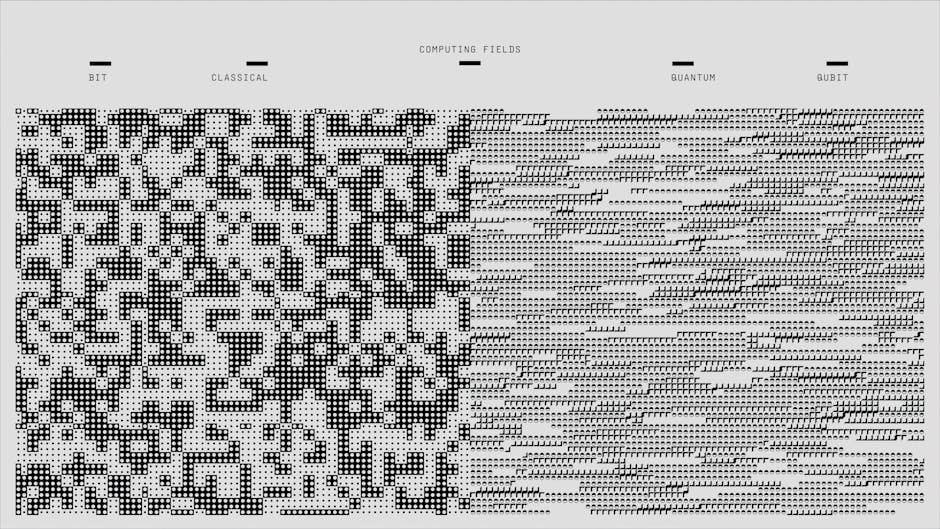

什么是“后 CUDA 时代”?

当我们谈论“后 CUDA 时代”时,这并非意味着 NVIDIA 的 GPU 或 CUDA 平台将在短期内消亡。相反,这是一个关于开发范式转移的定义:AI 基础设施的重心正从“以特定硬件(NVIDIA)为中心”向“以软件抽象(编译器与语言)为中心”迁移。在这个新时代,开发者不再被强制要求通过繁琐的底层 CUDA C++ 代码来榨取硬件性能,而是通过更高级、更通用的软件栈来实现跨硬件的高效计算。

这一趋势的形成,主要由两大核心动力推动:

1. 硬件碎片化与单一厂商锁定的矛盾

长久以来,CUDA 构筑了极深的护城河,但随着 AI 推理与训练需求的爆发,硬件市场迎来了“寒武纪大爆发”。除了 NVIDIA,AMD 的 ROCm 生态正在快速成熟,Intel 以及各类针对特定领域架构(DSA)的 NPU(如 Huawei Ascend 等)层出不穷。

在这种环境下,企业和开发者无法继续容忍代码与单一硬件深度绑定。如果每一款新芯片都需要重新编写底层的算子库,研发成本将变得不可接受。因此,“后 CUDA”的核心诉求是可移植性——即“一次编写,到处运行”,且不牺牲太多性能。

2. 模型迭代速度与开发门槛的脱节

传统的 CUDA 编程门槛极高,开发者需要手动管理内存层级、处理线程束(Warp)同步以及应对复杂的 C++ 模板元编程。然而,现代 AI 模型的迭代速度是以周甚至天为单位的。算法工程师需要快速验证新的算子结构(如 FlashAttention 的变体),而等待高性能计算(HPC)专家花费数周手写优化 CUDA Kernel 已成为严重的瓶颈。

正如行业观察者所言,真正的转变是从手动 CUDA 编程转向由智能编译器生成 CUDA 级代码。市场迫切需要一种既能像 Python 一样易于表达,又能像 C++ 一样高效的工具链。

在这一背景下,两个具有代表性的破局者应运而生:

- Triton:作为一种中层抽象(Intermediate Representation),它专注于算子开发。OpenAI 将其设计为一种基于“块(Block)”而非“线程(Thread)”的 DSL,极大地简化了 GPU 内核的编写难度,并已成为 PyTorch 2.0 的标配。

- Mojo:作为一种高层统一语言,它试图解决 Python 在生产环境部署中的性能断层问题。Mojo 旨在通过 MLIR(多级中间表示)框架,提供一种能够向下兼容硬件细节、向上兼容 Python 生态的系统级解决方案。

这两者的出现,标志着 AI 开发正在逐步摆脱对底层 CUDA 原语的直接依赖,进入一个由编译器主导性能优化的新阶段。

Triton:打破算子开发垄断的务实派

在“后 CUDA 时代”的探索中,Triton 并非试图完全取代 CUDA 的生态位,而是选择了一条更为务实的路径:通过提升抽象层级,将算子(Operator)开发的门槛从“硬件专家”降低到“算法工程师”可触及的范围。

Triton 的核心哲学在于颠覆了传统的 GPU 编程模型。传统的 CUDA 开发基于 SIMT(单指令多线程) 模型,开发者必须以“线程(Thread)”为单位进行思考,手动管理线程束(Warp)内的同步、共享内存(Shared Memory)的分配以及显存访问的合并(Coalescing)。这种细粒度的控制虽然能榨干硬件性能,但也带来了极高的认知负荷——稍有不慎,非合并的内存访问就会导致性能断崖式下跌。

相比之下,Triton 引入了 基于“块(Block)”的编程模型。开发者不再纠结于单个线程的行为,而是直接操作数据块(Tile)。Triton 编译器(基于 MLIR 构建)会自动处理复杂的内存合并访问和共享内存管理,将高层级的块操作“降级”为高效的机器码。正如 OpenAI 所述,这种设计旨在让没有 CUDA 经验的研究人员也能编写出极其高效的 GPU 代码。

这一路径的有效性已在工业界得到验证。PyTorch 2.0 默认集成 Triton 作为其编译器后端(TorchInductor),标志着它已从 OpenAI 的内部研究工具转变为深度学习生态的基础设施。通过 JIT(即时编译)技术,Triton 能够在 Python 运行时动态生成内核,这不仅保留了 Python 的灵活性,还规避了传统 C++ 扩展开发的繁琐流程。

值得注意的是,Triton 并非通用的系统编程语言,而是一种专注于张量计算的 DSL(领域特定语言)。它并不试图解决所有系统级问题,而是专注于生成高性能的 GPU 内核(Kernel)。这种专注也使其在跨硬件兼容性上展现出潜力。虽然 CUDA 仅限于 NVIDIA 硬件,但 Triton 的后端设计允许其支持多种硬件架构。目前,Triton 已经能够 在 AMD ROCm 平台上运行,为开发者提供了一种在不重写内核代码的前提下迁移至非 NVIDIA 硬件的可行路径,这正是打破单一厂商硬件锁定的关键一步。

Triton 的核心优势与适用场景

对于大多数 AI 工程师而言,直接使用 CUDA C++ 编写内核(Kernel)往往意味着极高的开发成本与陡峭的学习曲线。Triton 的出现并非为了在每一个微基准测试中击败手写 CUDA,而是为了在开发效率(Productivity)与运行效率(Performance)之间找到一个更优的平衡点。

以下是 Triton 在实际工程中的核心优势与最佳适用场景分析。

1. 核心优势:从“线程微操”到“块级抽象”

Triton 最具革命性的差异在于其编程模型。CUDA 要求开发者从单个线程(Thread)的视角思考,手动处理线程束(Warp)同步、共享内存(Shared Memory)的 Bank Conflict 以及全局内存的合并访问(Coalescing)。

相比之下,Triton 采用了基于块(Block-based)的编程模型。开发者操作的是数据块(例如 tl.load 加载一个 的矩阵块),编译器会自动处理底层的指令并行化与内存优化。

- 自动化内存优化:Triton 编译器能自动分析数据访问模式,优化内存合并访问,大幅减少了手动调整内存布局的工作量。正如相关研究指出的,它简化了线程同步与向量化的复杂性。

- Python 原生集成:通过

@triton.jit装饰器,内核代码直接嵌入在 Python 项目中,支持即时编译(JIT),无需配置复杂的nvcc构建链。

2. 最佳适用场景

根据工程实践与性能评测,Triton 在以下场景中能发挥最大价值:

- 自定义融合算子(Fused Operators)

这是 Triton 的“杀手级”应用。在深度学习模型中,大量的执行时间消耗在显存读写(HBM 到 SRAM)上,而非计算本身。通过将多个操作(如 LayerNorm + ReLU + Dropout)融合为一个 Triton Kernel,可以将中间结果保留在片上缓存(SRAM)中,显著降低带宽压力。PyTorch 2.0 的TorchInductor后端默认使用 Triton 生成融合算子正是基于此逻辑。 - IO 密集型(IO-Bound)内核优化

对于 Softmax、LayerNorm 或简单的逐元素(Element-wise)操作,Triton 能够轻松达到硬件带宽的峰值利用率。基准测试显示,在 Fused Softmax 等场景下,Triton 甚至能击败未经过极致优化的手动 CUDA 代码。 - 大模型(LLM)中的注意力机制变体

FlashAttention 的流行证明了手写内核的重要性,但手动维护 CUDA 版本的 FlashAttention 极其痛苦。Triton 使得研究人员能够快速实现并测试各种 Attention 变体(如 PagedAttention、Sliding Window Attention),且性能通常能达到专家级 CUDA 实现的 80%–95%。

3. 复杂度与开发成本对比:Triton vs. CUDA

为了直观展示两者的差异,我们可以从代码量与维护难度两个维度进行对比:

维度 | CUDA C++ | OpenAI Triton |

|---|---|---|

编程范式 | SIMT (单指令多线程)<br>需显式管理 | SPMD (单程序多数据) / Block-wise<br>操作逻辑类似 NumPy,编译器负责切块与调度。 |

代码量 (Vector Add) | ~50-100 行<br>包含 Host/Device 内存分配、Kernel 启动配置、错误检查。 | ~10-15 行<br>仅需定义计算逻辑,Python 负责数据搬运。 |

性能上限 | 100% (理论峰值)<br>可控制每一个寄存器和指令周期,适合通用矩阵乘法(GEMM)等基础库开发。 | ~80-95%<br>在极度复杂的计算密集型算子(如卷积)上略逊一筹,但在融合算子上往往更优。 |

可移植性 | NVIDIA 绑定<br>迁移到 AMD/Intel 需重写为 HIP/SYCL。 | 逐步跨平台<br>已有针对 AMD ROCm 的官方支持,且无需修改内核代码即可运行。 |

总结建议:如果你需要极致压榨硬件性能来构建通用的矩阵乘法库(如 cuBLAS 替代品),CUDA 仍然是不可撼动的王者;但如果你是算法工程师,旨在解决模型中的特定瓶颈(如自定义 Attention 或特殊的激活函数),Triton 提供了“用 1/5 的代码换取 90% 性能”的高性价比选择。

Mojo:试图统一 AI 系统栈的野心家

在“后 CUDA 时代”的讨论中,Mojo 经常被误解为仅仅是另一种编写 GPU Kernel 的工具。然而,Mojo 的定位远比“CUDA 的替代品”宏大得多。它的核心愿景并非单纯为了在矩阵乘法上跑赢英伟达,而是为了解决 AI 开发中长期存在的“双语言问题”——即研究人员使用 Python 进行原型设计,而系统工程师必须用 C++ 或 CUDA 重写代码以实现生产级部署。

Mojo 试图通过成为 Python 的超集(Superset) 来打破这一壁垒。正如 Modular 官方文档 所述,Mojo 旨在通过渐进式的方式,让开发者在保留 Python 动态特性的同时,获得相当于 C++ 的系统级性能。这种统一不仅能减少代码迁移的成本,还能让上层算法工程师直接触及底层硬件的性能极限。

支撑这一野心的技术基石是 MLIR(多级中间表示)。不同于传统的编译器架构,MLIR 允许 Mojo 在同一套基础设施中处理从高层图优化到底层硬件指令生成的全部流程。这使得 Mojo 能够“向下”连接各种异构硬件(CPU、GPU、TPU 等),同时“向上”兼容 PyTorch 等主流框架。

在生态位上,Mojo 与 Triton 存在根本性的不同。Triton 是一种专注于张量计算的领域特定语言(DSL),极其擅长编写高效的计算内核(Kernel);而 Mojo 则旨在处理 端到端的 AI 流水线。这包括数据预处理、模型加载、复杂的控制流逻辑以及后处理步骤,而不仅仅是矩阵运算。

此外,Mojo 并非孤军奋战,它是 Modular 公司商业化版图的一部分。配合其推理引擎 MAX(Modular Acceleration X),Mojo 能够作为宿主语言,调度高性能的计算图和算子,从而在商业部署中提供超越传统 Python 运行时的效率。接下来的部分,我们将深入探讨 Mojo 是如何通过技术手段兑现这些性能承诺的。

Mojo 的“渐进式类型”与性能红利

Mojo 最核心的技术突破在于其“渐进式类型”系统(Progressive Typing),这使得开发者可以在同一个源文件中混合使用动态的 Python 代码和静态的系统级代码。这种设计不仅仅是为了兼容性,更是为了提供一条从原型到高性能生产环境的平滑迁移路径。要理解 Mojo 如何在保持易用性的同时实现超越 C++ 的性能,我们需要深入其关键字设计和编译器架构。

fn 与 def:两种世界,一种语法

Mojo 引入了 fn 关键字来定义严格类型的函数,这与标准的 Python def 形成了鲜明对比,也划定了动态与静态的边界:

-

def(动态模式):完全兼容 Python 的行为。它使用动态分发,变量可以随时改变类型,并且受限于全局解释器锁(GIL)。这适合编写胶水代码或处理非计算密集型的逻辑。 -

fn(静态模式):这是 Mojo 性能的来源。fn定义的函数默认是不可变的(immutable),要求显式类型声明,并且在编译时通过 MLIR(多级中间表示)直接降低(Lowering)为机器码。

在 fn 上下文中,编译器可以进行激进的优化,因为它确切知道数据的内存布局和类型。这意味着在 fn 内部,不存在 Python 解释器的开销,也没有 GIL 的干扰,代码可以真正并行运行。

结构体(Struct)与所有权模型:消除开销

Python 的性能瓶颈很大程度上源于其对象模型——几乎所有东西都是堆上分配的 PyObject,且通过引用计数管理内存。Mojo 通过引入 struct 和类似 Rust 的所有权(Ownership)模型解决了这个问题。

- 值语义与

struct:Mojo 的struct是静态内存布局的,通常直接在栈上分配或内联在寄存器中。这消除了指针跳转(Pointer Chasing)的开销,使得数据在内存中紧凑排列,极大地提高了缓存命中率。 - 零拷贝(Zero-copy)机制:通过

borrowed(借用)、inout(可变引用)和owned(所有权转移)等参数修饰符,Mojo 允许开发者精确控制数据如何在函数间传递。这使得大张量或复杂数据结构可以在不发生内存复制的情况下穿梭于各个函数之间,彻底避免了 Python 中常见的“复制以修改”的性能陷阱。

编译器优化:超越“35000 倍”的营销数字

虽然 Modular 官方曾展示过 Mojo 比 Python 快 35,000 倍的基准测试,但对于系统工程师而言,更重要的是理解这种加速是如何通过编译器实现的,而非关注单一的营销数字。Mojo 的性能红利主要来自以下底层的编译器优化能力:

- 自动向量化(SIMD):

由于fn提供了严格的类型信息,Mojo 的编译器(基于 LLVM 和 MLIR)可以自动将标量循环转换为 SIMD(单指令多数据)指令。开发者也可以使用 Mojo 标准库中的 SIMD 类型手动微调,从而充分利用现代 CPU 的 AVX-512 或 AMX 指令集。 - 瓦片化(Tiling)与算子融合:

在 AI 工作负载中,内存带宽通常是瓶颈。Mojo 利用 MLIR) 的多级抽象能力,能够自动进行循环瓦片化(Loop Tiling),将大矩阵计算分解为适应 CPU/GPU L1/L2 缓存的小块。此外,它支持算子融合(Operator Fusion),将多个计算步骤合并为一个内核执行,减少了数据在内存和寄存器之间搬运的次数。 - 编译时元编程:

Mojo 允许在编译阶段执行部分代码(使用alias和comptime)。这意味着像数组大小检查、特定常量的计算等可以在编译时完成,运行时生成的机器码仅包含核心计算逻辑,从而实现零开销抽象。

通过这种“渐进式”的方法,Mojo 实际上是将手动优化 CUDA 或 C++ 代码的复杂度,封装进了一个类似 Python 的语法子集中,让开发者能够以更低的认知负担编写出系统级的高性能代码。

深度对比:Mojo vs. Triton,是竞争还是互补?

在“后 CUDA 时代”的讨论中,开发者最常产生的困惑莫过于:“我应该投入时间学习 Mojo,还是专注于 Triton?” 这种二元对立的视角往往源于对两者生态位(Niche)的误解。实际上,Mojo 和 Triton 虽然都在挑战 NVIDIA 的软件护城河,但它们的抽象层级、设计目标以及在 AI 栈中的位置截然不同。

核心差异:全栈语言 vs. 领域专用语言 (DSL)

要理解两者的关系,首先需要从技术属性上进行解耦。Triton 是一种嵌入在 Python 中的 DSL(领域专用语言),其设计初衷是为了让非 CUDA 专家也能编写高效的 GPU 内核,特别是针对矩阵乘法和 Attention 机制等块状(Block-based)计算。而 Mojo 是一门通用的系统级编程语言,旨在解决 Python 在部署和系统编程中的性能缺陷。

下表总结了两者的关键差异:

特性 | Triton | Mojo |

|---|---|---|

抽象层级 | DSL (嵌入式):高度抽象的 GPU 编程模型,强制使用“块(Block)”语义。 | 通用语言:Python 的超集,支持从高层对象到底层 SIMD/寄存器的全粒度控制。 |

目标用户 | 算法/模型工程师:需要自定义算子(如 FlashAttention),但不愿触碰 C++/CUDA 的复杂性。 | 系统/全栈工程师:构建推理引擎、编译器基础设施,或需要编写包含复杂控制流的内核。 |

编译模式 | JIT (即时编译):运行时将 Python AST 编译为 PTX/汇编,依赖宿主 Python 环境。 | AOT + JIT:支持提前编译为独立二进制文件,拥有完整的调试器和工具链,不依赖 Python 运行时。 |

适用场景 | 密集计算算子(Dense Math),如 MatMul、Convolution、Attention。 | 端到端 AI 流水线:数据加载、预处理、模型图执行、以及自定义内核。 |

生态位分析:谁在解决什么问题?

Triton 的“甜点区”在于算子开发效率。

对于大多数 AI 研究人员而言,Triton 提供了极高的性价比。正如相关基准测试所示,Triton 实现的 FlashAttention 虽然在峰值性能上可能比手写的 CUDA 内核慢 10% 到 40%,但其代码量仅为 CUDA 的几分之一,且更易于维护和迭代。Triton 通过编译器自动处理了内存合并访问(Coalescing)和共享内存管理等复杂问题,让开发者专注于算法逻辑。

Mojo 的野心在于统一系统栈。

Mojo 不仅仅是为了写内核,它是为了修补 Python 生态的分裂。在目前的架构中,我们用 Python 写模型,用 C++ 写底层运行时,用 CUDA/Triton 写内核。Mojo 试图用一种语言覆盖这三个层级。根据 Modular 官方文档,Mojo 是一个通用语言,不仅支持 AI 加速器,还支持 CPU、数据转换和预处理等通用编程任务。这意味着你可以用 Mojo 编写高性能的 HTTP 服务器来接收请求,进行数据预处理,然后调用模型推理,整个过程无需在 Python 和 C++ 之间进行昂贵的上下文切换(Context Switch)。

互补而非替代:Mojo 作为 Triton 的宿主

一个常见的误区是认为 Mojo 会“杀”死 Triton。事实上,两者在未来很可能是共生关系。

- Mojo 可以作为 Triton 的宿主语言: 目前 Triton 严重依赖 Python 运行时。随着 Mojo 对 Python 生态的兼容,未来我们可以直接在 Mojo 代码中调用 Triton 内核。这将消除 Python 解释器的开销(GIL),同时保留 Triton 在特定算子生成上的优势。

- MLIR 的共同语言: Mojo 和 Triton 的底层都基于 MLIR(多级中间表示)。Triton 将 Python 代码降级(Lowering)为 MLIR 的

triton方言,而 Mojo 自身也是构建在 MLIR 之上的。理论上,Mojo 的编译器可以直接通过 MLIR 管道生成类似 Triton 性能的 GPU 代码,或者直接集成 Triton 的编译 Pass。 - 复杂控制流的处理: Triton 在处理极其复杂的动态控制流(如某些稀疏计算或树搜索算法)时可能会受限于其 DSL 的表达能力。这时,Mojo 提供的底层控制能力(指针运算、手动内存管理、直接寄存器访问)可以作为 Triton 的补充,用于处理那些 DSL 难以表达的“边角案例”。

结论: 它们都在试图消灭 CUDA 的复杂性,但在不同维度上发力。如果你现在的痛点是“我要快速写一个变种的 Attention 算子”,Triton 是首选;如果你在构建下一代推理引擎,或者苦恼于 Python 在生产环境的性能瓶颈,Mojo 才是那个改变游戏规则的工具。

共同的基石:MLIR 与编译器基础设施的胜利

在探讨 Mojo 语言的宏大愿景与 Triton 编译器的即刻战力时,我们必须透过表象,审视支撑这两者的共同技术脊梁:MLIR(Multi-Level Intermediate Representation)。如果说 CUDA 时代是“手工打磨汇编”的胜利,那么后 CUDA 时代实际上是编译器基础设施的胜利。

为什么 LLVM 还不够?

在过去十几年中,LLVM 几乎统治了编译器后端,但面对异构计算(Heterogeneous Computing)的爆发,传统的 LLVM IR 显露出了局限性。LLVM IR 是一种低级抽象,它过早地丢弃了高层语义信息——例如,当一个矩阵乘法操作被降级(Lowering)为 LLVM IR 时,它变成了一堆标量指令和内存地址计算。在这个层级上,编译器很难再进行复杂的循环平铺(Tiling)、算子融合(Fusion)或张量布局优化,因为原始的循环结构和数据依赖关系已经变得模糊不清。

MLIR 的出现正是为了解决这一断层)。它引入了“多级”中间表示的概念,允许编译器在不同的抽象层级上保留关键语义。通过Dialect(方言)机制,MLIR 允许开发者定义特定领域的中间表示(如 Linalg 用于线性代数,Vector 用于向量化,GPU 用于异构加速)。这意味着优化不再局限于生成的机器码质量,而是上溯到了算法结构层面。

Triton 与 Mojo 的“降级”艺术

Triton 和 Mojo 虽然定位不同,但它们在底层都依赖于 MLIR 的渐进式降级(Progressive Lowering)策略来实现跨硬件的高性能与可移植性。

- Triton 的路径:Triton 并非直接生成 PTX,而是首先将 Python 装饰的内核解析为 Triton-IR(基于 MLIR 的方言)。在这个层级,编译器可以轻松进行块级(Block-level)的数据流分析、自动内存合并(Coalescing)和共享内存冲突消除。随后,这些经过优化的 IR 会被逐步降级为 LLVM IR,最终生成 NVIDIA 的 PTX 或 AMD 的 GCN 指令。

- Mojo 的路径:Mojo 利用 MLIR 实现了系统级编程语言的设计。它能够在同一个源文件中混合高层的 Python 语法和底层的系统操作。Mojo 编译器通过一系列 MLIR Pass,将高层结构逐步拆解,既能利用

Linalg方言进行自动向量化和并行化,也能在必要时直接操作底层的指针和寄存器。

这种架构使得“一次编写,到处运行”不再是空洞的口号。只要硬件厂商提供了对应的 MLIR Dialect 后端(例如 Intel 的 SPIR-V 或特定的 NPU 后端),Triton 和 Mojo 的上层代码理论上就可以低成本地迁移,而无需像 CUDA 那样重写整个内核。

开发者的范式转移

对于身处一线的开发者而言,理解这一点至关重要:未来的性能竞争,不再是比拼谁能写出更精妙的内联汇编(Inline Assembly),而是谁能更有效地利用编译器基础设施。

在后 CUDA 时代,工具链的价值在于自动化生成“忍者级”(Ninja-written)代码。正如研究指出的那样,基于 MLIR 的编译器能够在不依赖用户手动指定调度策略或内联汇编的情况下,达到手写库 90% 以上的性能。开发者应当将注意力从底层的指令排布,转移到如何构建更适合编译器优化的数据流描述上。无论是选择 Triton 还是 Mojo,本质上都是选择站在 MLIR 这个巨人的肩膀上,利用模块化、可扩展的编译器栈来对抗硬件架构的碎片化。

结论:开发者如何选择技术栈?

“后 CUDA 时代”并不意味着 NVIDIA 硬件霸权的终结,而是标志着软件开发范式的转移。NVIDIA 的 GPU 在短期内依然不可替代,但 CUDA 作为唯一编程入口的护城河正在被编译器技术(如 MLIR)和高层抽象语言(如 Triton、Mojo)共同瓦解。

对于身处不同技术层级的开发者而言,盲目追逐新工具是危险的。选择技术栈应基于项目对性能极限、开发效率以及可移植性的具体需求。以下是针对不同角色的工程化建议:

1. 算法工程师与算子优化者:立即掌握 Triton

如果你是 PyTorch 的深度用户,日常工作涉及大模型推理加速、FlashAttention 变体实现或自定义算子开发,Triton 是目前性价比最高的选择。

- 适用场景:需要绕过 PyTorch 笨重的调度开销,实现算子融合(Operator Fusion),或者在不接触底层 PTX 汇编的情况下优化显存访问模式。

- 收益分析:根据业界实践,Triton 通常能以 CUDA 1/10 的代码量,获得专家级 CUDA 内核 80% 到 95% 的性能。虽然在极致优化场景下(如基础原语库开发),手写 CUDA 仍可能有 10% 到 40% 的性能优势,但对于快速迭代的研究型项目,Triton 的开发效率远比这部分边际性能重要。

- 行动建议:不要等待,现在就开始将关键瓶颈算子用 Triton 重写。

2. AI 基础设施架构师与语言极客:持续关注 Mojo

如果你关注的是 AI 系统的整体架构、模型部署流水线,或者对解决 Python 的 GIL 锁和性能瓶颈感兴趣,Mojo 是值得投入时间的长期潜力股。

- 适用场景:构建统一的推理引擎、预处理流水线,或试图在一个语言内解决“Python 原型 + C++ 部署”的割裂问题。

- 现状评估:Mojo 展示了令人兴奋的系统级编程能力,但目前 尚处于早期阶段,生态系统(尤其是深度学习框架支持)不如 Python 成熟。它更像是一个面向未来的赌注,旨在通过 MLIR 彻底重构 AI 软件栈。

- 行动建议:保持关注,尝试用 Mojo 编写一些非关键路径的高性能模块(如数据加载器),但在其生态完全成熟前,避免在生产环境核心链路中全面替换 Python/C++。

3. 极致性能追求者:坚守 CUDA(但拥抱生成工具)

如果你致力于开发底层的线性代数库(如 cuBLAS 级别),或者你的 SLA 要求必须榨干硬件的每一个时钟周期,CUDA 依然是唯一的真理。然而,即使是这类开发者,也应开始关注编译器辅助工具。未来的竞争可能不再是纯手写汇编,而是如何利用编译器基础设施(如 TVM 或 MLIR)来自动化生成高性能代码。

总结决策矩阵

开发者画像 | 核心痛点 | 推荐技术栈 | 理由 |

|---|---|---|---|

PyTorch 算法研发 | 现有算子太慢,显存占用过高 | Triton | Python 语法亲和,开发效率高,足以覆盖绝大多数优化需求。 |

系统架构师 | Python 部署困难,C++ 开发成本高 | Mojo (观望/尝试) | 解决“双语言问题”,统一训练与推理栈,但需等待生态成熟。 |

HPC/库开发者 | 追求硬件极限性能 (P99 Latency) | CUDA + PTX | 细粒度的硬件控制力(寄存器分配、指令流水线)仍是 DSL 无法完全替代的。 |

最终,技术栈的选择不应是非黑即白的。在未来很长一段时间内,最稳健的架构可能是混合式的:用 Python/Mojo 编写上层逻辑,用 Triton 生成大部分自定义算子,仅在极少数关键路径上保留手写 CUDA 代码。