面对生产环境中突发的慢查询告警,绝大多数后端工程师的第一反应往往是检查 WHERE 条件并匆忙添加索引。然而,这种“条件反射式”的优化手段经常事与愿违——监控面板上的响应时间曲线不仅没有下降,甚至可能因为额外的索引维护开销而进一步恶化。这揭示了一个残酷的技术真相:索引的设计意图并不等同于数据库的实际执行。在 SQL 语句被提交给数据库引擎的那一刻起,它就进入了一个由查询优化器(Query Optimizer)主导的复杂决策流程。现代数据库大多采用基于成本的优化模型(CBO),在优化器的精细“账单”中,全表扫描带来的顺序 I/O 开销有时反而远低于通过辅助索引进行大量随机 I/O 回表的成本。因此,当数据分布不均、字段区分度低或统计信息过期时,数据库会毫不犹豫地抛弃你精心设计的索引,转而选择看似笨重的全表扫描。真正的 SQL 调优绝非简单的“缺啥补啥”,而是一场基于数据特征与执行成本的博弈。要打破“索引失效”的迷局,开发者必须停止对索引行为的主观臆测,转而掌握透视数据库决策过程的核心工具——执行计划。只有深入理解 EXPLAIN 输出中 type 类型的层级差异、精准解读 rows 预估值的 I/O 含义,并能敏锐识别 Using filesort 或覆盖索引等关键信号,工程师才能从根本上定位性能瓶颈,将不可控的“玄学”优化转化为可量化的工程实践,确保每一次架构调整都能带来实打实的性能飞跃。

为什么有了索引查询依然慢?从执行计划找答案

绝大多数后端工程师都经历过这样一个“至暗时刻”:生产环境告警显示某条 SQL 查询超时,你迅速排查代码,发现 WHERE 条件字段没有索引。于是你自信满满地提交了 ALTER TABLE ADD INDEX,认为问题迎刃而解。然而,发布上线后,监控曲线纹丝不动,甚至有时查询变得更慢了。

这种挫败感来源于一个常见的误区:认为只要建立了索引,数据库就一定会使用它。

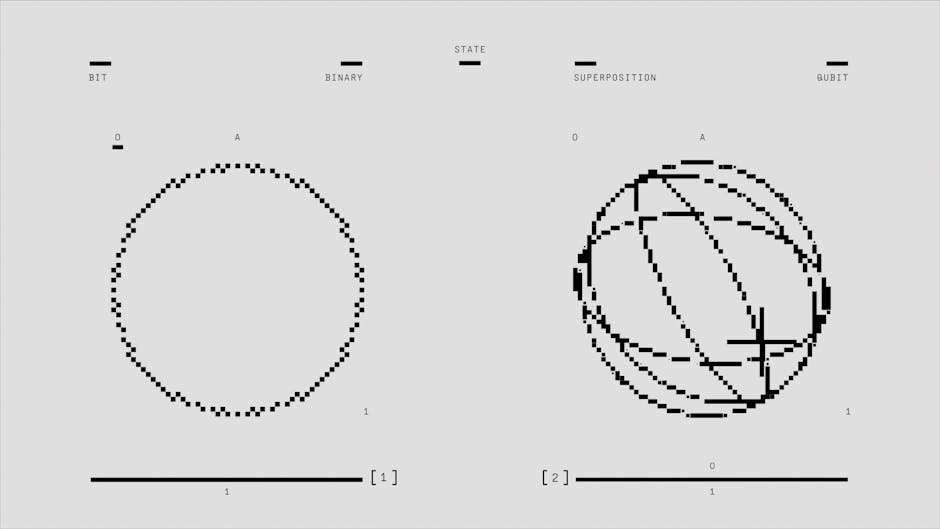

事实上,在 SQL 语句发送给数据库引擎(如 MySQL InnoDB)与真正执行数据检索之间,存在着一个至关重要的决策层——查询优化器(Query Optimizer)。对于现代关系型数据库而言,绝大多数使用的是基于成本的优化器(CBO, Cost-Based Optimizer)。

优化器的“成本”账单

当你执行一条 SQL 时,优化器并不会盲目地看到索引就用。它的核心职责是计算各种执行路径的“成本”(Cost),并选择成本最低的那一条。

所谓的“成本”,通常由 I/O 成本(从磁盘读取数据页的次数)和 CPU 成本(比较记录、排序、临时表操作等)组成。

- 全表扫描(Full Table Scan):虽然听起来笨重,但它是顺序 I/O。如果你的查询需要访问表中 80% 的数据,顺序读取往往比通过索引进行随机 I/O(回表操作)要快得多。

- 索引扫描(Index Scan):虽然定位精准,但如果索引无法覆盖所有查询字段,就需要频繁回表。当数据分布不均匀或统计信息(Statistics)过期时,优化器可能会判定“走索引比全表扫描更贵”,从而弃用你精心设计的索引。

正如 Hacker News 上关于全表扫描的讨论 中提到的,索引有时会带来性能的“悬崖”——当数据量或分布发生微小变化导致执行计划改变时,性能可能会瞬间下降,而全表扫描的性能衰减通常是线性的。

意图 vs. 现实

这就引出了 SQL 优化中最核心的认知差:

- 索引设计(Index Design)是你的“意图”:你希望数据库按照某种路径去查找数据。

- 执行计划(Execution Plan)是“现实”:数据库最终决定如何查找数据。

两者之间的桥梁就是统计信息。如果统计信息显示某列的区分度(Cardinality)极低,或者数据分布严重倾斜,优化器就会无视你的意图。

因此,在着手优化慢 SQL 时,猜测(“我觉得这里应该加个索引”)是极其危险的。唯一的真理来源是数据库告诉你的执行计划。

接下来的章节将以 MySQL 为例(其逻辑同样适用于 PostgreSQL、Oracle 等关系型数据库),深入解读如何通过 EXPLAIN 命令透视优化器的决策过程,找出“索引失效”的真实原因。我们不再关注理论上的“索引是什么”,而是专注于解决工程现场的“为什么没用上”。

读懂 EXPLAIN:关键指标与“红绿灯”信号

在数据库性能优化的战场上,EXPLAIN 命令就是你的战术地图。它不会直接告诉你“如何修改 SQL”,但它会诚实地展示数据库优化器(Optimizer)是如何“思考”并执行你的查询的。

要获取查询的执行计划,只需在 SELECT 语句前加上 EXPLAIN 关键字。对于复杂的查询,你不需要背诵输出结果中的每一列定义,但必须能够一眼识别出决定性能生死的关键指标。

以下是一个典型的 EXPLAIN 输出结构:

EXPLAIN SELECT * FROM orders WHERE user_id = 1024 AND status = 'paid';id | select_type | table | type | possible_keys | key | key_len | ref | rows | Extra |

|---|---|---|---|---|---|---|---|---|---|

1 | SIMPLE | orders | ref | idxuserstatus | idxuserstatus | 5 | const | 12 | Using index condition |

在这一行看似枯燥的数据中,你需要优先关注四个核心指标,它们构成了性能分析的“仪表盘”:

- type:访问类型,决定了查询是“全表扫描”还是“精准打击”。

- key:实际使用的索引。如果这里是

NULL,说明查询正在“裸奔”。 - rows:扫描行数预估。

- Extra:额外信息,往往包含关于索引使用效率的“潜台词”。

警惕 rows:I/O 成本的直接风向标

在查看执行计划时,很多开发者容易忽略 rows,而过分纠结于索引名称。实际上,rows 是衡量 I/O 成本最直观的量化指标。

这一列代表了优化器估算出的、为了找到目标数据而必须读取的行数。请注意,这是一个估算值,并不总是等于结果集的大小。

- 如果

rows数值巨大(例如几万甚至几十万),即使key列显示使用了索引,该查询依然可能导致大量的磁盘 I/O,这通常意味着索引的选择性(Selectivity)很差。 - 根据 Alibaba Cloud 的深入分析,

filtered列(在较新版本的 MySQL 中默认显示)可以辅助rows进行判断:它表示返回结果的行数占读取行数的百分比,数值越高说明索引过滤越精准。

一旦确认了 rows 在合理范围内,下一步就是深入解读 type 和 Extra,这两个字段将告诉你数据库究竟是在高效利用索引,还是在进行低效的“假动作”。

核心字段解读:Type 与 Extra 的潜台词

在 EXPLAIN 的输出结果中,rows 告诉你数据库“预估”要干多少活,而 type 和 Extra 则揭示了它打算“怎么干”。这两个字段往往直接决定了查询是毫秒级响应还是导致数据库卡顿。

1. Type:访问效率的“鄙视链”

type 字段代表了 MySQL 查找数据行的方式(Access Method)。理解这个字段的关键在于记住这个从最优到最差的排序序列:

-

system>const

- 场景:基于主键或唯一索引的等值查询(如

WHERE id = 1)。 - 意义:最多只返回一行数据,速度极快,可以理解为常量级时间复杂度。

- 场景:基于主键或唯一索引的等值查询(如

-

eq_ref

- 场景:多表连接(Join)时,对于前表的每一行,后表通过主键或唯一索引只能找到唯一匹配的一行。

- 意义:这是 Join 查询中最理想的连接类型。

-

ref

- 场景:使用非唯一索引,或唯一索引的最左前缀进行查找。

- 意义:虽然索引不是唯一的,会返回匹配某个值的所有行,但依然是高效的索引查找。

-

range

- 场景:索引范围扫描,常见于

BETWEEN、>、<或IN操作。 - 意义:比全索引扫描好,因为它只扫描索引树的一个特定区间。

- 场景:索引范围扫描,常见于

-

index(Full Index Scan)

- 场景:扫描遍历整个索引树。

- 意义:虽然比全表扫描快(因为索引文件通常比数据文件小且紧凑),但这通常意味着索引没有被高效利用(例如没有命中左前缀),或者查询需要扫描大量索引记录。

-

ALL(Full Table Scan)

- 场景:全表扫描。

- 意义:红色警报。除非表极小(如配置表),否则在万级以上数据量的表中出现

ALL,通常意味着需要立即优化。

2. Extra:不仅是备注,更是关键判决

很多开发者容易混淆 Extra 字段中出现的类似术语。实际上,这里隐含了数据过滤发生的具体位置(Server 层还是存储引擎层),差异巨大:

Extra 值 | 含义与潜台词 | 性能评价 |

|---|---|---|

| 覆盖索引(Covering Index)。<br>查询所需的所有列数据都可以直接从索引树中获取,无需回表(Table Access)。<br>MySQL 文档 指出这是最高效的策略之一。 | ⭐⭐⭐⭐⭐ (极好) |

| 索引下推(ICP, Index Condition Pushdown)。<br>MySQL 5.6+ 的特性。虽然需要回表,但在回表之前,存储引擎会利用索引中已有的列先做一次过滤,只将满足条件的行返回给 Server 层去回表。这减少了不必要的 I/O 操作。 | ⭐⭐⭐⭐ (不错) |

| Server 层过滤。<br>这意味着存储引擎将数据行读出(可能已经回表)并返回给 Server 层,Server 层再根据 | ⭐⭐⭐ (一般/需警惕) |

实战提示:

如果你在 Extra 中同时看到 Using where; Using index,这通常是好消息,说明虽然用到了 WHERE 过滤,但数据依然完全来自索引,没有产生昂贵的回表操作。反之,如果只有 Using where 且 type 为 ALL,则是典型的低效查询。

速查表:执行计划中的“红旗”与“绿灯”

在分析慢查询日志时,EXPLAIN 输出的 type 和 Extra 字段是判断查询效率的核心指标。以下速查表可以帮助你快速识别执行计划中的健康信号与潜在风险,特别适合在排查紧急故障时作为“急救指南”。

信号类型 | 关键词 (Key Terms) | 含义与潜台词 | 性能影响 |

|---|---|---|---|

🟢 绿灯 (高效) |

| 主键或唯一索引查找。数据库确信最多只匹配一行数据,速度极快。 | 极低延迟 |

| 非唯一索引查找。使用普通索引匹配某个值,可能返回多行,但依然高效。 | 低延迟 | |

| 覆盖索引 (Covering Index)。查询所需的所有字段都在索引树中,无需回表(Table Access)。 | 极佳 (纯内存操作概率高) | |

🔴 红旗 (警报) |

| 全表扫描 (Full Table Scan)。数据库必须读取表中每一行来过滤数据。对于大数据量表,这是性能杀手。 | 极高 I/O 开销 |

| 外部排序。索引无法满足排序需求,数据库必须在内存(Sort Buffer)或磁盘中对结果集进行额外的排序操作。 | 高 CPU/内存消耗 | |

| 临时表。为了处理 | 高资源消耗,需极力避免 |

深度解析:为什么 Using filesort 是性能杀手?

在很多开发者的认知中,排序似乎只是“内存里排一下序”这么简单,但在数据库层面,Using filesort 往往意味着索引设计的失败。

正如 MySQL 官方文档关于 ORDER BY 优化 中指出的,当无法利用索引直接按顺序读取数据时,MySQL 必须执行额外的排序阶段。这个过程的代价在于:

- CPU 与内存压力:数据库需要分配

sort_buffer来存储行指针和排序键。如果结果集超过缓冲区大小,排序操作将溢出到磁盘,导致严重的随机 I/O。 - 放弃了预排序优势:B+ 树索引本身是有序的。如果索引设计得当(例如满足最左前缀原则),数据库可以直接按索引顺序读取数据,完全跳过排序步骤。

实战建议:看到 Using filesort 时,不仅要检查 ORDER BY 字段是否有索引,还要确认 WHERE 条件中的字段是否能与排序字段组成联合索引,从而利用索引的有序性消除额外的排序开销。

索引失效与全表扫描:优化器为何“背叛”你?

很多开发者都经历过这样的“背叛”时刻:明明在 status 字段上建了索引,但执行 SELECT * FROM orders WHERE status = 1 时,Explain 结果里的 type 依然显示 ALL(全表扫描)。你可能会怀疑是统计信息没更新,或者 MySQL 出了 Bug。

实际上,数据库优化器(Optimizer)极其理智,它的核心决策指标只有一个:成本(Cost)。优化器并不迷信索引,它只选择代价最小的路径。当它“背叛”你精心设计的索引时,通常是因为它计算出全表扫描比走索引更划算。

选择性(Selectivity)与 I/O 成本

理解这个问题的关键在于随机 I/O 与顺序 I/O 的博弈。

索引查询通常包含两个步骤:

- Index Seek:在索引树中找到对应的主键 ID。

- Table Lookup(回表):根据 ID 去聚簇索引(主数据文件)中读取完整的行数据。

这一过程涉及大量的随机 I/O。如果你的查询条件命中了表中大部分数据(例如超过总行数的 30%),那么通过索引“跳着读”产生的随机 I/O 开销,往往远高于直接顺序扫描(Sequential Scan)整张表的开销。

正如 MySQL 官方文档 所指出的:“当查询需要访问大部分行时,顺序读取比通过索引处理要快。顺序读取能最小化磁盘寻道时间,即使并非所有行都是查询所需的。”

因此,选择性是索引生效的前提。如果一个字段(如 gender 或 status)只有很少的唯一值,且分布极不均匀,那么在数据量较大的那一侧,索引往往会失效。

具体的“背叛”场景:SELECT * 的代价

很多时候,索引失效的罪魁祸首是贪婪的 SELECT *。

假设有一个查询:

SELECT * FROM users WHERE age > 30;如果 age 字段有索引,但你需要查出所有列(*),优化器必须对每一条命中 age > 30 的记录进行回表操作。如果满足条件的行数较多,回表成本将极其高昂,优化器会果断放弃 age 索引,转而进行全表扫描。

对比测试:

如果你将 SQL 改为 SELECT id FROM users WHERE age > 30,你会发现执行计划瞬间变绿(Using index)。这是因为 id 就在索引树上(覆盖索引),无需回表,优化器自然乐于使用索引。

常见的隐式索引失效陷阱

除了基于成本的放弃,还有一种情况是我们的 SQL 写法直接破坏了 B+ 树的查找特性,导致索引无法被使用。以下是三种最常见的“反模式”:

- 字段上使用函数

-- 错误:索引失效,因为必须计算每一行

SELECT FROM users WHERE YEAR(create_time) = 2023;

-- 正确:转换为范围查询

SELECT FROM users WHERE create_time BETWEEN '2023-01-01' AND '2023-12-31';一旦对索引列进行了计算或函数操作,数据库就必须遍历所有行来计算结果,索引的有序性瞬间失去意义。

- 隐式类型转换

如果phone字段是VARCHAR类型,而查询时使用了数字:

-- 错误:字符串被隐式转换为数字进行比较

SELECT FROM users WHERE phone = 13800138000;

-- 正确:保持类型一致

SELECT FROM users WHERE phone = '13800138000';这种隐式转换等同于在字段上加了转换函数,直接导致全表扫描。

- 前导模糊查询

-- 错误:B+树无法从中间开始匹配

SELECT * FROM products WHERE name LIKE '%Pro';LIKE 'Pro%' 可以走范围索引,但 LIKE '%Pro' 意味着从头到尾的每一个字符都可能是匹配项,索引的有序性无法利用,只能全表扫描。

了解这些机制后,当你再次遇到 ALL 时,不要急着强制加 Hint。先检查数据分布(是否取了太多数据),再检查 SQL 写法(是否破坏了索引规则)。正如 Alibaba Cloud 的技术分析 中提到的,甚至像 IS NULL 或 IS NOT NULL 这样的操作,其是否走索引也完全取决于具体的数据分布情况,而非一成不变的规则。

实战调优案例:从发现问题到解决问题

理论知识的终点是生产环境的实战。在本节中,我们将构建一个可复现的“慢查询”场景,模拟一次从发现性能瓶颈、分析执行计划到最终解决问题的完整调优过程。建议你在本地数据库中跟随以下步骤进行实验,或者对比你手中的慢查询日志(Slow Query Log)。

我们将重点关注两个指标的变化:扫描行数(rows)与额外操作(Extra)。

场景复现:典型的“排序致死”案例

假设我们有一个电商订单表 orders,数据量约为 500 万行。业务方反馈查询某位用户的最近订单时,接口响应有时超过 2 秒。

表结构与初始索引:

CREATE TABLE orders (

id INT PRIMARY KEY AUTOINCREMENT,

userid INT NOT NULL,

status TINYINT NOT NULL, -- 1: Pending, 2: Paid, 3: Shipped

amount DECIMAL(10, 2),

createtime DATETIME,

KEY idxuser (userid) -- 初始只建立了 userid 的单列索引

) ENGINE=InnoDB;问题 SQL:

SELECT id, status, amount

FROM orders

WHERE userid = 10086

ORDER BY createtime DESC

LIMIT 20;这是一个非常高频的业务查询模式:先过滤用户,再按时间倒序分页。

第一步:分析“事故现场” (Before)

直接运行 EXPLAIN 查看当前执行计划:

EXPLAIN SELECT id, status, amount FROM orders WHERE userid = 10086 ORDER BY createtime DESC LIMIT 20;输出结果分析:

id | type | key | key_len | rows | Extra |

|---|---|---|---|---|---|

1 | ref | idx_user | 4 | 25000 | Using index condition; Using filesort |

解读红旗信号:

-

type: ref:看起来还不错,使用了idx_user索引。 -

rows: 25000:优化器估算该用户有 2.5 万条订单。MySQL 必须先找出这 2.5 万条记录。 -

Extra: Using filesort:这是性能杀手。虽然我们通过idx_user快速定位了数据,但索引本身并没有按create_time排序。因此,MySQL 必须将这 2.5 万条记录加载到内存(sort buffer)中进行排序。如果数据量超过sortbuffersize,还会导致磁盘临时文件排序,造成严重的 I/O 抖动。

正如 Pythian 的技术博客 中指出的,随着数据集的增长,任何 filesort 操作都可能导致性能无法线性扩展,消除它是优化的首要任务。

第二步:实施优化策略 (Action)

为了消除 filesort,我们需要利用 B+ 树的有序性,建立一个能够同时满足“过滤”和“排序”的联合索引。

修改索引:

-- 建立联合索引 (userid, createtime)

ALTER TABLE orders ADD INDEX idxusertime (userid, createtime);第三步:验证优化效果 (After)

再次运行 EXPLAIN:

EXPLAIN SELECT id, status, amount FROM orders WHERE userid = 10086 ORDER BY createtime DESC LIMIT 20;输出结果对比:

id | type | key | key_len | rows | Extra |

|---|---|---|---|---|---|

1 | ref | idxusertime | 9 | 20 | Backward index scan |

优化成果解读:

-

key: idxusertime:MySQL 选择了新的联合索引。 -

rows: 20:扫描行数从 25,000 骤降至 20。因为索引已经是按userid + createtime排序的,MySQL 只需要直接读取最后 20 条记录即可满足查询,无需扫描该用户的所有历史订单。 -

Extra变更为Backward index scan(MySQL 8.0+):彻底消除了Using filesort。这意味着查询响应时间将从数百毫秒级降低到微秒级。

进阶排查:当优化器“不听话”时

在实战中,你可能会遇到建立索引后,MySQL 依然坚持全表扫描或使用了错误的索引。这通常与区分度(Selectivity)和回表成本(Cost)有关。

例如,如果我们将查询改为查询“所有已支付订单”:

SELECT * FROM orders WHERE status = 2 ORDER BY create_time;即使你在 (status, create_time) 上建立了索引,如果 status=2(已支付)的数据占全表的 80%,优化器很可能会放弃索引。因为它判断:通过二级索引找到主键,再回表读取数据(Random I/O)的成本,比直接顺序扫描全表(Sequential I/O)还要高。

调试技巧:

遇到这种情况,可以使用 FORCE INDEX 作为一个诊断工具(但在生产代码中使用需谨慎)。

SELECT * FROM orders FORCE INDEX(idxstatustime) WHERE status = 2 ORDER BY create_time;通过强制指定索引并对比 EXPLAIN 的 rows 和实际执行时间(Profiling),你可以确认是索引设计问题还是统计信息(Statistics)偏差导致的问题。如 Stack Overflow 讨论 中提到的,虽然 FORCE INDEX 是最后的手段,但在调试阶段,它是验证索引有效性最直接的方法。

总结:

不要只看查询结果,必须看 EXPLAIN。优化的核心目标通常是:

- 将

type从ALL提升到ref或range。 - 消除

Extra中的Using filesort和Using temporary。 - 大幅降低

rows的扫描数量。

案例一:消除 Using filesort(排序优化)

在处理慢查询时,Using filesort 是执行计划中最常见的性能杀手之一。它并不一定意味着磁盘读写(虽然在内存不足时会发生),但它明确表示 MySQL 无法利用索引完成排序,必须在获取数据后进行额外的排序操作。这通常会导致 CPU 使用率飙升和响应时间延长。

场景复现

假设我们有一个电商订单表 orders,业务方需要查询某个特定用户最近的订单。表结构中存在单列索引 idxuserid (user_id)。

-- 原始查询:查找用户 10086 的订单,按创建时间倒序

SELECT id, orderno, amount, createdat

FROM orders

WHERE userid = 10086

ORDER BY createdat DESC

LIMIT 10;当我们执行 EXPLAIN 查看该 SQL 的执行计划时,通常会看到如下结果:

id | select_type | table | type | key | Extra |

|---|---|---|---|---|---|

1 | SIMPLE | orders | ref | idxuserid | Using index condition; Using filesort |

问题分析:

虽然查询使用了 idxuserid 快速定位到了 user_id = 10086 的行,但索引本身是按照 user_id 排序的。在 user_id 相同的情况下,数据在物理存储或索引树中并不保证按照 created_at 有序排列。因此,MySQL 必须将所有符合条件的行提取出来,放入排序缓冲区(Sort Buffer)根据 created_at 进行二次排序。正如 MySQL 官方文档 所述,这构成了一个额外的排序阶段,当数据量较大时,甚至可能触发磁盘临时文件交换。

优化方案:联合索引与最左前缀

要消除 Using filesort,核心思路是让索引的顺序直接满足查询的排序需求。我们需要创建一个联合索引,遵循“等值查询字段在前,排序字段在后”的原则。

-- 创建联合索引 (A, B)

ALTER TABLE orders ADD INDEX idxusercreated (userid, createdat);在这个联合索引 (userid, createdat) 的 B+ 树结构中:

- 数据首先严格按照

user_id排序。 - 当

user_id相等时,数据是严格按照created_at排序的。

根据最左前缀原则(Leftmost Prefix),当我们在 WHERE 子句中将 user_id 指定为常量(Constant)时,扫描到的索引片段本身就已经按照 created_at 有序了。

验证优化效果

再次执行 EXPLAIN:

EXPLAIN SELECT id, orderno, amount, createdat

FROM orders

WHERE userid = 10086

ORDER BY createdat DESC

LIMIT 10;TABLEBLOCK6

(注:部分版本可能显示 Backward index scan,视 MySQL 版本及 DESC 优化而定,但 Using filesort 已消失)

结果解读:Extra 字段中的 Using filesort 消失了。执行器现在可以直接从索引树中按顺序读取前 10 条记录并返回,无需扫描该用户的所有订单后再排序。对于高并发的列表页查询,这种优化通常能带来 10 倍以上的性能提升。

注意:如果 WHERE 子句中 user_id 是范围查询(如 user_id > 1000),即使建立了联合索引,优化器通常也无法利用索引消除排序,因为在跨越多个 user_id 时,created_at 并不是全局有序的。

案例二:利用覆盖索引避免“回表”

在高并发场景下,SQL 优化的核心往往不是“如何更快地找到行”,而是“如何减少 I/O 操作”。其中,“回表”(Table Access by RowID) 是导致查询性能抖动的一个常见隐形杀手。

什么是“回表”?

当数据库通过非聚簇索引(Secondary Index)找到符合条件的记录时,如果索引叶子节点中不包含查询所需的所有列,存储引擎就必须根据索引中存储的主键 ID,再次回到聚簇索引(主表数据)中去查找完整的行数据。

这个过程被称为“回表”。在机械硬盘时代,这通常意味着产生大量的随机 I/O;即便是 SSD,频繁的回表也会显著增加 CPU 消耗和延迟。

现场还原:SELECT * 的代价

假设我们有一张订单表 orders,包含千万级数据,并有一个联合索引 idxuserdate (userid, createdat)。

场景 A:习惯性的全字段查询

很多开发者为了省事,习惯写 SELECT *:

SELECT * FROM orders WHERE user_id = 10086;此时查看执行计划(EXPLAIN):

id | select_type | table | type | key | Extra |

|---|---|---|---|---|---|

1 | SIMPLE | orders | ref | idxuserdate | Using index condition |

虽然 type 是 ref,表示用到了索引,但 Extra 显示为 Using index condition(或者为空),意味着 MySQL 在索引树上筛选出 user_id = 10086 的记录后,必须拿着主键 ID 回到主表去读取 order_status、amount 等其他字段。如果该用户有 50 条订单,就可能触发 50 次随机 I/O。

场景 B:覆盖索引(Covering Index)优化

如果我们只查询业务真正需要的字段,且这些字段恰好都在索引中:

SELECT userid, createdat FROM orders WHERE user_id = 10086;再次查看执行计划:

id | select_type | table | type | key | Extra |

|---|---|---|---|---|---|

1 | SIMPLE | orders | ref | idxuserdate | Using index |

此时 Extra 字段变成了 Using index。这代表 MySQL 仅通过扫描 idxuserdate 的索引树就获取了所有需要的数据,完全跳过了访问主表数据的步骤。

根据 PlanetScale 的 EXPLAIN 解读,Using index 明确表示 MySQL 将使用覆盖索引来避免访问表数据(avoid accessing the table)。这种查询方式将原本的“索引扫描 + 随机 I/O 回表”变成了纯粹的“顺序索引扫描”,性能提升通常是数量级的。

优化策略

在实战中,可以通过以下两种方式利用覆盖索引消除回表:

- 做减法(修改 SQL): 严格审查查询字段,去掉无用的

SELECT *,只取索引中已有的列。 - 做加法(修改索引): 如果业务确实需要查询

order_status,而该查询又是高频核心路径,可以考虑将联合索引扩展为(userid, createdat, order_status)。

虽然增加索引长度会略微影响插入性能,但对于读多写少的场景,用少量的空间换取大量的随机 I/O 减少,通常是极具性价比的优化手段。在使用 EXPLAIN 分析时,请务必关注 Extra 列是否出现了 Using index,这是判断是否发生回表的“金标准”。

案例三:强制索引 (Force Index) 是救命稻草吗?

在极少数情况下,你会遇到一种令人抓狂的场景:明明为查询字段建立了完美的索引,数据分布也看似正常,但 EXPLAIN 的结果显示优化器坚持使用全表扫描(Full Table Scan)或者选了一个完全不相关的索引。

这时候,很多开发者的第一反应是使用 FORCE INDEX 强行纠正优化器的行为。虽然这能立竿见影地解决当下的慢查询问题,但在生产环境中,这往往是一把双刃剑。

优化器为什么会“犯傻”?

数据库优化器(Optimizer)是基于成本(Cost-based)做出决策的。它依赖统计信息(Statistics)来预估扫描行数和 I/O 成本。如果统计信息过期——例如刚刚发生了大量数据的写入或删除,而后台的统计分析尚未触发——优化器眼中的数据分布可能与实际情况大相径庭。

此外,MySQL 的索引策略会评估回表成本。如果查询条件命中的数据量占比较大(通常超过表总行数的 20%-30%),优化器会认为通过辅助索引查找后再回表(Random I/O)的成本高于直接顺序扫描全表(Sequential I/O),从而放弃索引。

强制索引的使用与隐患

FORCE INDEX 确实是干预执行计划的最强硬手段。通过在表名后指定索引名称,你可以命令 MySQL 必须走这条路径。

语法示例:

-- 优化器选择了全表扫描,但你确定只查询了 1% 的数据

SELECT *

FROM orders FORCE INDEX (idxorderdate)

WHERE order_date >= '2023-11-01';虽然这看起来像是一根“救命稻草”,但在资深 DBA 眼中,在业务代码中硬编码 FORCE INDEX 通常被视为一种反模式(Anti-pattern),原因如下:

- 代码脆性(Brittleness): 将索引名称硬编码在 SQL 中,意味着如果后续数据库重构(如重命名索引或合并索引),应用程序代码将直接报错或失效。

- 数据分布变化的风险: 随着时间推移,数据分布可能发生变化。如果某天

order_date >= '...'筛选出的数据量变成了 50%,此时全表扫描确实是更优解。但由于代码中强制了索引,数据库不得不执行效率极低的大量随机 I/O 回表,导致原本的优化手段变成了性能瓶颈。 - 掩盖根本问题: 频繁需要强制索引通常暗示着统计信息维护机制失效,或者是索引设计本身存在缺陷(例如未覆盖所有必要字段)。

正确的排查与处理路径

当你发现优化器选错索引时,建议按照以下优先级进行处理,而不是直接上线 FORCE INDEX:

- 更新统计信息:

这是最常见的原因。尝试在测试环境或低峰期执行ANALYZE TABLE table_name;。这会促使数据库重新采样并更新索引的基数(Cardinality)统计。在很多实际案例中,仅仅这一步就能让优化器“恢复理智”。 - 优化 SQL 写法或索引结构:

检查是否因为使用了SELECT *导致回表成本过高。尝试改写为覆盖索引查询,或者使用STRAIGHT_JOIN调整表连接顺序,引导优化器自然选择正确的路径。 - 最后的手段:

如果更新统计信息无效,且业务逻辑必须立即恢复性能,可以使用FORCE INDEX作为临时修复方案。但务必在代码注释中标记这是一个临时措施(TODO),并安排后续任务去深入分析为何优化器估算失效。

专家建议:不要盲目信任自己的直觉优于优化器。除非你有确凿的证据(如EXPLAIN ANALYZE的实际执行时间对比)表明索引扫描显著优于优化器的选择,否则尽量避免手动干预执行计划。

总结:建立“设计-验证-调优”的闭环思维

回到文章开头的那个问题:“查询慢了 10 倍,你是先看索引还是先看执行计划?”

其实,这是一个典型的陷阱题。在成熟的工程实践中,索引(Index)与执行计划(Execution Plan)从来不是割裂的“二选一”,而是贯穿于 SQL 生命周期中的闭环系统。单纯依赖索引设计而忽略执行计划的验证,或者只在出故障时才去查看执行计划,都是“单腿走路”。

要彻底解决慢查询问题,我们需要建立一套完整的 “设计-验证-调优” 工作流:

1. 设计阶段:业务驱动而非“撒网式”索引

优化始于代码编写之前。不要等到测试阶段才考虑索引,也不要为了“防患于未然”给所有字段加索引。

- 精准打击:根据业务查询的高频

WHERE、JOIN和ORDER BY条件设计索引。 - 权衡代价:记住 Klaviyo 的工程实践 中提到的平衡——每个索引都会拖慢写入速度。由于过度索引导致的写入性能下降,往往比慢查询更难排查。

- 复合索引顺序:严格遵循“最左前缀”原则,将区分度最高的字段放在前面。

2. 验证阶段:开发环境的“红线”检查

很多严重的性能事故,本可以在开发阶段通过简单的 EXPLAIN 避免。不要只在只有 10 行数据的本地库里跑 SQL,必须在开发流程中引入执行计划的审查机制。

关注以下“红线”指标:

- Type 检查:看到

ALL(全表扫描)时必须警惕,除非表数据量极小。理想情况下,核心查询应达到ref或range级别。 - Extra 警告:

Using filesort和Using temporary意味着数据库正在消耗大量 CPU 和内存资源进行额外计算,这是高并发下的性能杀手。 - 行数预估:正如 Rapydo 的基准测试 所展示的,一个缺失的索引可能导致数据库扫描 100 万行而不是 10 行,性能差距可达 3000 倍。

3. 调优阶段:拥抱变化与安全试错

生产环境的数据分布是动态变化的,优化器可能会因为统计信息过时而选错索引。

- 持续监控:使用慢查询日志(Slow Query Log)定位那些“原本很快,突然变慢”的 SQL。

- 安全验证:MySQL 8.0+ 引入了 Invisible Indexes(不可见索引),这改变了传统的运维风险模型。你可以先将某个索引标记为“不可见”,观察执行计划和性能变化,确认无误后再物理删除,从而避免了“删错索引导致服务雪崩”的风险。

给工程师的最终建议:

永远不要盲信理论上的“命中索引”。在提交代码前,尝试在本地构造与生产环境同数量级的测试数据(例如使用存储过程生成 50 万行数据),然后运行 EXPLAIN。只有当你亲眼看到 rows 字段从 500,000 变成了 1,你才能确信这行代码在生产环境是安全的。