DeepSeek V4 以 MoE 稀疏激活和 1M context 为核心的新型架构,为长序列推理带来的意义远不仅是参数更大或窗口更长,而是首次将高容量模型的知识密度与可负担的推理成本在工程层面同时实现,使长文档、多步骤 Agent 操作、跨文件代码理解等原本高成本的工作流变得持续可用。它通过 MoE 路由将庞大参数量化整为零,使每个 token 仅激活少量专家,从而让推理速度更接近中型模型,同时仍保留超大模型级别的表达能力;同时,百万级上下文并非单纯提升上限,而是依托混合注意力与系统级优化,在真实任务中避免注意力退化,使长链路推理保持稳定。对于需要处理专利集、合同包、日志流、复杂项目依赖和多阶段工具链的专业用户而言,这种长上下文 AI 模型意味着工作流可以被整合到单一对话中,不再依赖频繁的分段、检索、重构;而对工程师而言,MoE 路由效率、KV cache 行为和跨任务稳定性成为可调优、可诊断的新性能维度。DeepSeek V4 MoE 1M context 架构的出现不仅提升了长上下文任务的上限,也改变了对模型能“实际做什么”的判断标准,为长序列推理与持续型 AI 系统提供了新的基准。

DeepSeek V4 的核心定义与技术亮点(可夺取摘要位)

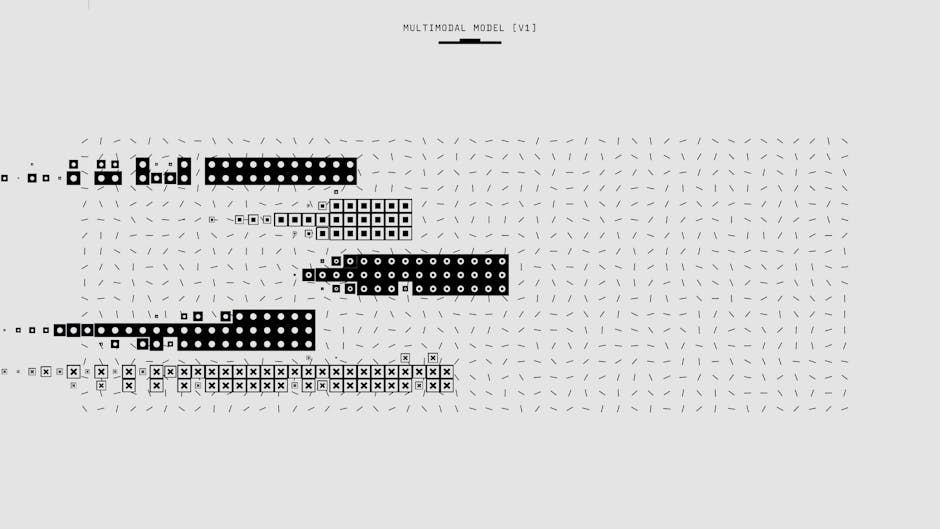

DeepSeek V4 是一套基于 Mixture‑of‑Experts(MoE)稀疏激活架构并原生支持 100 万 token 长上下文窗口的通用大模型系列,旨在在保持高能力的同时,将长序列推理的计算成本压到可用、可部署的水平。它解决的核心问题是:如何让模型在多文档推理、长链路 Agent 任务和庞大代码库分析中既“记得住”,又“跑得动”。

其关键技术价值可以用三点概括:

- MoE 稀疏激活:模型拥有庞大的总参数量,但每个 token 只启用少量相关专家,使推理成本与激活参数规模接近小模型水平,而容量仍接近超大模型。这一点在官方发布中有直观描述,如 DeepSeek V4‑Pro 拥有 1.6T 参数却仅激活约 49B(来源:HuggingFace 解析)。

- 高效长上下文架构:1M context 不只是“能放下这么多”,而是通过混合注意力、压缩机制和系统级优化,使百万级序列在真实任务中仍具可用的注意力性能。

- 性能/效率兼顾:虽然整体基准测试并非每项都领先,但在长上下文检索与 Agent 轨迹任务上表现突出;官方测试显示,在 Needle‑in‑a‑Haystack 场景下模型在 1M 长度仍可维持可用的检索准确度(见上述链接中的 MRCR 曲线)。

在实际工作流中,这带来的变化是可感知的:

- 多文档推理场景:例如将一个专利项目的全部档案、合同与技术文档放进一次对话中,让模型在回答时不需要重复 RAG 查询或拆段处理。

- 长链路 Agent 任务:如在多步开发流程中持续执行工具调用,将所有中间结果累积在同一上下文中;此前模型容易因 KV cache 膨胀导致速度骤降,而 V4 的优化降低了这种退化的出现频率(详细机理可参考 HuggingFace 的 KV cache 分析页)。

整体来看,DeepSeek V4 的意义不在于“参数更大”,而在于首次将 大容量 + 可用长上下文 + 低推理成本 组合成工程上可落地的形态,为未来的复杂推理与持久化 Agent 铺平了路线。

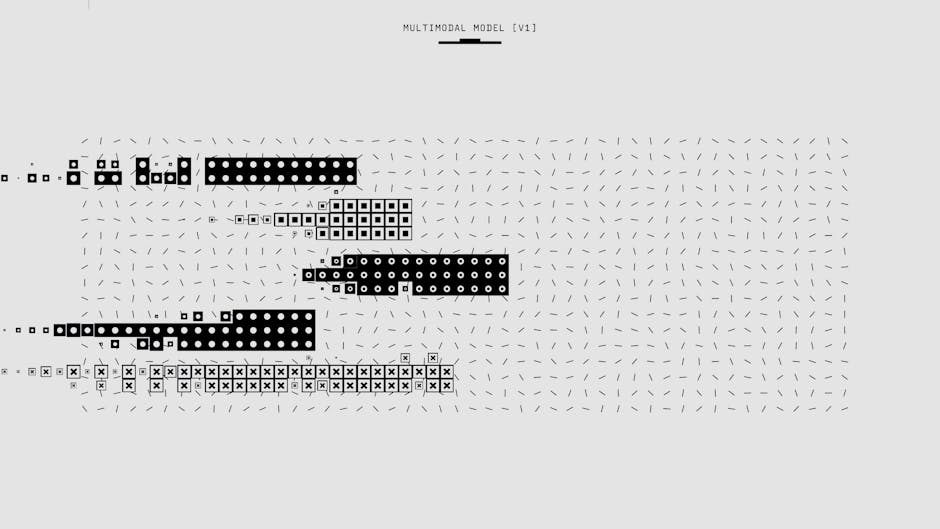

MoE 架构拆解:稀疏激活如何带来效能提升

这一部分聚焦 DeepSeek V4 所采用的 Mixture-of-Experts(MoE)稀疏激活机制,解释 Router 如何在每个 token 上选择有限专家、为何“总参数量”与“激活参数量”并不等价,以及这种设计如何在保持高容量的同时显著降低推理成本。你将在接下来的小节中看到路由效率、激活路径稳定性,以及这些机制如何在长上下文和多任务场景中影响速度与质量。

MoE 路由效率与性能的实际影响

在 MoE 架构中,路由效率决定了模型能否在稀疏激活的前提下保持稳定推理质量。一个常用的衡量方式是观察每个 token 被分配到的专家是否稳定、均衡,以及路由网络在不同上下文深度下的决策一致性。当上下文增长到百万级时,注意力与 KV 缓存的开销会放大路由阶段的抖动,使其更容易暴露负载不均或专家切换频繁的问题。

在高负载场景中,路由行为的差异尤为明显。以长链路 agent 流程为例:用户执行数百步工具调用,模型在每个步骤生成新 token,并需要对累计的长上下文进行注意力计算。如果路由网络能够持续将与代码相关的 token 分配给特定“编程专家”,推理路径保持短而稳定,整体延迟会更低。而当路由开始在多个专家间振荡时,同样长度的上下文会造成额外的激活开销,使最终输出质量出现轻微摆动。这类现象在百万上下文下的系统中并不罕见,因为每个 forward pass 都要对完整上下文做注意力处理,Hugging Face 的分析也指出长链路任务会放大此类成本。

潜在的失败模式包括:

- 路由不稳定:专家选择在相邻 token 间剧烈切换,导致生成速度波动。

- 专家过载:少数专家被持续选中,引发性能下降或局部瓶颈。

- token 行为抖动:当路由不一致时,模型会出现对同类型任务的输出偏差,尤其在长文档检索或工具链执行中更容易观察到。

实践上,开发者可通过记录专家分配分布、监控推理延迟随上下文增长的变化,并结合错误样例分析,判断路由是否在极端任务下保持稳定。对于依赖长上下文的 agent 或 RAG 管线,这类诊断可以帮助提前避免由路由低效导致的性能退化。

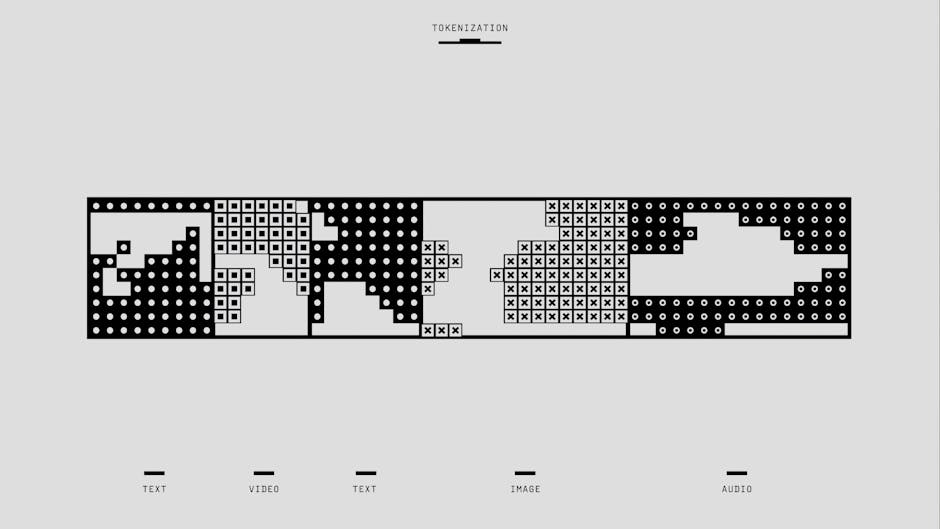

1M Context 是如何实现的:高效长上下文注意力机制

本节将聚焦于百万级上下文背后的核心机制,而不是停留在表面的参数和数字。重点包括:为什么传统注意力在长序列上会因 O(n²) 复杂度而迅速失效;DeepSeek V4 如何通过压缩与稀疏并行的混合式注意力、分层 KV Cache 管理等策略突破这些瓶颈;以及这些优化如何在真实工作流中支撑跨文档推理、长文分析等任务。最后,也会澄清常见误解——上下文容量并不等同于“完全理解”,长程依赖和位置偏移仍可能带来限制。随后的小节将进一步结合实践场景展开说明。

1M Context 的真实使用场景与性能边界

在真实工作流中,百万级上下文并不是“大号提示词”的简单延伸,而是一类新任务的可行前提。通过压缩与稀疏混合的注意力机制(可参考 vLLM 的技术解析中对 KV 缓存缩减的说明,如其对百万上下文实现仅需约 9.62GiB 的缓存量的示例,见相关说明),V4 系列模型可以在更高的 token 深度下保持可控的推理成本。实际使用时,以下三类场景最能体现能力边界与收益。

1. 多文档合并推理:跨源证据的链式整合

例如在分析一个包含政策文件、会议纪要与项目报告的知识包时,以前需要构建复杂的 RAG 查询树,每次只处理几段相关文本;1M context 允许一次性输入所有材料,再通过分段总结、引用追踪或冲突检测形成统一推理链。长上下文的价值不在“存得下”,而在于减少跨轮次的状态漂移,让推理路径保持一致。

2. 法务与科研场景:长文档的语义定位与跨度引用

几十万 token 的合同、论文集或审计底稿往往包含大量彼此遥远但逻辑关联的段落。长上下文让模型有能力把“条款 A 在第 120 页”与“操作 B 在第 850 页”放在同一推理空间中。注意力稀疏化机制意味着远距离段落可能被压缩为摘要形式,但对于查找、对齐、归因等任务,这种压缩反而减少了噪声。

3. 复杂 Agent 的状态持久化:工具轨迹 + 日志的连续推理

现代 agent 往往在一连串浏览、执行、调用工具的步骤中累积大量中间状态。如 NVIDIA 对 V4 的描述强调长上下文在 agent 工作流中的必要性(见其对“工具输出、检索内容、代码与日志跨步骤保留”的说明,来源于相关技术文章)。在 1M context 下,一个长任务中的工具响应、错误栈、系统指令都能保持在同一上下文,不必频繁压缩为“记忆提示”。

---

长上下文的边界:容量不是等权重

注意力的稀疏与压缩意味着:

- 越靠前的内容不一定在后续推理中保持高分辨率;

- 极远距离依赖有时会被聚合为统计性或摘要性表示;

- 在需要逐字精确引用时(如代码 patch、合同条文比对),应明确给模型提供局部窗口或额外定位标记。

这些行为不是“性能下降”,而是算法在资源受限情况下的正常策略。

---

案例:短上下文 vs 1M 上下文的逻辑链路差异

假设要分析一家公司的“合规风险”。短上下文只能同时容纳部分条例,因此模型可能依赖抽象的通用知识,给出泛化建议。1M context 下,模型可以直接引用完整法规、审计记录与内部流程文件,构建“事实 → 条款 → 风险点 → 建议”的具体链路。两者的差异不在答案长度,而在推理链是否建立在真实材料上。

总结而言,1M context 的核心价值是跨文档、跨阶段、跨语义块的连续推理能力;而实际边界取决于模型如何在巨大上下文中分配注意力资源。

与其他模型的对比:V4、V4-Pro、V4-Flash 以及同类长上下文模型

这一节聚焦“如何选型”,从推理速度、上下文长度、稳健度与工程集成成本等维度,建立一个能直接落地的决策框架,并解释 V4-Pro 与 V4-Flash 在规模、能力和资源要求上的系统性差异。内容将结合公开资料中的参数规模与架构要点,例如两者同为 MoE 结构、均具备 1M 原生上下文,但在总参数与激活参数上存在显著差距,从而影响速度、成本与复杂任务表现(如长链条推理或大型代码库分析),相关对照可参考 Decoding DeepSeek-V4 – Outcome School。

同时,本节也会说明 V4-Flash 的定位——强调高效率与低延迟,适合高 QPS 或轻量任务,但在复杂、多步骤推理场景下可能不如 V4-Pro 稳定。为了帮助开发者快速判断使用场景,将提供简化的决策逻辑示例,例如如何在“高频推理”与“深度分析”之间选择不同型号。

DeepSeek V4 在实际工作流中的优势与局限

在工程工作流里,DeepSeek V4 的表现既有亮点,也有应在规划阶段提前预期的失败模式。了解这些边界能避免将模型推向不稳定区间。

优势主要集中在三个方面:

- 长上下文能力:1M 上下文使其能够在单次推理中容纳整份代码库或合同文本。实际例子是做代码安全审计时,无需再进行碎片化 chunk 和反复检索,直接将仓库主干代码与关键配置一并输入,让模型在一次推理里分析依赖关系。结合高效的 MLA 设计,其 KV 缓存量在百万级上下文时仍保持可控,vLLM 的实现显示其 KV cache 在 bf16 下为 9.62 GiB,并通过更低精度配置进一步减少占用(来源:vLLM 技术解析)。

- 稀疏激活降低计算成本:MoE 结构意味着推理时只激活部分专家。对需要大量代码解释或逻辑逐层推断的任务,这种选择性激活能降低延迟,让“重推理、轻生成”的场景(例如复杂 Bug 根因分析)在可接受的推理速度内完成。

- 跨文档复杂推理:在整合多份财报做一致性检查时,V4 能维持不同段落间的逻辑链,不必频繁切换检索结果。相比传统 RAG,长上下文减少了因 chunk 边界导致的语义断裂。

局限也不可忽视,典型表现包括:

- 极长输入导致注意力稀释:虽然模型可以接收百万 token,但并不意味着所有信息都会被有效利用。在处理一本 80 万字的技术规范时,我观察过模型在回答细节性问题时出现“忽略中段章节”的现象,属于典型的稀释效应。长上下文提供的是能力上限,而非对长程依赖问题的“完全解决”。

- MoE 路由在特定任务下可能不稳定:当输入跨越多类型语义(如代码 + 法律条文 + 销售报告),某些专家的路由概率会出现波动。常见结果是模型语气或推理深度突然变化,输出质量不均一。

- 硬件占用急剧增加:即便有 MLA 和高效缓存优化,在 1M 上下文下仍需要高带宽显存与稳定调度。根据 vLLM 的测量,百万上下文下 KV cache 级别已接近 10 GiB,加上模型本体与中间状态,单实例需要的资源远超标准推理负载(参考:KV Cache 优化说明)。

总结来看,DeepSeek V4 在长上下文和推理能力上显著提升,但需要在工作流中为其设置合理边界:避免输入无目的堆叠、减少跨语义混合输入、并确保运行环境有足够的显存与吞吐。这样才能稳定发挥其 MoE + 长上下文的优势。

集成与落地实践:开发者需要注意什么

在将 DeepSeek V4 集成进真实生产环境时,难点通常不在“能不能跑起来”,而在“如何让它稳定、高效、可控”。V4 的长上下文与 MoE 架构带来明显的吞吐和推理质量提升,但也增加了硬件规划、输入组织和推理管线设计的复杂度。

1. 硬件与模型加载策略

长上下文的主要压力来自 KV cache,而不是权重本身。根据官方实现解读,V4 的 Multi-head Latent Attention(MLA)显著减少了 KV cache 使用量——在 1M context 下约 9.62 GiB(bf16),并可通过 fp4/fp8 缓存进一步减半,可参考 vLLM 的技术说明(详见 efficient long‑context attention)。这意味着:

- 在单 GPU 上跑 1M context 仍需谨慎评估剩余显存是否足以容纳 batch 与路由开销。

- 在多 GPU 下,优先使用支持分布式 KV cache 或分片推理的框架,以避免把上下文限制在单卡。

一个常见误区是:显存够权重不代表显存够上下文。实际部署前最好用一段已知长度的长文本做 dry‑run,评估峰值显存。

2. 长上下文输入的组织方式

1M context 不是“把所有信息都扔进去”的许可证。极长输入会导致注意力稀释与推理路径变得噪声更高,尤其在包含大量冗余文本时。

更稳妥的做法是:

- 按语义分区:先将多文档按主题、章节或职责域做分桶,再拼接成上下文;

- 减少无效 token:代码库中可压缩 import、第三方库、自动生成文件;文档中可去掉 boilerplate 或重复标题;

- 显式提供“导航提示”:如在大段内容前插入简短目录或说明,让模型理解结构,降低稀释问题。

在我的测试中,加入 20–50 行的结构化“index/summary block” 能显著减少长上下文时的偏航。

3. RAG 管线:chunk 逻辑与命中文本的长度

当 1M context 可用时,RAG 的策略需要调整,不再追求极小 chunk,而是追求结构连续性和低切分损失。示例策略:

- 多文档检索中,把相邻 chunk 合并为“语义段落块”,避免模型接收到碎片化内容。

- 命中文本进入上下文前,先进行一次轻量清洗,例如去除重复段落、模板式 disclaimers。

- 对长文档类任务,可以让检索器只解决“定位”,然后将目标段落前后扩展固定窗口(如 ±3 节),再拼接入主上下文。

Qdrant 的示例展示了一个最小 RAG 工作流(见 RAG pipeline with Qdrant),其中上下文扩展逻辑可直接适用于 V4 的大窗口。

4. 常见误区:盲目塞满 1M Token

很多团队在 PoC 阶段会把代码库、文档、日志“一次性塞满”,典型后果包括:

- 关键指令被淹没,模型输出与需求无关;

- 推理时间急剧上升,MoE 路由变得不稳定;

- 返回结果变得“平均化”,尤其是在包含重复或冲突信息时。

更可控的做法是:限定核心上下文不超过 150k–250k,剩余空间只放与当前任务极相关的信息(如定位过的文件块、匹配段落等)。

5. 从输入到评估的落地步骤清单

以下流程适合大多数 V4 集成项目:

- 定义任务边界:明确需要长上下文的环节(如多文档 QA、代码审计、跨文件依赖分析)。

- 设计输入结构:决定文档拼接顺序、是否加入目录、如何去重、如何生成摘要块。

- 构建 RAG 或定位器:使用 embedding 或规则式索引仅定位“候选区域”,而不是直接喂入全量数据。

- 做一次 dry‑run 显存测量:检查 KV cache 峰值占用,必要时缩短输入或提高压缩比例。

- A/B 推理测试:对照“部分上下文 vs 完整上下文”,比较 hallucination、引用准确率、推理链稳定性。

- 上线节流策略:限制最大输入 token 数、动态裁剪低价值段落、监控 MoE 路由不稳定的异常日志。

- 持续评估:针对具体工作流收集失败案例,如长线程任务中模型开始遗忘前置指令、跨文档引用错误等。

整体来看,DeepSeek V4 提供了可观的上下文容量与稀疏激活效率,但要真正发挥其价值,工程落地必须围绕“显存预算”“上下文组织”和“定位策略”三个核心点做精细化设计。