在现代企业的数字化转型进程中,非技术背景的管理层往往陷入一种追求完美的误区,误以为高质量的软件服务必须等同于绝对的零故障运行。然而,从 Google SRE 的核心工程实践来看,这种直觉恰恰是阻碍业务敏捷性的最大绊脚石。试图追求理论上的 100% 可用性成本 极高,这不仅是一个受限于物理定律的悖论,更会导致严重的边际效益递减——因为消除最后 0.01% 风险的代价,往往是牺牲 100% 的功能发布速度。为了打破这种“求稳”与“求快”的零和博弈,我们需要引入 SRE 错误预算 这一关键杠杆。它不再将系统故障视为单纯的运维事故,而是将其重新定义为一种可被量化、可被消费的“创新资源”。通过严谨的 SLO 计算公式,技术团队可以将抽象的可靠性百分比转化为具体的 可用性时间换算,从而与业务方达成共识:为了换取市场响应速度,系统必须拥有“出错的权利”。当团队能够精准掌握 微服务 SLO 设定,并建立起基于 SRE 燃烧率报警 的动态反馈机制时,开发与运维的对立便转化为基于数据的协作。一旦触发生效的 错误预算耗尽策略,团队便能有理有据地暂停变更以重构稳定性,这种基于经济学原理的工程治理方式,正是向决策者证明为何“适度的不完美”才是实现商业价值最大化最优解的有力武器。

核心概念:为什么“错误预算”是平衡创新的关键

对于大多数非技术背景的管理层来说,“可靠性”往往被视为一个二元状态:系统要么是好的,要么是坏的。因此,直觉上的目标往往是追求“100% 在线”。然而,在现代软件工程中,100% 的可用性意味着 0% 的变更速度。如果系统绝对不能出错,那么我们就不能发布任何新代码,不能进行架构升级,也不能修复非紧急 Bug。

为了打破这种“求稳”与“求新”之间的僵局,我们需要引入错误预算 (Error Budget) 的概念。它不再将错误视为单纯的失败,而是将其转化为一种可以被量化、管理和消费的资源。

核心定义:错误预算 (Error Budget)

错误预算是系统在特定时间内被允许出现的“不稳定性”总量。它是开发团队在必须停止新功能发布以专注于稳定性修复之前,可以“消耗”的额度。

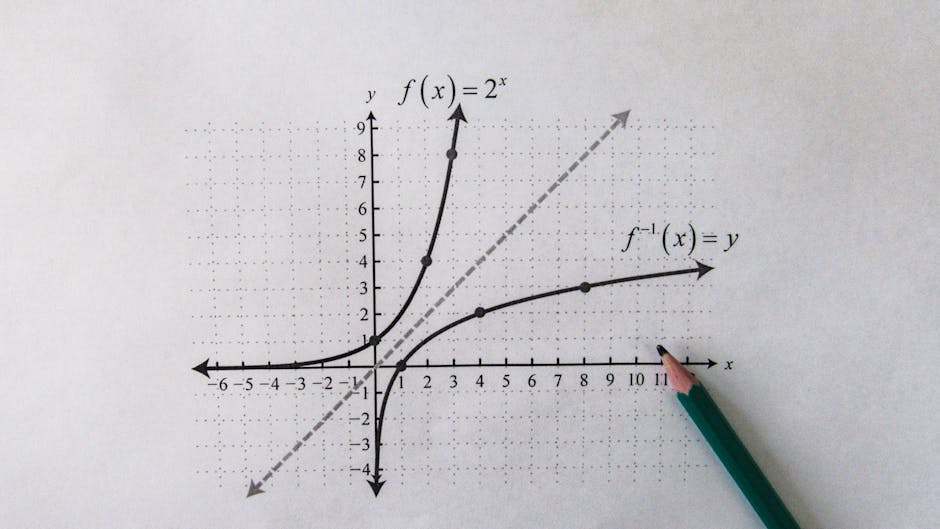

计算公式:错误预算 = 100% - SLO (服务等级目标)

将错误预算视为“创新代币” (Innovation Token)

向管理层解释时,最有效的类比是将错误预算视为团队手中的“创新代币”。每一次发布新功能、执行复杂的数据库迁移或进行生产环境实验,本质上都是在“花费”这个预算。

正如 Google SRE 的起源 所强调的,错误预算将开发 (Dev) 和运维 (Ops) 的对立关系转化为一种协作机制:

- 当预算充足时(绿灯): 团队拥有“创新特权”。我们可以激进地发布代码,尝试高风险的技术重构,因为我们还有额度可以用来应对潜在的故障。

- 当预算耗尽时(红灯): 团队必须停止所有非必要的变更。此时的重心强制转移到提高系统稳定性上(例如优化自动化测试、改进监控),直到预算在下一个周期重置。

为什么不能追求 100%?

错误预算的核心逻辑在于承认风险是创新的副产品。如果管理层要求 100% 的可靠性,实际上是在要求团队消除所有风险,这会导致产品迭代停滞。

通过设定一个非 100% 的目标(例如 99.9%),我们实际上是与业务方达成了一项协议:“我们允许系统在 0.1% 的时间内出现问题,以换取更快的发布速度和更敏捷的市场响应能力。” Atlassian 在解释错误预算的重要性时 指出,这种机制弥合了“追求速度”的开发团队与“追求稳定”的运维团队之间的鸿沟——只要停机时间保持在预算范围内,开发人员就可以在不受运维阻力的情况下保持敏捷。

100% 可用性的隐形成本:边际效益递减

在向管理层解释为何不追求 100% 可用性时,最强有力的论据往往不是技术限制,而是经济学原理。可靠性工程严格遵循“边际效益递减法则”(Law of Diminishing Returns):随着可用性目标的提高,每提升一个数量级的稳定性,所需的成本将呈指数级增长,而带来的业务价值却往往趋于平缓。

追求“下一个 9”的代价

为了直观地展示这一点,我们可以对比 99.9%(三个九)与 99.99%(四个九)之间的巨大鸿沟。这不仅仅是数字上的微小变化,而是架构复杂度的质变:

- 99.9% (Three Nines): 允许每月约 43.2 分钟 的停机时间。这通常可以通过标准的负载均衡、自动扩缩容和基本的数据备份来实现。

- 99.99% (Four Nines): 允许每月仅 4.32 分钟 的停机时间。要达到这一标准,系统不能仅仅是“可恢复”的,它必须几乎是“无感切换”的。

根据行业经验,从 99.9% 提升到 99.99% 往往意味着基础设施成本的数倍增加。正如 The cost of 99.99% uptime 所指出的,为了这额外的“一个 9”,企业必须承担以下隐性成本:

- 基础设施冗余 (Capacity): 需要 N+1 甚至 N+2 的冗余设计,包括热备(Warm Standbys)和双活集群,这通常会导致基础设施费用增加 25% 到 60%。

- 数据一致性与流量 (Traffic): 跨可用区(Multi-AZ)甚至跨地域(Multi-Region)的数据实时复制,不仅增加了架构复杂度,还会带来昂贵的跨域流量传输费用。

- 人力成本 (People): 需要更深度的 On-call 轮值、频繁的混沌工程演练(Chaos Drills)以及专门的 SRE 团队来维护自动化回滚流水线,这直接增加了人力开销和团队倦怠风险。

用户感知的“掩蔽效应”

另一个关键的商业论据是用户的感知阈值。即使你的服务端做到了 100% 可用,用户端的体验仍然受限于他们自己的网络环境。

如果用户的手机网络或家庭 Wi-Fi 的可用性只有 99.9%(这在现实中很常见),那么你的服务即使花费巨资做到了 99.999%,用户也无法感知到这其中的差异。这种现象被称为“掩蔽效应”——用户端的不可靠性掩盖了服务端的高可靠性。

因此,对于非核心业务(如用户头像显示、评论区加载),追求极致的可用性在商业上是非理性的。投入数百万美元去消除那最后 0.01% 的故障概率,通常无法带来同等比例的收入增长或用户留存提升。

结论: 100% 的可用性不仅在物理上几乎不可能(受限于光速延迟、硬件物理故障等),在经济上也是极度浪费的。错误预算的存在,正是为了防止我们将有限的工程资源浪费在用户无法感知的“过度可靠性”上。

量化预算:将百分比转化为具体的“停机时间”

对于非技术背景的管理层来说,"99.9%" 和 "99.99%" 听起来仅仅是数字上的微小差异,但如果将其转化为具体的时间窗口,这种差异就会变得触目惊心。要让老板理解错误预算的稀缺性,最直接的方法就是将抽象的百分比“翻译”为具体的停机时间配额。

停机时间速查表

在讨论 SLO(服务等级目标)时,建议直接使用下表来展示不同可用性级别所允许的“故障时间”。这能直观地表明:追求更高的“9”意味着我们的容错空间将呈指数级缩减。

可用性目标 (SLO) | 俗称 | 年允许停机时间 | 月允许停机时间 (30天) | 周允许停机时间 |

|---|---|---|---|---|

99% | Two Nines | 3天 15小时 36分 | ~7.2 小时 | ~1.68 小时 |

99.9% | Three Nines | 8.76 小时 | 43.2 分钟 | ~10.1 分钟 |

99.99% | Four Nines | 52.56 分钟 | 4.32 分钟 | ~1.01 分钟 |

99.999% | Five Nines | 5.26 分钟 | ~26 秒 | ~6 秒 |

注意:从 99.9% 提升到 99.99%,不仅仅是增加了一个数字,而是将每月的故障处理时间从“一顿午饭的时间”(43分钟)压缩到了“上个厕所的时间”(4分钟)。

计算逻辑演示

为了让团队和管理层达成共识,你需要透明化错误预算的计算公式。以下是一个标准的计算范例,你可以直接用于内部演示:

场景假设:

- SLO 目标:99.9%

- 统计周期:30 天

计算步骤:

- 计算总时间窗口:

- 计算不可用比例:

- 得出错误预算:

这意味着,在这个月内,只要发生一次持续 45 分钟的数据库宕机,团队的错误预算就会彻底耗尽(Burned Completely)。此时,按照 SRE 原则,所有的功能发布都应暂停,直到周期结束或系统稳定性得到实质性修复。

关键区分:基于时间 vs. 基于请求

在量化预算时,必须明确你的 SLO 是基于时间还是基于请求,混淆这两者是导致统计偏差的常见陷阱。

- 基于时间 (Time-based Availability):

- 定义:系统在多长时间内处于完全不可用状态。

- 公式:

- 适用场景:单体应用、不易拆分的传统服务。

- 局限性:如果一个高并发服务在 10 分钟内有 50% 的请求失败,基于时间的监控可能判定其为“部分可用”甚至“在线”,从而低估了影响。

- 基于请求 (Request-based Availability):

- 定义:成功处理的请求占总请求的比例。

- 公式:

- 适用场景:微服务、API 网关、高吞吐量系统。

- 优势:能捕捉到“服务降级”或“部分节点故障”对用户体验的真实影响。根据 AWS 的可靠性支柱文档,在复杂的分布式系统中,基于请求的计算通常更能反映用户的真实感受。

警示:切勿在同一个计算中混用这两个维度。例如,不要试图用“停机分钟数”去扣减“基于请求总量的预算”。如果你的 SLO 是 99.9% 的请求成功率,那么错误预算的单位应该是“允许失败的请求数量(Count)”,而不是“分钟(Minutes)”。

微服务架构下的预算计算挑战

在单体应用时代,可用性计算相对直观:应用挂了就是挂了。但在微服务架构中,服务间的依赖关系使错误预算的计算变得极为复杂。一个服务的 SLO(服务等级目标)不再仅仅取决于其自身的代码质量,更受限于其依赖链条中所有服务的稳定性。

依赖传导与“可用性上限”

最常见的误区是认为只要自己的服务代码完美,就能设定极高的可用性目标。然而,如果服务 A 同步调用服务 B,那么服务 A 的理论最大可用性永远无法超过服务 B。

场景示例:

假设你的核心业务服务(Service A)依赖于一个下游的用户认证服务(Service B)。

- Service B 的 SLO:99.9%(允许每月停机约 43 分钟)。

- Service A 的目标:99.99%(允许每月停机约 4 分钟)。

这是一个数学上无法成立的目标。一旦 Service B 耗尽了它的 43 分钟预算,Service A 也会随之不可用,从而瞬间击穿自己的 4 分钟预算。在强依赖链条中,可用性是相乘的(Serial Availability):

这意味着每增加一个串行依赖,整体可用性就会下降。如果你的服务依赖于三个 99.9% 的服务,你的基础可用性上限实际上只有 。

复合 SLO (Composite SLOs) 与木桶效应

为了准确设定预算,SRE 必须引入 复合 SLO 的概念。这要求在定义预算时,必须遍历调用链路图(Call Graph)。

架构师的经验法则(Rule of Thumb):

除非实施了有效的熔断或降级策略,否则你的错误预算上限由依赖链中最薄弱的一环决定。

在微服务网格(Mesh)中,你不能承诺比你的“最弱依赖”更高的稳定性。如果下游服务只能保证 3 个 9 的可用性,上游服务承诺 4 个 9 就是虚假承诺,除非你从架构层面切断了这种强依赖。

打破预算枷锁的架构手段

如果业务方坚持要求 Service A 达到 99.99%,而依赖方 Service B 只有 99.9%,工程团队必须在架构上证明这种“超越依赖”的可能性。这通常意味着引入复杂的容错机制,而非简单的代码优化:

- 激进的缓存策略(Aggressive Caching):当 Service B 不可用时,Service A 是否可以返回陈旧数据(Stale Data)从而维持服务?

- 默认值与降级(Fallbacks):当非关键依赖(如推荐引擎)失败时,是否能返回一个静态列表,从而不消耗 Service A 的错误预算?

- 异步解耦:将同步的 RPC 调用改为基于消息队列的最终一致性模型,使 Service A 在 Service B 宕机期间仍能接收请求。

在与非技术管理层沟通时,这一部分至关重要:高可用性的预算不是免费的。如果他们想要 99.99% 的指标,而基础设施只有 99.9% 的底子,那么中间的差值(0.09%)必须通过昂贵的架构改造(缓存、队列、冗余)来填补。

当预算耗尽时:制定可执行的“后果策略”

许多团队实施 SLO 的最大败笔在于:当错误预算(Error Budget)耗尽时,什么也没有发生。仪表盘变成了红色,但发布流水线依然照常运行。此时,最常见的质疑来自业务侧:“难道预算归零,我们就真的要停止所有发布吗?”

对于资深工程师而言,现实的答案通常不是“彻底关停”,而是焦点的强制转移。错误预算耗尽不应被视为一种惩罚,而是一个保护信号,表明系统已经处于极其脆弱的状态,无法承受更多因变更带来的熵增。

要让这一机制生效,必须制定一套具体的“后果策略”(Consequences Policy)。关键在于,这份策略必须在事件发生前由工程团队、产品负责人和业务高管共同签署确认,而不是在发布受阻的争吵中临时谈判。

常见的执行策略(Enforcement Policies)

当预算耗尽或燃烧率过高时,可以按严重程度触发以下几种策略:

- 特性冻结 (Feature Freeze)

这是最标准的响应措施。除了紧急的安全补丁(P0 Security Fixes)和针对当前稳定性问题的修复外,暂停所有非关键功能的发布。这并非永久性的,通常持续到预算恢复(例如滚动窗口移出旧错误)或系统稳定性得到验证。这迫使产品经理在“新功能”和“现有功能的可用性”之间做出实质性的权衡。 - 可靠性冲刺 (Reliability Sprints)

如果某个服务频繁耗尽预算,这表明存在系统性的技术债务。此时不仅要冻结发布,还应将工程团队的下一个 Sprint 专门用于“偿还债务”。工作内容包括优化慢查询、增加熔断机制、完善自动化测试或重构脆弱的代码路径。正如 Google SRE 团队关于维护窗口的讨论 所述,如果维护窗口持续消耗预算且没有改进计划,实际上是在隐性接受不可靠性。 - 发布延期 (Launch Freeze)

对于即将上线的新产品层级或重大版本,如果依赖的基础服务预算已耗尽,必须推迟发布。这通常是最痛苦但最有效的策略,因为它直接关联到业务目标,能够迅速引起高层对稳定性问题的重视。

现实世界的妥协:“银弹”与信用机制

在纯粹的理论中,预算耗尽意味着 100% 的冻结。但在现实的商业环境中,总会有“不得不发”的时刻(例如配合合规要求的更新或超级碗广告期间的活动)。

资深 SRE 通常会引入“银弹” (Silver Bullets) 机制。这是一种允许打破规则的例外条款,但必须极其昂贵且难以使用:

- 高层级审批: 只有 VP 或 CTO 级别才有权批准在预算耗尽时强行发布。

- 事后复盘: 每使用一次“银弹”,必须触发最高级别的事故复盘(Post-mortem),分析为何会被迫在系统不稳时发布,并制定长期的整改计划。

这种灵活性避免了 SLO 变成僵化的教条,同时通过增加“官僚成本”(审批流程和复盘压力),确保团队不会滥用例外条款。如果没有任何后果策略,错误预算就只是一个虚荣指标;只有当它真正能通过“痛感”来调节发布节奏时,它才成为了治理系统的有效工具。

进阶 SRE:燃烧率 (Burn Rate) 与告警降噪

在实施 SLO 的早期阶段,最常见的挫败感来自“告警噪音”。许多团队最初的告警策略非常简单:设置一个错误率阈值(例如“当 5xx 错误率超过 0.1% 时报警”)。然而,在微服务和高并发场景下,这种策略往往会导致两个极端:要么阈值太低,On-call 工程师在凌晨 3 点因为网络抖动被叫醒,而实际上这并没有威胁到月度 SLO;要么阈值太高,导致严重的“慢速错误”悄悄耗尽了所有预算,直到月底才发现为时已晚。

解决这个问题的 SRE 黄金标准是引入燃烧率 (Burn Rate) 概念。

什么是燃烧率?

燃烧率衡量的是“错误预算被消耗的速度”。与其关注当下的绝对错误数,不如关注“按照当前这个错误速度,我们的预算还能撑多久”。

- Burn Rate = 1:意味着你的服务将在 SLO 周期(通常为 30 天)结束的那一刻正好耗尽预算。这是理想的临界状态。

- Burn Rate > 1:意味着预算消耗过快,如果不加干预,将在周期结束前耗尽。

- Burn Rate < 1:意味着服务运行良好,你有富余的预算用于发布或实验。

通过监控燃烧率,我们将告警的逻辑从“现在有没有报错”转变为“现在的报错速度是否会威胁到我们承诺的 SLO”。

告警策略:快慢分治

为了实现降噪,我们通常会定义不同的燃烧率阈值来对应不同的响应级别。Google SRE 团队和业界实践通常建议使用多窗口、多燃烧率的告警策略,但对于刚起步的团队,可以简化为以下两条核心规则:

1. 快速燃烧 (Fast Burn) -> 立即呼叫 (Page)

当系统出现严重故障,预算正在以极快的速度流失时,需要立即人工介入。

- 触发条件示例:在 1 小时 的滑动窗口内,消耗了月度错误预算的 2%。

- 逻辑:这意味着当前的燃烧率约为 14.4 倍(

消耗比例 0.02 * 周期小时数 720 / 窗口小时数 1)。如果这种情况持续,你的 30 天预算将在约 2 天内耗尽。 - 行动:发送 PagerDuty/OpsGenie 告警,唤醒 On-call 工程师。

2. 慢速燃烧 (Slow Burn) -> 工单通知 (Ticket)

当系统存在轻微但持续的错误(如某个边缘功能的 Bug 或轻微的性能退化),预算在缓慢流失,虽然不会立即耗尽,但长期来看是不可持续的。

- 触发条件示例:在 6 小时 的滑动窗口内,消耗了月度错误预算的 5%。

- 逻辑:这意味着燃烧率约为 6 倍。虽然预算消耗速度是正常的 6 倍,但你仍有几天的时间来反应。

- 行动:发送 Jira 工单或 Slack 通知(仅在工作时间),不需要半夜叫醒人。

为什么这能降噪?

这种方法的精髓在于它过滤掉了所有不具备统计意义的异常。

- 忽略抖动:如果数据库在 1 分钟内拒绝了 50 个请求,但这只占你月度预算的 0.001%,燃烧率告警根本不会触发。你不需要为此起床。

- 捕捉隐患:如果一个新的金丝雀发布引入了 0.2% 的错误率,虽然看起来不高,但它会持续不断地“烧”预算。传统的“高阈值”告警可能抓不住它,但“慢速燃烧”策略会在几个小时内通过工单提醒你:“嘿,按照这个速度,我们下周就没预算发版了。”

通过这种方式,错误预算不再只是一个汇报时的数字,而是成为了智能告警系统的核心逻辑。它向老板和开发团队传达了一个明确的信息:只要告警没响,就说明我们的可用性余额是充足的,请放心大胆地发布。