OpenClaw 凭借其突破性的“计算机操作”与“浏览器操作”能力,迅速成为 AI Agent 领域的现象级项目,这标志着人工智能正从单纯的文本生成迈向实质性的系统控制与任务执行阶段。然而,这种能力的跃升直接导致了系统架构复杂度的指数级增加:OpenClaw 并非单一的脚本工具,而是一个融合了 NodeJS、Swift、Kotlin 等多种运行时环境的精密系统,这使得其在服务器部署教程中对环境的一致性要求极高。对于致力于构建私有化智能助手的开发者而言,若缺乏清晰的架构规划,极易在复杂的依赖链中陷入部署报错排查的泥潭,导致项目无法顺利落地。构建一个高可用、可维护的 AI 代理,核心在于摒弃脆弱的源码编译方式,转而采用工业级的Docker容器部署方案。这种方案不仅能通过标准化的镜像封装彻底解决跨语言环境的兼容性难题,还能利用一键部署脚本实现环境的快速复刻与迁移,是目前从零搭建教程中最稳健的“快乐路径”。本指南将深入剖析云服务器环境配置的关键选型逻辑,详解如何通过标准化的自动化部署流程屏蔽底层操作系统的差异,确保 OpenClaw 能够像商业软件一样稳定运行。通过掌握这套生产级的部署方法论,开发者不仅能规避繁琐的环境调试过程,更能建立起一套完善的项目上线维护机制,从而真正释放 OpenClaw 在操控微信、自动化办公以及复杂任务处理上的核心价值,将其转化为一个听命于你的强大数字员工。

部署前的核心决策:环境选型与方案对比

OpenClaw 作为一个具备“计算机操作(Computer Use)”和“浏览器操作(Browser Use)”能力的 AI Agent,其架构复杂度远超一般的聊天机器人。它不仅是一个简单的 Python 脚本,而是集成了 NodeJS、Swift、Kotlin 等多种语言环境的复杂系统。因此,在执行任何安装命令之前,正确的环境选型是确保系统长期稳定运行的关键。

1. 硬件资源需求评估

OpenClaw 的资源消耗主要取决于你是否在本地运行大模型,以及 Agent 的并发任务量。对于大多数通过 API(如 Claude 3.5 Sonnet 或 OpenAI GPT-4o)连接大模型的用户,服务器主要承担逻辑处理和环境交互,但即便如此,Java 和 Node.js 运行时的内存占用依然不可忽视。

- 推荐配置(生产环境/长期运行):

- CPU: 2 vCPU 以上(处理并发 WebSocket 连接和本地自动化任务)。

- RAM: 4GB RAM(强烈建议)。虽然 2GB 勉强可启动,但在处理复杂任务链或编译依赖时极易触发 OOM(内存溢出)。

- Disk: 40GB+ SSD(Docker 镜像及日志文件会随时间增长)。

- 最低配置(仅供测试):

- CPU: 1 vCPU

- RAM: 2GB(必须配置至少 2GB 的 Swap 交换分区,否则进程会被 Linux 内核的 OOM Killer 杀掉)。

专家建议:如果你计划让 OpenClaw 执行本地浏览器自动化任务(Browser Use),内存需求会显著增加,建议直接从 4GB 起步。

2. 操作系统选择:为何首选 Ubuntu

虽然 OpenClaw 理论上支持多种 Linux 发行版,但在服务器端部署时,Ubuntu 20.04 LTS 或 Ubuntu 22.04 LTS 是最佳选择。

- 内核兼容性:OpenClaw 的某些底层能力依赖较新的 Linux 内核特性,CentOS 7 等老旧系统内核版本过低,极易导致 Docker 容器网络异常或文件系统挂载失败。

- 纯净环境:建议使用服务商提供的“纯净版”系统镜像,避免使用预装了宝塔面板或 LAMP 堆栈的镜像。预装软件往往会占用 80/443 或 18789 等关键端口,导致 OpenClaw 启动冲突。

3. 部署方案对比:Docker vs. 源码编译

这是部署前最重要的决策。根据社区反馈和技术文档分析,OpenClaw 的源码部署涉及极其繁琐的跨语言依赖链。

以下是两种主流方案的深度对比:

维度 | 方案 A:Docker 容器化部署(强烈推荐) | 方案 B:源码编译部署(Source Code) |

|---|---|---|

部署难度 | ⭐ (简单) | ⭐⭐⭐⭐⭐ (极难) |

依赖管理 | 零依赖困扰。所有环境(Node, Swift, Kotlin)均打包在镜像中。 | 依赖地狱。需手动安装特定版本的 NodeJS、Swift、Kotlin,且极易发生版本冲突。 |

环境隔离 | 完美隔离。不污染宿主机环境,卸载只需删除容器。 | 深度耦合。依赖库可能破坏宿主机上其他应用的运行环境。 |

更新维护 | 一键拉取新镜像 ( | 需手动 |

适用场景 | 99% 的用户,尤其是希望快速上线体验功能的开发者。 | 需要修改 OpenClaw 核心底层代码的贡献者。 |

正如相关教程指出,手动配置环境极易陷入“Dependency Hell”(依赖地狱),尤其是 Swift 和 Kotlin 的环境在普通 Linux VPS 上配置极其耗时。因此,除非你有二次开发的核心需求,Docker 方案是目前唯一推荐的生产级部署路径。它能屏蔽底层系统的差异,确保你的 OpenClaw 能够像官方演示那样稳定运行。

方案一:Docker 容器化一键部署(推荐)

对于绝大多数用户而言,使用 Docker 容器化部署 OpenClaw 是目前最稳妥、最高效的“Happy Path”(快乐路径)。OpenClaw 作为一个现代化的 AI Agent 系统,其后端架构涉及 Node.js 环境、向量数据库连接以及复杂的 API 网关配置。如果采用源码编译安装,用户极易陷入由 Python 版本不兼容或依赖包冲突引发的“依赖地狱”(Dependency Hell)。

相比之下,Docker 方案将所有运行环境封装在标准镜像中,确保了“一次构建,到处运行”的一致性。无论你的服务器运行的是 Ubuntu、Debian 还是 CentOS,容器化部署都能屏蔽底层系统的差异,让你跳过繁琐的编译步骤,直接进入核心功能的配置与使用。

在本章节中,我们将通过标准化的流程引导你完成部署。整个过程被拆解为三个清晰的阶段:首先是基础环境的准备,确保宿主机具备运行容器的能力;其次是配置文件的生成与调整,这是让 AI 听懂你指令的关键;最后是服务的启动与验证,确保所有组件协同工作。跟随这套经过验证的流程,你可以在几分钟内拥有一个完全私有且可控的 AI 助手。

Step 1:基础环境搭建与 Docker 安装

在开始部署 OpenClaw 之前,必须确保宿主机拥有一个干净且现代化的容器运行环境。虽然许多云厂商提供预装 Docker 的镜像,但为了避免旧版本带来的兼容性问题(特别是 Docker Compose V2 的支持),建议在 Ubuntu 20.04/22.04 LTS 或 Debian 10+ 的纯净系统上手动执行以下标准化安装流程。

1. 安装 Docker Engine 与 Docker Compose

我们将使用 Docker 官方提供的安装脚本或标准软件源,这是最稳健的方案。请依次在服务器终端执行以下命令:

更新系统并安装必要工具:

sudo apt-get update

sudo apt-get install -y ca-certificates curl gnupg一键安装 Docker(推荐用于快速部署):

官方提供的便利脚本能够自动检测系统版本并配置稳定源,适合大多数部署场景。

curl -fsSL https://get.docker.com -o get-docker.sh

sudo sh get-docker.sh注:此脚本会自动安装 docker-ce、docker-ce-cli、containerd.io 以及最新的 docker-compose-plugin。

2. 解决“Permission Denied”权限问题

默认情况下,Docker 守护进程绑定 Unix socket 而非 TCP 端口,该 socket 属于 root 用户。如果直接以非 root 用户(如 ubuntu 或 admin)运行 Docker 命令,通常会遇到 permission denied 错误。

请务必执行以下命令将当前用户加入 Docker 用户组,避免后续频繁使用 sudo:

# 创建 docker 组(如果已存在会提示,可忽略)

sudo groupadd docker

# 将当前用户加入 docker 组

sudo usermod -aG docker $USER

# 激活更改(或者直接断开 SSH 重连)

newgrp docker3. 验证安装环境

环境搭建完成后,必须验证 Docker 引擎和 Compose 插件是否正常工作。OpenClaw 的编排文件依赖较新的 Compose 特性,因此版本检查至关重要。

执行以下命令:

docker --version

docker compose version预期输出示例:

Docker version 24.0.x (或更高), build ...

Docker Compose version v2.20.x (或更高)

如果能看到上述版本号输出,说明基础环境已准备就绪。若遇到 docker-compose: command not found,请检查是否安装了旧版的 Python docker-compose,建议移除并确保使用命令 docker compose(中间无连字符)调用官方插件。

提示:对于国内服务器(如腾讯云、阿里云),若下载速度过慢,可参考相关教程配置国内镜像加速源(如腾讯云镜像源),以提升镜像拉取效率。

Step 2:拉取镜像与 Compose 配置

为了彻底规避手动安装 NodeJS、Swift 和 Kotlin 等多语言环境时可能遇到的“依赖地狱”(正如痴者工良在部署教程中指出的,手动配置极为繁琐),我们推荐直接使用 Docker Compose 进行容器化部署。这种方式将 OpenClaw 所需的所有运行时环境封装在一个镜像中,能够实现真正的“开箱即用”。

请在服务器上创建一个部署目录(例如 ~/openclaw),并在其中新建一个 docker-compose.yml 文件。以下是为生产环境优化的标准配置模板,我们已预置了关键的数据持久化参数:

version: '3.8'

services:

openclaw:

# 使用官方最新稳定版镜像

image: openclaw/openclaw:latest

containername: openclawcore

restart: unless-stopped

# 端口映射:左侧为宿主机端口,右侧为容器端口

ports:

- "3000:3000" # Web 控制台端口

- "8080:8080" # API 交互端口

# 核心配置:环境变量

environment:

- TZ=Asia/Shanghai

# 基础模型配置 (支持 OpenAI, Moonshot, Claude 等)

- LLMPROVIDER=openai

- LLMBASEURL=https://api.openai.com/v1

- LLMAPIKEY=sk-your-api-key-here

# 微信/飞书控制开关 (设为 true 开启自动化接管)

- ENABLEWECHATPUPPET=true

- LOGLEVEL=info

# 数据持久化:防止重启后“失忆”

volumes:

# 映射配置文件,方便后续手动微调

- ./config:/app/config

# 映射核心数据库,保存对话历史与技能记忆

- ./data:/app/data

# 映射日志目录,便于排查启动错误

- ./logs:/app/logs

# 资源限制 (可选,防止 AI 进程占用过多内存导致服务器卡死)

deploy:

resources:

limits:

memory: 4G关键配置项解析

- 数据持久化 (Volumes):

配置中最重要的部分是volumes映射。OpenClaw 在运行过程中会生成大量的会话索引和技能配置(Skill Configs)。如果不将/app/data映射到宿主机,容器一旦重启或更新镜像,你的所有“调教”数据和记忆将全部丢失。务必确保宿主机目录./data拥有读写权限。 - 模型接入 (Environment):

虽然 OpenClaw 提供了交互式的onboard命令行工具来引导配置,但在 Docker 模式下,直接通过环境变量注入LLMAPIKEY是更高效的做法。如果你使用的是国内模型(如 Kimi/Moonshot),请确保LLMBASEURL填写正确,这能避免后续连接超时的问题。 - 网络端口 (Ports):

默认暴露的3000端口用于访问 Web UI。如果你的服务器通过 Nginx 反向代理或云服务防火墙管理访问,请确保该端口已在安全组中放行,或者根据需要修改ports左侧的映射端口(例如"80:3000")。

完成文件创建后,你的部署环境已准备就绪,下一步即可启动服务并进行健康检查。

Step 3:服务启动与状态验证

配置文件准备就绪后,接下来的步骤是将 OpenClaw 的容器服务正式拉起,并确认其运行状态。虽然 Docker 极大简化了部署流程,但在服务首次启动时进行严格的健康检查是必不可少的,这能帮助你快速排除端口冲突或环境变量配置错误等常见问题。

1. 启动容器服务

在包含 docker-compose.yml 的目录下,执行以下命令以“后台模式”(Detached Mode)启动服务。这样可以确保 OpenClaw 在后台持续运行,即使你关闭了 SSH 终端窗口也不会中断服务。

docker-compose up -d系统将自动拉取镜像(如果尚未下载)并创建容器。当终端显示 Started 或 Running 状态时,说明容器已成功创建。

2. 运行状态核查清单

容器启动并不代表服务一定可用。建议按照以下“三步法”验证 OpenClaw 是否真正进入了健康工作状态:

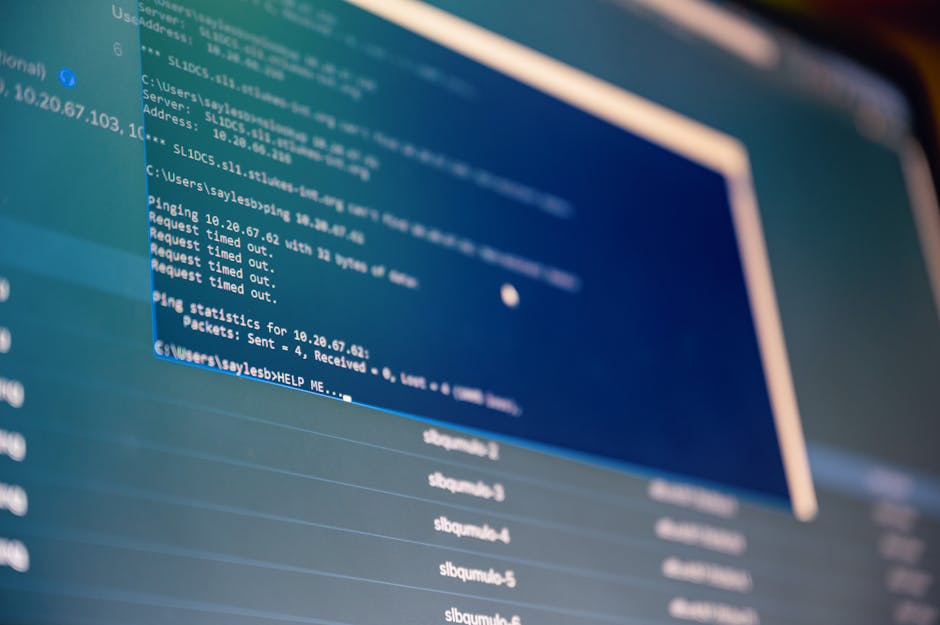

A. 检查容器生存状态

执行 docker-compose ps 或 docker ps 查看容器列表。

- 正常状态:

STATUS栏显示为Up x seconds或Up x minutes。 - 异常状态:如果显示

Restarting (1)或Exited,说明容器正在反复崩溃(Crash Loop),通常是因为配置文件格式错误或端口被占用。

B. 实时日志诊断

这是判断服务是否就绪的最准确方法。执行以下命令查看实时日志流:

docker-compose logs -f- 健康的启动日志:你会看到类似

Server listening on port 3000、Database connected或Ready to accept connections的提示。这表明核心进程已完全加载。 - 警惕报错信号:如果日志中出现

ECONNREFUSED(连接被拒绝)、API Key missing(密钥缺失)或Panic等关键词,请立即按Ctrl+C退出日志查看,并检查docker-compose.yml中的环境变量是否填写正确。

C. 访问 Web 界面

在浏览器地址栏输入 http://<服务器IP>:<端口号>(默认端口通常为 3000,具体取决于你在 Compose 文件中的配置)。

- 如果能看到 OpenClaw 的登录页面或初始化向导,恭喜你,服务搭建成功。

- 注意:对于部分云服务器,如果无法访问,请务必检查云服务商的控制台(如腾讯云、阿里云的安全组设置),确保对应的端口(如 3000)已在防火墙规则中对外开放。

提示:根据部分用户的部署经验,首次启动后可能需要在容器内运行配置向导。如果页面提示未配置,可使用docker exec -it openclaw-container-name openclaw onboard进入交互式配置模式,具体请参考后续的高级配置章节。

方案二:源码编译与手动搭建(进阶)

本方案适用于无法使用 Docker 环境、需要对 OpenClaw 进行二次开发,或必须在特定非容器化架构(如物理机、旧版 Linux 发行版)上部署的高级用户。

⚠️ 警告:源码部署要求用户具备极强的环境排查能力。OpenClaw 涉及多语言运行时(Node.js、Python、Go 甚至 Swift/Kotlin),手动配置极易陷入“依赖地狱(Dependency Hell)”。请务必严格遵循版本隔离原则。

1. 环境依赖与版本隔离

为了避免污染宿主机环境,强烈建议使用版本管理工具(如 nvm、pyenv)来锁定运行时版本。根据社区反馈与 痴者工良的部署经验,OpenClaw 对运行时版本非常敏感,版本不匹配是启动失败的首要原因。

推荐基准环境(Baseline):

组件 | 推荐版本 | 建议管理工具 | 说明 |

|---|---|---|---|

Node.js | v18.16.0 (LTS) |

| 前端及部分核心逻辑依赖,过高或过低版本可能导致 |

Python | 3.10+ |

| 用于 AI 模型推理接口及数据处理脚本。 |

Go | 1.21+ |

| 后端高性能并发模块及部分微服务组件。 |

Build Tools | GCC/Clang | 系统包管理器 | 必须安装 |

环境隔离操作示例:

# 1. 使用 nvm 锁定 Node 版本

nvm install 18

nvm use 18

# 2. 创建 Python 虚拟环境

python3 -m venv venv

source venv/bin/activate2. 源码获取与构建流程

请按顺序执行以下步骤,切勿跳过依赖安装环节。

第一步:克隆仓库

获取官方源码,并检出至最新的稳定分支(Stable Tag),避免使用不稳定的开发分支。

git clone https://github.com/openclaw/openclaw.git

cd openclaw

# 建议检出最新 Tag,例如:

# git checkout v1.2.0第二步:安装混合依赖

OpenClaw 采用前后端分离架构,需分别安装依赖。

# 安装后端/核心依赖

pip install -r requirements.txt

# 安装前端/Node 模块依赖

# 注意:此步骤可能会触发 C++ 扩展编译,请确保系统已安装 gcc/g++

npm install第三步:编译与构建

执行构建命令以生成静态资源和可执行文件。

# 构建前端资源

npm run build

# 编译后端服务(如果包含 Go 模块)

go build -o openclaw-server ./cmd/server3. 初始化配置与启动

源码部署没有 Docker 的环境变量自动注入,因此必须手动生成配置文件。OpenClaw 提供了一个交互式的配置向导 onboard,可引导用户完成 API Key、模型选择及权限确认。

# 启动配置向导

./openclaw-server onboard在配置过程中,系统会询问是否启用“Onboarding mode”。根据 相关部署教程 建议,初次使用者应选择 QuickStart 模式以跳过非必要的复杂设置,快速完成基础部署。

验证安装:

配置完成后,使用以下命令启动服务:

# 启动服务

npm start

# 或直接运行编译后的二进制文件

./openclaw-server start若控制台输出 Server is running at http://localhost:3000 且无报错堆栈,即表示环境搭建成功。若遇到 Module not found 或 Segmentation fault 错误,请首先检查 node -v 和 python --version 是否与上述推荐基准一致。

核心功能配置:微信接入与本地控制

OpenClaw 之所以能在 GitHub 上斩获高星,核心在于它突破了“对话框”的限制。大多数 AI 只是在陪你聊天,而 OpenClaw 通过 Adapters(适配器) 和 Capabilities(能力集) 的组合,真正实现了“不仅能听懂,还能动手”。本节将拆解如何配置其最核心的两大场景:通过微信远程下发指令,以及授权 AI 直接操控本地电脑。

1. 微信接入:打造随身携带的命令终端

OpenClaw 的架构允许通过不同的适配器(Adapters)接入聊天软件。接入微信后,你的微信窗口就变成了 AI 的远程控制台,无论是查询服务器状态还是触发自动化脚本,都可以通过一条微信消息完成。

配置机制与步骤:

通常有两种主流接入方式,取决于你部署的 OpenClaw 版本及使用的中间件(如 Wechaty 或特定的 Bridge):

- 修改配置文件 (

openclaw.json):

在 OpenClaw 的核心配置文件(通常位于~/.openclaw/openclaw.json或 Docker 映射卷中)中,找到adapters字段。你需要启用微信适配器并填入相应的协议配置。

"adapters": {

"wechat": {

"enabled": true,

"mode": "puppet", // 或其他桥接模式

"allowList": ["YOURWXID"] // 安全关键:只响应特定用户的指令

}

}注意:务必配置 allowList,否则你的 AI 可能会响应群聊中其他人的指令,造成安全隐患。

- 扫码登录与回调配置:

启动服务后,查看日志(docker logs openclaw或终端输出)。系统会生成一个二维码或登录链接。使用微信扫码后,OpenClaw 会获取登录凭证(Token)。部分高级配置可能需要你设置回调地址(Webhook),以便将微信接收到的消息推送到 OpenClaw 的处理端口。

2. 本地控制:赋予 AI “操作电脑”的权限

这是 OpenClaw 最强大也最危险的功能。开启“Computer Control”意味着 AI 可以像人类用户一样执行 Shell 命令、读写文件甚至安装软件。

权限与隔离策略:

- Docker 部署(推荐,安全受限):

默认情况下,Docker 容器内的 OpenClaw 只能“控制”容器内部的环境。这是一种天然的沙箱保护。如果你希望它能处理宿主机的文件(例如整理下载文件夹),需要通过 挂载卷(Volumes) 显式授权:

# docker-compose.yml 示例

volumes:

- /Users/yourname/Downloads:/home/openclaw/downloads # 仅暴露下载目录

- ./config:/root/.openclaw # 映射配置目录这种方式遵循“最小权限原则”,AI 即使发疯也只能删除挂载目录下的文件。

- 本地二进制运行(高能,高风险):

如果直接在宿主机运行 OpenClaw 二进制文件,它将继承当前用户的所有权限(sudo权限除外,除非你配置了免密)。这种模式下 AI 能力最强,可以调用系统级 API,但也意味着它的一行错误代码可能误删重要数据。建议仅在虚拟机或专用开发机上尝试此模式。

3. 配置排查:常见问题与解决方案

在打通微信与本地控制的过程中,环境差异往往会导致各种报错。以下是针对核心配置的“症状-方案”对照表:

症状 (Symptom) | 可能原因 (Cause) | 解决方案 (Fix) |

|---|---|---|

Login Timeout / 扫码无反应 | 网络延迟导致二维码过期,或 Docker 容器无法访问外网微信接口。 | 1. 检查服务器防火墙是否放行相关端口。<br>2. 查看日志刷新二维码,务必在 30 秒内完成扫码。<br>3. 确保容器 DNS 配置正确(如配置 |

API Rate Limit (429 Error) | 调用大模型(如 OpenAI/Claude)过于频繁,尤其是在 AI 陷入“思考死循环”时。 | 1. 在 |

Permission Denied (操作失败) | Docker 容器内用户(通常是 root 或 appuser)与宿主机挂载目录的 | 1. 在 Docker 启动命令中指定 |

Web 控制台无法访问 | 配置文件中未显式启用 UI 或 Token 验证失败。 | 检查 |

专家提示:在首次配置“本地控制”功能时,建议先开启dry-run模式(如果版本支持)或在 Prompt 中明确限制:“在执行任何删除或修改文件的命令前,必须先询问我”。这能有效防止 AI 的“热心办坏事”。

部署报错排查指南 (Troubleshooting)

在实际部署 OpenClaw 的过程中,由于操作系统差异、网络环境限制以及依赖版本的不同,遇到报错是常态而非例外。大多数教程通常只展示“快乐路径”(Happy Path),但在生产环境中,能够快速定位并解决异常才是保证服务稳定运行的关键。本节整理了 OpenClaw 部署中最高频的三个“拦路虎”,并提供基于日志分析的深度排查思路。

核心日志分析:定位问题的“听诊器”

在盲目尝试重启服务之前,首先需要获取准确的报错堆栈。

- Docker 部署(推荐):

如果容器启动失败,不要直接删除重建。使用以下命令查看实时日志:

docker logs -f openclaw --tail 100重点关注日志中以 Error、Exception 或 Caused by 开头的行。

- 本地源码启动:

如果是通过 Python 或 Node.js 直接运行,请检查控制台输出。如果服务静默失败,建议将标准错误输出重定向到文件以便分析:

nohup python3 main.py > output.log 2>&1 &

tail -f output.log常见报错速查表 (Symptom -> Cause -> Fix)

以下表格汇总了社区反馈中占比最高的几类阻断性问题:

故障现象 (Symptom) | 可能原因 (Cause) | 解决方案 (Fix) |

|---|---|---|

Port already allocated / Address in use<br>日志提示端口被占用,服务无法绑定。 | 本地已有服务(如 Nginx、旧版 Claws)占用了默认端口(通常是 8080 或 18789)。 | 1. 查杀进程:使用 |

Permission denied (EACCES)<br>容器启动后立即报错,提示无法写入 | Docker 容器内的进程通常以特定用户(如 UID 1000)运行,而挂载的主机目录属于 | 修正权限:在宿主机执行 |

API Connection Timeout / 502 Bad Gateway<br>Web 界面无法打开,或配置模型时提示连接超时。 | 1. 服务器国内网络无法直连 OpenAI/Claude 等境外 API。<br>2. 后端服务尚未完全启动。 | 1. 配置代理:在环境变量中添加 |

深度解析:“容器启动即退出” (Container Exits Immediately)

这是一个令许多新手崩溃的问题:执行 docker run 或 docker-compose up -d 后,容器状态显示 Exited (0) 或 Exited (1),且无法保持运行。

1. 前台与后台进程的误区

Docker 容器的设计原则是“运行一个前台进程”。如果 OpenClaw 的启动脚本在执行完初始化命令后就退出了(例如使用了 systemctl start 这种后台守护命令),容器会认为任务结束并自动关闭。

- 排查: 检查 Dockerfile 的

CMD或ENTRYPOINT,确保主程序(如python app.py或npm start)是在前台运行的,而不是作为后台服务运行。

2. 配置文件格式错误 (YAML Hell)

OpenClaw 依赖 config.yaml 或 docker-compose.yml 进行参数注入。YAML 文件对缩进极其敏感。

- 症状: 日志中出现

ScannerError或mapping values are not allowed here。 - 解决: 使用在线 YAML 校验工具检查配置文件。特别注意 API Key 是否包含特殊字符,建议使用双引号将 Key 值包裹起来。

3. 内存溢出 (OOM Killed - Exit Code 137)

如果容器运行一段时间后突然挂掉,且退出码为 137,通常是内存不足(OOM)。OpenClaw 在处理长上下文或加载本地向量库时内存消耗会激增。

- 诊断: 使用

docker inspect [container_id]查看State.OOMKilled是否为true。 - 解决:

- 如果使用阿里云轻量应用服务器,建议至少配置 4GB 内存或增加 Swap 分区。

- 在 Docker Compose 中添加资源限制(

deploy.resources.limits),但这只是防止宿主机崩溃,根源仍需通过升级配置或优化并发量解决。

长期维护:更新、备份与安全加固

在成功部署 OpenClaw 后,真正的挑战在于如何保障服务的长期稳定运行。对于承载了个人微信控制权与敏感数据的 AI Agent 而言,Day 2 运维(更新、备份与安全)的重要性甚至超过了初始部署。以下是针对生产环境的标准化维护指南。

平滑更新工作流

OpenClaw 作为一个快速迭代的开源项目,频繁更新是常态。为了避免版本更新导致的服务中断,建议采用基于 Docker Compose 的标准更新流程,而非直接在宿主机上进行不稳定的代码覆盖。

方案 A:基于 Docker 镜像更新(推荐稳定版用户)

如果你使用的是官方发布的 Docker 镜像,更新流程最为简单且风险最低:

# 1. 拉取最新镜像

docker compose pull

# 2. 重新创建并启动容器(仅重建有更新的服务)

docker compose up -d

# 3. 清理旧的无用镜像,释放磁盘空间

docker image prune -f方案 B:基于源码构建更新(适用于尝鲜最新功能)

如果你需要使用 GitHub 上的最新特性,或者参考了社区构建指南自行编译镜像,则需要先更新代码库再重建:

cd ~/openclaw

# 拉取最新代码并切换到最新 Tag

git pull

LATESTTAG=LATESTTAG

# 重新构建镜像并重启

docker compose build --no-cache

docker compose up -d注意:在执行大版本更新前,务必先查阅 Release Notes 中的 Breaking Changes(破坏性更新)说明。

自动化备份策略

OpenClaw 的核心价值在于其配置数据(Prompt 设置、知识库索引)和运行数据(对话历史)。根据部署经验,这些数据通常挂载在 openclaw-docker/config 和 openclaw-docker/data 目录中。

3-2-1 备份原则落地

不要依赖单一的服务器快照。建议编写简单的 Shell 脚本,配合 Crontab 实现每日自动备份:

#!/bin/bash

BACKUPDIR="/var/backups/openclaw"

DATADIR="/root/openclaw-docker"

DATE=BACKUPDIR

# 打包配置与数据目录

tar -czf $BACKUPDIR/openclawbackupDATADIR config data

# 保留最近 7 天的备份,删除过期文件

find $BACKUPDIR -type f -name "*.tar.gz" -mtime +7 -exec rm {} \;将上述脚本加入 crontab -e,设置为每天凌晨执行。对于关键数据,建议结合云厂商的自动快照策略进行整机备份,以应对系统级故障。

安全加固防线

由于 OpenClaw 具备“操控微信”和“执行电脑指令”的能力,其安全风险等级远高于普通 Web 服务。一旦管理端口暴露,攻击者可能通过 API 劫持你的微信账号。

1. 严禁端口裸奔,配置反向代理

切勿将 OpenClaw 的后端端口(如 9000 或 8080)直接暴露在公网。

- 错误做法:在安全组中放行 9000 端口,通过

http://IP:9000访问。 - 正确做法:使用 Nginx 作为反向代理,仅开放 80/443 端口,并配置 SSL 证书加密通信。这不仅能隐藏后端架构,还能防止中间人攻击窃取 API Key。

2. 启用系统级防火墙 (UFW)

在服务器内部,应通过 UFW (Uncomplicated Firewall) 严格限制入站流量,仅允许 SSH 和 Web 流量:

# 拒绝所有非必要入站连接

ufw default deny incoming

# 允许 SSH (如有修改端口请相应调整)

ufw allow 22/tcp

# 允许 HTTP/HTTPS

ufw allow 80/tcp

ufw allow 443/tcp

# 启用防火墙

ufw enable3. SSH 安全加固

作为基础设施的最后一道防线,SSH 的安全性至关重要。建议禁用密码登录并启用密钥验证,这能有效防御针对 root 密码的暴力破解攻击。黑客的自动化脚本全天候扫描公网 IP,弱口令服务器通常在上线数小时内就会失陷。

通过上述“更新-备份-加固”三位一体的维护体系,你可以将 OpenClaw 从一个单纯的“玩具”转变为可靠的“个人生产力基座”。