在数据隐私法规日益严苛的全球背景下,用户的“被遗忘权”已从单纯的法律条文演变为大模型(LLM)工程团队必须直面的顶级技术挑战。与传统关系型数据库中逻辑清晰的删除指令不同,大语言模型的训练本质是一场信息的深度有损压缩与全参数概率重构,敏感数据一旦被模型“学习”,便会通过反向传播算法化作数千亿参数中难以捉摸的微小权重变化,这使得物理层面的精确数据剥离在技术逻辑上几乎成为悖论。面对动辄数百万美元算力消耗的重新训练成本,单纯依靠“推倒重来”显然无法满足高频的合规需求,这迫使工业界必须转向探索“机器遗忘”(Machine Unlearning)这一前沿技术路径。本文将深入剖析这一复杂工程难题的底层逻辑,揭示如何在不破坏模型通用语言能力与逻辑推理基础的前提下,通过梯度上升(Gradient Ascent)及其变体算法,实现对特定知识的定向“擦除”与模型行为矫正。这不仅涉及对损失函数的精妙设计,更需要在最大化遗忘特定数据与规避“灾难性遗忘”风险之间寻找极窄的平衡点。掌握这一技术,不仅是企业高效应对GDPR等合规挑战的必修课,更是构建安全、可控且具备持续迭代能力的生成式AI系统的关键一环,标志着大模型治理从粗放的黑盒训练迈向了精细化的参数手术时代。

为什么“删除数据”在LLM中是一个复杂的工程难题?

在传统软件工程中,响应用户的“被遗忘权”(Right to be Forgotten)请求通常是一个标准化的数据库操作。无论是 SQL 中的 DELETE FROM table WHERE user_id = 'xyz',还是 NoSQL 中的键值移除,数据删除在逻辑和物理层面都是明确且可验证的。然而,当这一需求延伸至大语言模型(LLM)的训练数据时,工程师面临的是一个本质上完全不同的技术悖论。

数据库逻辑 vs. 神经网络权重

LLM 的核心并非信息的存储,而是信息的“有损压缩”与概率建模。当模型在预训练或微调阶段“学习”了一条敏感数据(例如某公司的私有代码或用户的个人住址),这条数据并不是以独立记录的形式存在于某个扇区,而是通过反向传播算法(Backpropagation),被“打散”并扩散到了数千亿个参数(Weights)的微小数值变化中。

这就好比试图从一杯已经烘焙好的拿铁中“删除”混入的一滴墨水。你无法通过简单的检索找到这滴墨水,因为它已经与整杯咖啡的物理结构融为一体。在技术层面上,机器遗忘(Machine Unlearning)要求我们精确定位并逆向操作这些权重的更新,这比简单的索引删除要复杂几个数量级。

“精确遗忘”的成本陷阱

从理论上讲,唯一能从数学上严格保证“数据已被彻底删除”的方法是精确遗忘(Exact Unlearning),即剔除目标数据后,从头开始重新训练模型(Retraining from Scratch)。

然而,在工程实践中,这种方法几乎不可行。训练一个具有竞争力的 LLM 成本极其高昂。根据行业估算,训练像 GPT-4 这样规模的模型可能涉及超过 1 亿美元的算力成本,即使是较小的开源模型,其训练成本也往往在数万至数十万美元量级。如果每收到一个 GDPR 删除请求就重新训练一次模型,企业的计算资源将迅速枯竭。

因此,学术界和工业界的研究重点被迫转向了近似遗忘(Approximate Unlearning)。这一路径不追求物理上的“重置”,而是通过算法手段调整模型权重,使其输出表现得“就像从未见过该数据一样”。

核心工程矛盾:消除影响 vs. 保持能力

对于 AI 工程师而言,实现“遗忘”的最大挑战不在于破坏记忆,而在于在破坏特定记忆的同时,不损害模型的通用能力。

这被称为“灾难性遗忘”(Catastrophic Forgetting)的逆向问题。如果我们简单粗暴地最大化目标数据的损失函数(Gradient Ascent),模型很可能会在抹除敏感信息的同时,破坏其语言理解能力或逻辑推理能力,导致“模型脑白质切除”般的后果。

相关综述研究指出,LLM 的遗忘任务必须在以下三个相互冲突的目标中寻找极其狭窄的平衡点:

- 遗忘有效性(Forget Quality): 目标数据是否真的无法被诱导生成?

- 模型实用性(Model Utility): 模型的通用问答能力是否下降?

- 计算效率(Efficiency): 算法运行的时间必须远低于重新训练的时间。

因此,当业务部门转达客户的“删除数据”需求时,技术团队交付的往往不是一个简单的“删除键”,而是一套复杂的参数优化流程,旨在以最小的代价擦除特定数据点在神经网络中的数学投影。

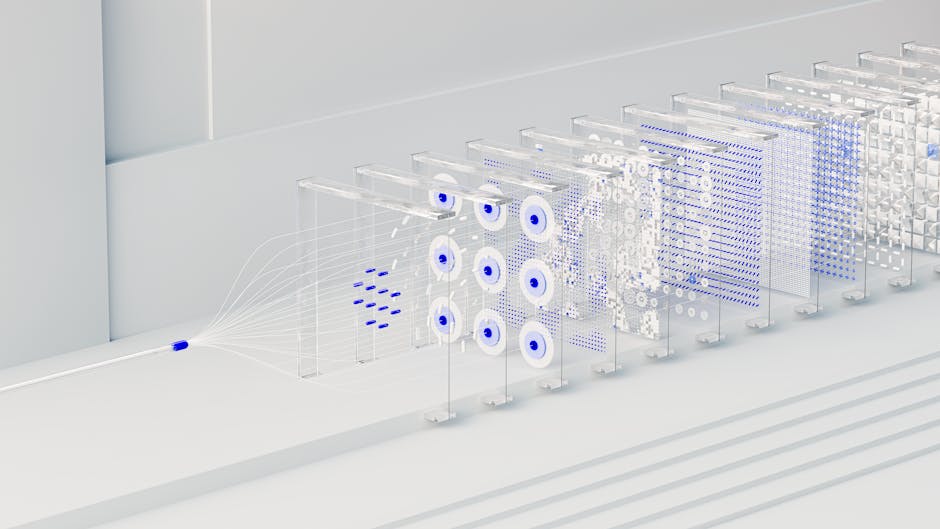

主流机器遗忘(Machine Unlearning)技术路线全景

在当前的大模型工程实践中,机器遗忘技术并非单一的标准组件,而是根据“遗忘质量”与“计算成本”的权衡,分化为三大主流技术路线。为了在保留模型通用能力的同时精准剔除特定数据影响,工程师通常需要在数据驱动(Data-driven)、优化算法(Optimization-based)与模型编辑(Model Editing)之间做出选择。

下表总结了这三种技术路线的核心逻辑与工程优劣势:

技术路线 | 核心定义 | 优势 (Pros) | 劣势 (Cons) | 典型代表 |

|---|---|---|---|---|

数据驱动方法<br>(Data-driven) | 通过对训练数据进行分片(Sharding)和隔离,仅对包含目标数据的分片进行重新训练,从而实现物理层面的“精确遗忘”。 | 理论保证最强:能实现数学意义上的“精确遗忘”(Exact Unlearning),安全性最高。 | 计算成本极高:尽管比全量重训快,但对于参数量巨大的 LLM 而言,存储分片模型和重训的开销依然不可接受。 | |

优化算法方法<br>(Optimization-based) | 将遗忘视为“反向训练”过程,在原有权重基础上,通过最大化遗忘数据的损失函数(Loss)来消除特定记忆。 | 无需重训:直接在当前模型上微调,计算效率高,适合在线服务场景。 | 稳定性风险:容易导致“灾难性遗忘”(Catastrophic Forgetting),即在删除特定数据时破坏了模型的通用语言能力。 | |

模型编辑方法<br>(Model Editing) | 直接定位并修改存储特定知识的神经元权重,或通过向量算术(如减去特定任务向量)来“切除”记忆。 | 极速处理:通常只需极少的计算步数,甚至是一次性算术操作即可完成。 | 定位困难:在“黑盒”大模型中精准定位特定事实的存储位置极具挑战,且难以处理这就隐性知识。 | Task Vectors (任务向量)、Rank-One Editing |

为什么 LLM 行业目前聚焦于“优化算法”?

尽管 SISA 等数据驱动方法提供了最严格的隐私保证,但在千亿参数(70B+)的大模型场景下,其存储和训练成本是工程团队无法承受的。因此,基于优化的方法(Optimization-based)是目前 LLM 遗忘技术的主流选择。

这类方法(特别是梯度上升及其变体)试图在“遗忘特定数据”和“保留通用能力”之间寻找平衡点。例如,IBM 的研究指出,单纯的梯度上升虽然能像“倒带”一样消除数据影响,但也极易误伤模型的其他能力。因此,现代的优化算法通常会引入“保留集”(Retain Set)进行约束,或者使用任务向量(Task Vectors)等技术,通过计算微调前后的权重差异来更精准地剥离特定知识,而无需进行昂贵的全量计算。

实战指南:基于梯度上升(Gradient Ascent)的遗忘算法实现

在工程实践中,完全重新训练(Retraining from Scratch)通常因成本过高而不可行。因此,基于梯度的优化算法成为了主流的“近似遗忘”手段。本节将深入代码逻辑,解析如何通过梯度上升(Gradient Ascent)及其变体,在保留模型通用能力的同时,定向抹除特定数据的记忆。

1. 数据集构建:遗忘集与保留集

实施机器遗忘的第一步并非调整参数,而是构建正确的数据对。与传统微调不同,我们需要两个关键的数据集:

- 遗忘集(Forget Set, ):包含需要被删除的特定知识(如版权书籍《哈利·波特》、特定用户的PII数据)。

- 保留集(Retain Set, ):用于维持模型语言能力和逻辑推理能力的通用语料(如Wikipedia样本、通用对话数据)。

在微软研究院的Who's Harry Potter?实验中,研究人员不仅使用了原著作为遗忘集,还构造了“通用预测标签”(Generic Prediction Labels)。例如,当模型输入“Who is Harry Potter?”时,目标不再是预测“wizard”,而是引导模型将其预测为“generic”内容(如“actor”或普通名词),以此切断特定实体与知识的关联。

2. 核心算法逻辑:反向更新权重

标准的模型训练是梯度下降(最小化损失),而遗忘过程则是梯度上升(最大化特定数据的损失)。然而,单纯的梯度上升会导致模型参数发散,造成“灾难性遗忘”(Catastrophic Forgetting),即模型变成胡言乱语。

因此,工业界通用的做法是采用混合损失函数(Combined Loss Function)。我们在最大化遗忘集损失的同时,必须最小化保留集的损失或约束参数偏移。

以下是一个基于 PyTorch 的简化实现逻辑,展示了如何在训练循环中通过加权损失实现这一平衡:

import torch

from torch.nn import functional as F

def computeunlearningloss(model, batchforget, batchretain, method="gakl"):

"""

计算遗忘损失函数

batchforget: 包含 inputids 和 labels 的遗忘集数据

batchretain: 包含 inputids 和 labels 的保留集数据

"""

# 1. 前向传播:计算遗忘集的 Loss

outputsforget = model(inputids=batchforget['inputids'], labels=batchforget['labels'])

lossforget = outputsforget.loss # 通常是 CrossEntropyLoss

# 2. 前向传播:计算保留集的 Loss (用于维持通用能力)

outputsretain = model(inputids=batchretain['inputids'], labels=batchretain['labels'])

lossretain = outputsretain.loss

# 3. 定义优化目标

if method == "gradientascent":

# 朴素梯度上升:极不稳定,容易破坏模型

totalloss = -lossforget

elif method == "gaplusdescent":

# 梯度上升 + 梯度下降:在遗忘特定数据的同时,强化通用数据

# alpha 是超参数,控制遗忘力度

alpha = 0.1

totalloss = -lossforget + alpha * lossretain

elif method == "gakl":

# 推荐:梯度上升 + KL散度约束

# 约束模型分布不要偏离原始模型(Ref Model)太远

with torch.nograd():

refoutputs = refmodel(batchretain['inputids'])

probscurrent = F.logsoftmax(outputsretain.logits, dim=-1)

probsref = F.softmax(refoutputs.logits, dim=-1)

losskl = F.kldiv(probscurrent, probsref, reduction='batchmean')

totalloss = -lossforget + losskl

return totalloss

# 伪代码训练循环

optimizer.zerograd()

loss = computeunlearningloss(model, batchforget, batchretain, method="gakl")

loss.backward()

optimizer.step()3. 关键工程细节与避坑指南

在实际部署类似 Unlearning_LLM 或 GNM 等开源方案时,工程师需要注意以下几点:

- 学习率(Learning Rate)极其敏感:遗忘过程的学习率通常需要比微调时更小(如 或更低)。过大的学习率会瞬间破坏模型的语法结构。

- 梯度累积(Gradient Accumulation):由于遗忘集通常较小,为了获得稳定的梯度估计,建议使用较大的梯度累积步数。例如在处理Llama-7b级别模型时,Batch Size虽小,但累积步数可设为16或32。

- 早停机制(Early Stopping):遗忘不像训练那样Loss越低越好。需要监控两个指标:遗忘准确率(应下降)和保留准确率(应保持)。一旦保留集的性能开始显著下滑,应立即停止训练。

- Token对齐问题:如Who's Harry Potter?论文所述,不同Tokenizer对同一单词(如 "Harry" 前是否有空格)的处理不同,这可能导致遗忘目标定位失败。在预处理数据时,必须确保Target Token与模型词表中的Token严格匹配。

通过上述流程,我们实际上是在模型的参数空间内执行一次“微创手术”:切除特定神经回路的激活权重,同时利用保留集作为“缝合线”,确保周围的知识结构不崩塌。

数据准备:构建Forget Set与Retain Set

在实施大模型“遗忘”操作之前,最关键的工程步骤并非调整学习率,而是构建高质量的数据集。许多工程师在初次尝试时会犯一个典型错误:仅使用目标删除数据(Forget Set)进行反向训练(Gradient Ascent)。这种“只破不立”的做法极易导致灾难性遗忘(Catastrophic Forgetting)——模型不仅忘记了指定信息,还破坏了基本的语言能力,导致输出乱码或逻辑崩溃。

为了在“精准切除”记忆的同时保护模型的通用能力,我们需要准备两类数据:

1. 构建 Forget Set(遗忘集)

这是需要从模型权重中抹除的特定数据。根据实际业务场景,Forget Set 通常有两种形式:

- 原始语料片段:针对版权合规场景(如“删除所有《哈利·波特》相关内容”),直接使用模型训练时对应的原始文本块(Chunks)。

- 特定问答对(QA Pairs):针对隐私或虚假信息场景。例如在 TOFU (Task of Fictitious Unlearning) 基准测试中,研究人员构建了关于虚构作者的合成问答数据集,旨在让模型遗忘特定个体的传记细节,而不影响对其他实体或通用事实的认知。

2. 构建 Retain Set(保留集)

Retain Set 的作用是充当“锚点”,通过在损失函数中引入 KL 散度约束或常规语言建模损失,强制模型在非目标区域保持参数稳定。构建 Retain Set 通常采用以下策略:

- 通用分布采样:选取与预训练数据分布一致的通用语料(如 Wikipedia 或 BookCorpus 的子集)。这能有效防止模型在更新权重时破坏基础语法和逻辑能力。

- 近邻对抗样本:这是更高阶的工程技巧。如果目的是让模型忘记“哈利·波特”,Retain Set 不应仅仅是新闻语料,还应包含《指环王》或通用奇幻小说。这样做能强迫模型在梯度更新时学会区分“特定的哈利·波特知识”与“通用的奇幻文学概念”,从而实现更精准的遗忘。

实例推演:以“哈利·波特”移除实验为例

在 NeurIPS 2024 的相关研究中,为了验证遗忘算法的有效性,研究团队采用了如下数据配置:

- Forget Set ():直接使用《哈利·波特与魔法石》的原始文本。目标是让模型在被问及相关情节时,表现得像从未读过这本书一样。

- Retain Set ():使用 BookCorpus 数据集作为通用基准。由于 BookCorpus 同样是书籍文本,其格式与 Forget Set 相似,能最大程度减少因数据格式差异带来的干扰,确保模型仅针对内容知识进行遗忘,而非由于文本风格变化导致参数漂移。

在实际工程落地中,Retain Set 的大小通常不需要与全量预训练数据一致,一般选取 Forget Set 的 10% 到 100% 规模即可起到显著的正则化效果,从而在计算成本与模型稳定性之间取得平衡。

核心代码逻辑:反向梯度更新与KL散度约束

在构建好 Forget Set(遗忘集)与 Retain Set(保留集)后,技术实现的核心在于设计一个能够同时满足“遗忘”与“保护”双重目标的损失函数。与常规微调(Fine-tuning)旨在最小化预测误差不同,机器遗忘(Machine Unlearning)通常采用 梯度上升(Gradient Ascent) 策略来最大化模型在特定数据上的熵,同时利用 KL 散度(Kullback-Leibler Divergence) 约束模型在通用知识上的分布不发生剧烈漂移。

损失函数设计原理

为了在 PyTorch 等框架中利用标准的优化器(如 AdamW)进行反向传播,我们需要构造一个标量损失值 total_loss,使其在最小化过程中实现以下逻辑:

- 遗忘项(Gradient Ascent): 我们希望模型在 Forget Set 上的预测变得“糟糕”(即由该数据产生的 Loss 变大)。在代码中,这通常表现为最小化负的 CrossEntropy Loss。

- 保留项(KL Divergence): 我们希望模型在 Retain Set 上的表现与未遗忘前的原始模型(Reference Model)尽可能一致。

公式可抽象为:

$$ \mathcal{L}{total} = -\mathcal{L}{forget} + \beta \cdot \mathcal{L}_{retain} $$

其中 是一个超参数,用于平衡遗忘强度与模型稳定性。

PyTorch 实现代码示例

以下代码展示了一个典型的遗忘训练循环(Unlearning Loop)。为了防止模型崩溃(Model Collapse),我们引入了一个冻结参数的 ref_model 作为锚点。

import torch

import torch.nn.functional as F

from torch.optim import AdamW

def computeunlearningloss(model, refmodel, batchforget, batchretain, beta=0.1):

"""

计算机器遗忘的混合损失函数

model: 当前正在进行遗忘训练的模型 (requiresgrad=True)

refmodel: 原始模型副本,参数冻结 (requiresgrad=False)

batchforget: 包含需要遗忘数据的 inputids 和 labels

batchretain: 包含需要保留数据的 inputids

beta: KL 散度项的权重系数

"""

# 1. 计算 Forget Set 的损失 (我们希望最大化这个损失)

# 使用标准的 Causal Language Modeling Loss (CrossEntropy)

outputsforget = model(

inputids=batchforget['inputids'],

labels=batchforget['labels']

)

lossforget = outputsforget.loss # 这是一个正数标量

# 2. 计算 Retain Set 的 KL 散度约束

# 目的:让当前模型在通用数据上的输出分布,尽可能接近原始模型

with torch.nograd():

refoutputs = refmodel(inputids=batchretain['inputids'])

reflogits = refoutputs.logits

outputsretain = model(inputids=batchretain['inputids'])

currentlogits = outputsretain.logits

# 使用 logsoftmax 和 softmax 计算 KL Div

# 注意:F.kldiv 默认期望 logtarget=False (target 是概率分布而非 log 概率)

# 但为了数值稳定性,通常输入 logsoftmax 后的值

lossretain = F.kldiv(

F.logsoftmax(currentlogits, dim=-1),

F.softmax(reflogits, dim=-1),

reduction='batchmean'

)

# 3. 组合总损失

# 这里的关键是负号:最小化 (-lossforget) 等同于最大化 lossforget (梯度上升)

totalloss = -lossforget + beta * lossretain

return totalloss

# 训练循环伪代码

# model = ... (加载目标模型)

# refmodel = ... (加载原始模型并执行 refmodel.eval())

# optimizer = AdamW(model.parameters(), lr=1e-5) # 注意:学习率通常比微调要小

# for step, (batchf, batchr) in enumerate(dataloader):

# optimizer.zerograd()

# loss = computeunlearningloss(model, refmodel, batchf, batchr)

# loss.backward()

# optimizer.step()关键细节与工程陷阱

- KL 散度的锚定作用:

代码中ref_model的存在至关重要。如果没有这一项约束(即 ),单纯的梯度上升会导致模型参数迅速发散,使得模型不仅忘记了目标数据,还会丧失语言生成能力,开始输出乱码。这在学术界被称为“灾难性遗忘”或“模型崩溃”。通过计算 Retain Set 上的 KL 散度,我们强迫模型在修改参数时,必须保留对通用语言模式的认知。 - 学习率(Learning Rate)的选择:

在执行“破坏性”更新(如梯度上升)时,模型参数极其敏感。工程实践建议使用比常规 SFT(Supervised Fine-tuning)更小的学习率(例如1e-5或5e-6)。过大的学习率会瞬间破坏 Transformer 的注意力机制权重,导致模型不可逆的损坏。 - 梯度裁剪(Gradient Clipping):

由于我们是在最大化损失,梯度的模长可能会变得非常大。在optimizer.step()之前加入torch.nn.utils.clipgradnorm(model.parameters(), maxnorm=1.0)是防止数值不稳定的标准操作。

通过这种“在保留区锚定,在遗忘区推离”的机制,我们可以在数学层面实现对特定数据痕迹的擦除,而无需重新训练整个大模型。正如 LLM unlearning via loss adjustment 等研究所指出的,这种基于损失调整的方法在效率上远优于重新训练,是当前工业界落地“遗忘权”的主流路径。

评估指标:如何证明模型真的“忘记”了?

在传统的数据库操作中,DELETE 命令执行后,数据即物理消失。但在神经网络中,数据以权重的形式分布存储,这使得验证“遗忘”成为一个高度复杂的统计学问题。仅仅依靠模型不再输出特定句子是不够的,我们需要引入一套双重评估框架(Dual-Metric Framework),在验证有效性(Efficacy)的同时,确保模型的通用能力(Utility)未受损。

1. 有效性指标:验证“遗忘”的深度 (Efficacy)

有效性评估的核心在于证明模型在面对被删除数据(Forget Set)时,其表现退化到了“未训练”或“随机猜测”的状态。

- 逐字记忆消除 (Verbatim Memorization):

这是最直观的测试。对于训练数据中的文本片段(如版权书籍),我们输入前缀(Prefix),观察模型续写的内容。如果模型能够逐字还原后续文本,说明遗忘失败。 - 指标:使用 ROUGE-L 或 BLEU 分数计算模型生成内容与原始训练数据的重合度。理想情况下,该分数应在遗忘后显著下降。

- 案例:在 NeurIPS 2024 关于大模型遗忘的研究 中,研究人员使用《哈利·波特》作为测试集。原始模型在接收到 "Harry lit a lamp..." 的提示时能精准续写原文;而经过梯度上升(Gradient Ascent)处理后的模型,输出变成了 "I can't assist it" 或无关的乱码,证明了逐字记忆的消除。

- 知识记忆消除 (Knowledge Memorization):

模型可能不再背诵原文,但依然保留了其中的知识点(例如知道“哈利·波特是在霍格沃茨上学”)。 - 测试方法:构建针对 Forget Set 的 QA 问答集。

- 指标:准确率(Accuracy)。在理想的遗忘状态下,模型对相关问题的回答准确率应接近随机水平,或者拒绝回答。

- 成员推断攻击 (Membership Inference Attack, MIA):

这是从安全合规角度的“金标准”。攻击者试图通过模型的输出分布(Logits),判断某条特定数据是否曾存在于训练集中。 - 评估:计算攻击成功率(Attack Success Rate)。如果攻击者无法以高于随机猜测(50%)的概率区分 Forget Set 和从未见过的数据(Holdout Set),则可认为实现了隐私层面的遗忘。OpenUnlearning 框架 目前已集成了 LOSS、ZLib 和 MinK 等多种 MIA 攻击算法,用于量化这种隐私泄漏风险。

2. 局限性与通用能力:防止“灾难性遗忘” (Locality & Utility)

遗忘算法最常见的副作用是“模型脑损伤”——为了删除 1% 的数据,导致整个模型的语言能力或逻辑能力崩溃。因此,必须监控以下指标:

- 保留集稳定性 (Retain Set Accuracy):

Retain Set 通常包含与 Forget Set 分布相似但需要保留的数据(例如,删除了《哈利·波特》,但需保留《指环王》)。 - 指标:计算模型在 Retain Set 上的困惑度(Perplexity)或 ROUGE 分数。该指标在遗忘前后应保持由KL 散度约束的微小波动,不应出现大幅下降。

- 通用基准测试 (General Benchmarks):

为了确保模型没有丧失基础的推理和语言能力,必须在标准榜单上进行回归测试。 - 指标:MMLU(大规模多任务语言理解)或 C-Eval。如果一个遗忘算法导致 MMLU 分数暴跌 10% 以上,该算法在工程上是不可用的。

- 参考数据:根据 ICLR 2025 的 TOFU 基准测试研究,优秀的遗忘算法(如结合了 KL 约束的方法)能够将“模型效用(Model Utility)”的损失控制在极低范围(例如 0% - 5%),而粗暴的梯度上升方法可能导致效用损失高达 17% 以上。

3. 综合评估基准 (Benchmarks)

为了标准化这一流程,学术界和工业界正在形成共识性的测试集:

- TOFU (Task of Fictitious Unlearning):这是一个专门设计的合成数据集,包含虚构作者的传记和问答。它允许工程师精确测量“删除了多少虚构事实”以及“保留了多少真实世界知识”,通过计算 Forget Quality Gap(遗忘质量差距)来量化算法优劣。

- MUSE (Machine Unlearning Six-Way Evaluation):提供了更细粒度的分类,区分“逐字记忆”与“知识记忆”,并引入了针对新闻数据的测试场景,帮助开发者在非虚构类数据上验证遗忘效果。

综上所述,一个成功的遗忘操作必须在雷达图上呈现出特定的形状:在 Forget Set 轴上得分极低(接近随机),而在 Retain Set 和 General Task 轴上与原始模型几乎重合。

当前局限与工程建议

在将“机器遗忘”(Machine Unlearning)从学术论文转化为生产环境的落地功能时,工程师必须直面一个核心矛盾:效率与确定性的权衡。虽然全量重新训练(Retraining from Scratch)被视为实现“遗忘”的黄金标准,能从数学上保证数据不再存在于模型分布中,但其高昂的算力和时间成本在实际业务中往往不可接受。

1. 技术局限:概率性擦除与“知识残留”

目前的近似遗忘算法(Approximate Unlearning)本质上是概率性的。与传统的数据库 DELETE 操作不同,在神经网络中执行梯度上升(Gradient Ascent)或偏好优化,并不能保证该数据的痕迹被物理清除。

- 数学保证的缺失:大多数高效算法(如 GA、NPO)只能使模型在特定提示词下的输出不再包含目标信息,但无法证明模型参数 与从未见过该数据的模型参数 在分布上完全一致。这种差异意味着攻击者可能通过精心设计的对抗性攻击(Adversarial Attacks)或成员推理攻击(MIA)恢复出被“删除”的信息。

- 知识残留(Knowledge Trace):这是最棘手的工程问题。即使模型不再能背诵某篇具体的受版权保护文章,它在训练过程中习得的句法结构、逻辑关联或特定领域的词汇分布可能仍然保留。例如,删除“哈利·波特”的实体概念比较容易,但要完全剥离该语料对模型“魔法世界观”构建的隐性贡献则极其困难。

2. 面向工程师的实战建议

针对上述局限,在设计企业级大模型数据合规系统时,建议采取以下工程策略:

优先采用参数高效微调(PEFT)进行遗忘

不要直接修改基础模型的全量权重。建议基于 LoRA (Low-Rank Adaptation) 构建遗忘流程。

- 优势:通过为特定的遗忘请求(或一批请求)训练一个负向的 LoRA Adapter,可以在不破坏基座模型通用能力的前提下实现定向遗忘。如果遗忘效果导致模型能力崩塌,只需卸载该 Adapter 即可,无需回滚整个模型。

- 资源:学术界已证明 Parameter-Efficient Unlearning 在单卡 GPU 上即可高效运行,显著降低了实施成本。

建立严格的版本控制与“遗忘前”快照

“灾难性遗忘”(Catastrophic Forgetting)是遗忘算法最大的副作用——模型在试图忘掉一条数据的同时,往往会破坏其通用推理能力或语言流畅度。

- 工程规范:在执行任何反向传播操作前,必须对当前模型权重进行版本固化。

- 评估流水线:建立自动化测试集,不仅要检测目标数据是否被遗忘(如困惑度上升),更要通过 MMLU 等基准测试监控通用能力的下降幅度。只有当通用能力损失在阈值(如 <2%)以内时,才允许发布新版本。

管理预期:区分“物理删除”与“去记忆化”

在与法务部门或客户沟通时,必须明确技术术语的边界。

- Unlearning vs. Unmemorization:对于版权合规场景,目标通常是防止模型“逐字反刍”训练数据。此时可以使用类似 Microsoft Obliviate 的方法,专注于消除逐字记忆(Verbatim Memorization),而非承诺模型完全未受过该数据的影响。

- 合规话术:建议将服务条款(SLA)定义为“尽最大努力的概率性屏蔽”,而非“绝对的物理删除”,以规避技术不可行带来的法律风险。