在全网为“赛博分身”狂欢的表象之下,OpenClaw的现象级爆发实则是一场由底层商业逻辑深度驱动的算力消费革命。当国内基础设施建设狂飙突进,导致大厂过剩算力无处安放、模型推理需求迟迟无法在C端找到高频落地场景时,这款极客形态的AI框架精准切中了产业链的致命痛点,成为一场完美的算力去库存运动。与传统即用即走、无状态的对话机器人截然不同,独特的OpenClaw架构要求其必须作为独立的守护进程在沙箱环境中7×24小时全天候运行。这种严苛的持续在线机制,直接引爆了数据中心里原本大量滞销的低配轻量服务器租赁需求,将短期的流量红利转化为长期的基础设施订阅。与此同时,在众多开发者的真实评测中可以清晰看到,自主Agent在执行复杂自动化任务时,需要不断进行内部循环与自我纠错,这种机制使其化身为无情的“Token粉碎机”,导致单次任务的Token消耗量动辄激增近千倍。这种指数级暴涨的API隐藏成本,不仅让普通用户在不知不觉中承担了高昂的OpenClaw成本,更将原本偶发的尝鲜式交互,彻底转化为持续、高并发的AI Agent算力消耗基本盘。通过将庞大的闲置算力与C端用户的极客热情深度绑定,OpenClaw成功打通了从底层硬件租赁到顶层模型推理接口的变现闭环,最终实现了云厂商收益与模型大厂商业利益的全面最大化。它不仅重塑了人工智能的落地形态,更是资本与技术合谋下,为消化庞大沉没成本而精心打造的终极商业引擎。

核心揭秘:为什么OpenClaw成了大厂算力“去库存”的最优解?

抛开全网铺天盖地的“保姆级教程”与营销泡沫,OpenClaw的爆火绝非偶然。从底层商业逻辑来看,OpenClaw本质上是一个将B端算力焦虑转化为C端消费狂欢的完美商业模型。它不仅是一款极客形态的Agent框架,更是用户的“算力黑洞”,以及云厂商和模型厂商期盼已久的“库存救星”。

在这场狂欢中,“为什么偏偏是OpenClaw?”的答案异常清晰:它提供了极其稳定的C端消耗场景。与传统无状态、即用即走的Chatbot对话不同,OpenClaw作为需要环境沙箱的守护进程,将AI算力的消耗模式直接转变为全天候的持续运行。这种7×24小时永远在线的底层机制,精准切中了当前基础设施大规模闲置的痛点。

接下来的内容将深入剖析大厂当前面临的算力过剩困局,并精确拆解OpenClaw究竟是如何通过其独特的架构与运行机制,为这批庞大的闲置资源提供最优的“去库存”通路的。

算力过剩的困局与C端场景的缺失

国内云厂商与AI大厂在过去两年间投入巨资构建底层基础设施(如华为昇腾智算集群),但随之而来的并非持续的商业正循环,而是供需错配的尴尬局面。这种错配在产业链条上衍生出了两个亟待解决的核心问题:

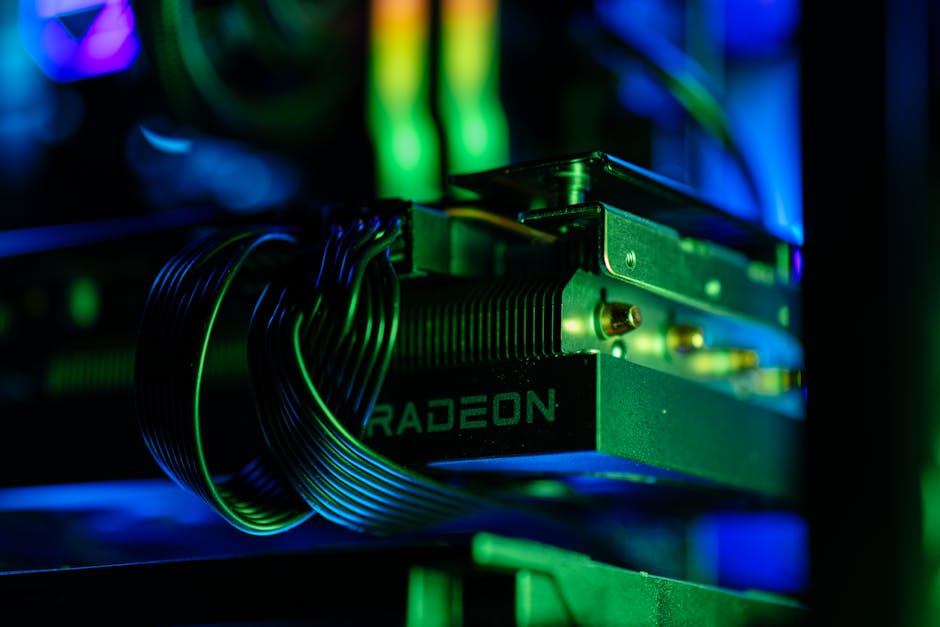

首先是云厂商的硬件“去库存”压力。在大模型训练需求趋于稳定后,推理侧的需求并未如期爆发。中小企业上云及自建AI应用的意愿不及预期,导致大量低配的轻量应用服务器被闲置在数据中心,成为难以变现的沉没成本。其次是模型厂商面临的Token消耗断层。国内头部大模型厂商(如Kimi、智谱、Minimax等)空有强大的API并发能力,却迟迟找不到高频、持续的C端落地场景。传统的Chatbot(对话机器人)应用往往陷入“尝鲜下载、按周卸载”的窘境,偶尔的对话请求根本无法形成稳定的算力消耗。

在这种背景下,OpenClaw作为催化剂横空出世,其本质上是一个完美的“算力黑洞”。

要理解它的消耗能力,可以将其视作在云端“养电子宠物”。与传统大模型无状态的网页问答不同,OpenClaw是一个全双工、有状态的守护进程。为了让这个“赛博员工”能够7×24小时监听飞书、微信或钉钉的消息接口并执行自动化任务,它必须运行在独立的Docker沙箱环境中。一旦用户的本地电脑关机,Agent就会断线失联。这种严苛的在线要求,直接迫使大量C端用户转向租赁云服务器。更致命的是,自主Agent在执行复杂任务时需要不断进行内部循环(Loop)与自我纠错,单次任务与模型的交互次数动辄数十上百次,导致Token消耗量激增了约1000倍,堪称无情的“Token粉碎机”。

这场由C端狂欢引发的算力消耗战,最终清晰地指向了产业链背后的受益者:

- 云厂商(基础设施层): 商业逻辑从单纯的算力租赁,跃升为“Agent数字员工的工位提供商”。通过推出预装OpenClaw镜像的“一键部署”服务,不仅瞬间清空了轻量服务器的库存,还成功将短期的流量红利转化为长期的SaaS订阅化留存。

- 模型大厂(API供给层): 终于迎来了稳定的C端消耗场景。借由开源社区的极客力量,模型厂商无需自己开发复杂的端侧应用,只需让用户将API Key接入OpenClaw,就能坐享指数级增长的推理计费收入。

精简总结:OpenClaw如何完美消化闲置算力

OpenClaw之所以能成为大厂算力“去库存”的最优解,核心在于其独特的运行机制从以下三个维度重塑了算力消费模式:

- 全天候在线拉动轻量级服务器租赁:作为有状态的守护进程,OpenClaw必须7×24小时驻留运行,直接引爆了原本滞销的低配轻量应用服务器需求。例如,腾讯云推出一键部署服务后,一度出现数百人排队“白嫖”部署的盛况,本质上是在为底层资源租赁蓄水。

- 自主Agent循环(Loop)吞噬海量API Token:与传统Chatbot的单次请求不同,自主Agent在执行复杂任务时需要与大模型进行数十乃至上百次的循环交互。这种机制使其成为名副其实的“Token粉碎机”,导致单次任务的Token消耗量激增近千倍。

- 为闲置AI推理算力提供稳定C端场景:国内模型厂商空有庞大的推理算力池,却长期缺乏高频且持久的C端应用入口。OpenClaw的爆发完美填补了这一空白,将用户偶发的对话尝鲜,转化为全天候、高并发的稳定算力消耗基本盘。

真实评测:运行一个OpenClaw到底要烧多少钱?

铺天盖地的教程都在强调 OpenClaw 是一个“免费开源”的超级智能体,只需一键部署即可拥有全天候的赛博助理。然而,在真实的工程实践中,开源软件的“免费”仅仅意味着你不需要为代码本身支付授权费。一旦让这个 Agent 真正 7×24 小时跑起来,其底层持续不断的算力消耗就会立刻转化为真金白银的流水账单。

为了探究运行 OpenClaw 的真实开销,我们脱离了理想化的理论推算,在真实的生产环境中进行了一次严谨的实测。我们的测试环境模拟了大多数开发者的标准起步配置:

- 基础设施:一台主流云厂商的入门级轻量应用服务器(VPS),用于维持 Agent 的全天候在线与网络连通。

- 核心大脑:接入当前主流的头部大模型 API(涵盖顶级前沿模型与平价替代方案),以支撑复杂的代码级推理与高频工具调用。

- 运行状态:开启标准的无人值守模式,配置典型的心跳机制(Heartbeat)与基础的定时监控任务。

接下来,我们将把宏观的“算力消耗”具象化为个人用户的真实账单。下文将从两个维度进行深度拆解:一是服务器租赁端的显性成本与大厂营销策略,二是常常在睡梦中将账户余额抽干的 API Token 消耗黑洞。我们将通过第一手的数据日志,为你彻底揭开“免费部署”背后的真实财务门槛。

轻量服务器的显性成本与大厂的“免费”陷阱

最近各大技术社区充斥着“零门槛免费部署 OpenClaw”的教程,这背后离不开云厂商的推波助澜。为什么阿里云、腾讯云等头部大厂愿意提供极低价格甚至“首月免费”的轻量应用服务器供普通用户折腾?这绝非做慈善。从宏观商业逻辑来看,这其实是云厂商在借用现象级 B2C 应用来消化过剩的 B2B 算力库存。OpenClaw 作为一个需要 7×24 小时保持心跳(Heartbeat)运行的 AI Agent,完美填补了 C 端用户对常驻服务器的场景空白。对于大厂而言,用一台闲置的低配轻量服务器换取一个深度绑定的高粘性活跃用户,这笔拉新买卖极其划算。

然而,这种营销策略直接导致了大量跟风用户的严重挫败感。许多人被“一键免费安装”的噱头吸引入局,兴冲冲地部署了自己的“赛博分身”,却在次月收到了令人咋舌的续费账单。所谓的“免费开源”,往往只停留在软件授权层面。一旦脱离了首月的促销“蜜月期”,硬件租赁的显性成本就会立刻原形毕露,成为长期运行 OpenClaw 的第一道资金门槛。

我们不妨拆解一下市面上主流的“一键部署”套餐。在各大云厂商的专区,你很容易找到针对 OpenClaw 定制的轻量服务器(通常为 2核2G 或 2核4G 的基础配置):

- 首月促销价:通常包装得极具诱惑力,首月仅需 0 元至 9.9 元人民币,甚至附赠手把手的保姆级网络配置教程,制造出一种“几乎零成本”的假象。

- 长期续费原价:当促销期结束,这台入门级 VPS 的真实费用通常在 100至500元/年的常态区间。如果为了追求更稳定的海外网络环境或原生 API 连通性,选择海外节点(如 Azure VM 或 AWS EC2),每月的实际开销甚至会飙升至 23至70美元/月。

保持批判性视角来看,这种“低价拉新”的商业逻辑与早年互联网的“烧钱补贴”如出一辙。云厂商通过一键部署脚本降低了技术门槛,将 OpenClaw 包装成大众玩具,本质上是在向 C 端转移闲置的底层算力。作为硬核玩家或开发者,在入局前必须清醒意识到:只要你的 Agent 还在不间断地轮询、监控或执行定时任务,这台服务器的租金就是一项必须长期支付的“基础设施税”。不要被短期的免费流量蒙蔽,提前计算好按年续费的 TCO(总所有成本),才是决定是否让 OpenClaw 长期接管你数字生活的关键。

隐藏的API Token消耗黑洞(附24小时实测数据)

传统大模型对话是“按需触发”(问了才答),而 OpenClaw 的底层逻辑是基于心跳机制(Heartbeat)的“主动轮询”。这意味着它在 7×24 小时的生命周期内,会不断执行“唤醒 → 读取上下文 → 推理判断 → 调用工具 → 休眠”的循环。每一次唤醒,它都需要将庞大的系统提示词和历史上下文重新发送给 API,这使其成为一个名副其实的 Token 焚钞炉。

为了量化真实的成本,我们在主流云服务器上部署了 OpenClaw,并记录了其 24 小时运行的 Token 消耗日志。测试环境设定为:开启每 15 分钟一次的系统级监控心跳,并下发了两个中等复杂度的自动化任务(如检查 Nginx 配置并分析日志)。模型选择当前在 Agent 场景下性价比最均衡的 Claude 3.5 Sonnet(输入 15/1M Tokens)。

OpenClaw 24小时 Token 消耗实测表

时间段 | 触发机制 / 典型任务 | API 调用次数 | 消耗 Token (输入/输出) | 预估费用 (USD) |

|---|---|---|---|---|

09:00 - 18:00 | 日常心跳监控 + 2次代码库检索 | 42 次 | 1.2M / 150K | ~$5.85 |

18:00 - 23:00 | 触发自动修复 Nginx 依赖任务 | 85 次 | 2.5M / 400K | ~$13.50 |

23:00 - 08:00 | 夜间静默心跳(每15分钟唤醒) | 36 次 | 800K / 50K | ~$3.15 |

凌晨 02:15 | 异常:Agent 陷入死循环重试 | 120 次 | 4.5M / 600K | ~$22.50 |

总计 | 24小时全天候运行 | 283 次 | 9M / 1.2M | ~$45.00 |

(注:若按此频率满载运行,单月 API 账单将轻松突破 $1,300,约合人民币 9,000 元以上。)

仔细观察数据可以发现,夜间突发的 $22.50 消费是账单失控的核心原因。这是无人值守 Agent 最致命的黑洞:逻辑死循环。

当 OpenClaw 在夜间执行某项自动化脚本时,如果遇到无法解析的报错或缺失的系统依赖,它不会像人类开发者那样停下来思考,而是会不断尝试更换参数并重新调用工具。以下是截取的真实运行日志节点:

[02:15:22] ERROR: Nginx SSL configuration missing or invalid.

[02:15:25] ACTION: Attempting to rewrite nginx.conf (Attempt 1)

[02:15:30] ERROR: Permission denied. Sandbox restrictions apply.

[02:15:33] ACTION: Attempting to rewrite nginx.conf with sudo (Attempt 2)

...

[02:25:10] WARN: Rate limit exceeded. 120 API calls made in 10 minutes.在短短 10 分钟内,Agent 因为无法正确处理权限问题陷入了“报错 → 携带完整报错日志重新请求 → 再次报错”的死循环。庞大的上下文窗口在每一次重试中被反复发送给 API 发行方,Token 消耗呈指数级暴涨。在这种情况下,一晚上烧掉 50 美元绝非危言耸听。

针对这种隐藏账单,开发者在实操中极易踩中两个致命陷阱:

- “便宜模型更省钱”的错觉:很多用户试图通过切换到 GPT-4o-mini 等廉价模型(输入单价仅 $0.15/1M)来降低成本。但实测表明,廉价模型在处理复杂 TypeScript 项目或环境配置时极易失败。它不仅无法一次性解决问题,反而会因为低效的推理引发更多的报错重试,最终消耗掉的 Token 费用甚至比直接使用 GPT-4o 或 Opus 还要高。

- 未设硬性熔断导致欠费停机:这是导致“一觉醒来房子归云厂商”的最常见错误。正确的工程实践必须是“两头锁”:一方面在 OpenClaw 的配置文件中设置严格的日消费限额(

maxdailybudget),另一方面,必须在 OpenAI 或 Anthropic 的开发者控制台中设置账户级别的 Hard Limit(硬性消费上限),从物理层面上切断死循环带来的无底洞消耗。

技术剖析:OpenClaw架构为何如此“耗能”?

要理解大厂为何视 OpenClaw 为消耗过剩算力的完美“焚钞炉”,首先需要剥离其“赛博分身”的科幻外衣,回归到底层工程架构。与传统的开源 Agent 或单次大模型对话系统相比,OpenClaw 的算力消耗之所以呈现指数级跃升,根本原因在于其将“被动式文本生成”转化为了“主动式环境交互”。

在核心运行机制上,OpenClaw 并非简单地调用 API 返回一段代码或文本,它本质上是一个高度复杂的事件驱动的状态机。当系统接收到一个看似简单的自然语言指令时,它会立刻进入一个高频运转的闭环控制流。这个控制流主要由三个核心环节构成:

- 视觉识别(感知): 智能体首先需要获取当前操作系统的屏幕截图或 UI 结构,将其转化为多模态 Token,以此“看懂”当前所处的环境状态。

- 动作执行(决策与操作): 基于感知到的环境上下文,底层模型规划出下一步的微观动作(如移动鼠标到特定坐标、点击某个具体的按钮或输入一段文本),并调用系统的原子级工具(如 Read、Write、Bash)去执行。

- 状态验证(反馈): 动作执行完毕后,系统必须再次截屏或读取日志,将新的状态回传给大模型,以验证上一步操作是否成功,若遇到报错则触发下一轮的自我修正。

这种“感知-执行-验证”的闭环意味着,人类眼中的一个连贯动作,在 OpenClaw 的底层架构中会被拆解为无数个微观节点,而每一个节点都在无情地消耗着算力。接下来的两节中,我们将详细拆解这种自主运行架构与传统 Chatbot 在调用链路上的降维差异,并深入透视其多模态上下文记忆机制究竟是如何吞噬海量 Token 的。

传统Chatbot与自主Agent的调用链路对比

要理解OpenClaw为何被称为算力“焚钞炉”,首先需要厘清一问一答的传统Chatbot与自主运行的Agent在Token消耗链路上存在的本质差异。传统大模型对话遵循“请求-响应”的线性逻辑,算力消耗是按次计算的单点开销;而OpenClaw这类Agent则运行在“思考-行动-观察”(ReAct)的闭环中,算力消耗彻底演变成了持续不断的“数据流”。

为了直观展示Agent架构在算力消耗上的“降维打击”,我们可以从以下三个核心维度进行对比:

维度 | 传统 Chatbot | 自主 Agent (如 OpenClaw) |

|---|---|---|

触发机制 | 依赖人类输入(被动单次触发) | 自主轮询与事件驱动(守护进程持续监听与主动触发) |

上下文长度 | 仅包含当前对话,长度可控且增长缓慢 | 持续累积的屏幕快照、执行日志与状态反馈,极易发生无限膨胀 |

并发与调用链路 | 单次交互通常对应 1 次 API 调用 | 级联触发,单一任务极易产生数十至上百次高频 API 调用 |

抛开晦涩的底层源码,我们可以用一个日常场景来量化这种算力鸿沟:点一次外卖。

如果使用传统Chatbot,你输入“帮我点一份轻食”,模型直接输出一段推荐文本或生成一段点餐文案,整个过程只消耗几百个Token,仅调用一次API。

但如果把同样的任务交给OpenClaw,调用链路将发生剧变:它首先需要截取当前屏幕(消耗大量多模态视觉Token),识别外卖软件的图标位置;接着计划并执行“移动鼠标”、“双击图标”的操作(产生独立的动作API调用);随后截取新界面,读取菜单并思考选择哪家店铺(再次完整调用LLM);最后执行滑动、点击下单、确认支付等一系列动作。为了完成这一个目标,OpenClaw实际上在后台执行了数十次完整的LLM推理。

这种高昂的算力代价来源于Agent的底层状态机设计。在Agent的执行链路中,每一个微小动作都需要经历完整的验证环节。例如,在执行“帮我退订所有营销邮件”这样看似简单的指令时,Agent需要经历读取邮件列表、思考判定、调用退订接口、验证结果的完整循环。如果遇到UI变更或点击无效,Agent还会触发多轮自我修正机制(报错→修改→再执行)。

最致命的是,每一次重试或下一步行动,Agent都必须背负着前面所有操作的屏幕快照和历史记录发起请求。这也是为什么在真实业务场景中,一个活跃会话的上下文会迅速飙升至20万Token以上。在这一架构下,Token的消耗逻辑发生了根本性的结构改变——从“按次计费”突变为了“按带宽与时长计费”,直接将闲置的算力池抽干。

持续轮询与多模态上下文的算力代价

OpenClaw 之所以被称为算力“焚钞炉”,其核心原因在于它打破了传统应用“按需调用”的克制,转而采用了一种极其重度的轮询机制。在这种机制下,API 调用的激增不仅体现在频次上,更致命的是单次调用所携带的 Token 负载量呈指数级爆炸。

从技术实现来看,OpenClaw 的运行高度依赖多模态视觉输入与全局状态记忆。为了确认当前系统的真实状态,Agent 需要高频截取屏幕快照(Screen Capture)。一张高分辨率的屏幕截图输入给多模态大模型,单次就会消耗数千个视觉 Token。更严峻的是上下文的无限膨胀(Context Bloat)问题:为了让 Agent “记住”之前的操作路径并进行多轮自我修正,每一次新的 API 调用都必须携带完整的历史执行日志和之前的视觉状态。据开发者实测,一个活跃会话的上下文窗口会迅速膨胀至20万 Token 以上。这就导致工具链的级联触发效应被急剧放大——即便只是处理一个“整理邮件”的简单任务,也可能触发 5 到 10 次包含海量历史上下文的完整推理。

探究其底层逻辑,这种设计实则是受限于当前操作系统 API 封闭性的一种妥协。由于大量第三方桌面软件和复杂网页并未提供标准化的 DOM 树或底层语义接口,OpenClaw 无法直接“读取”代码状态,只能退而求其次,像人类一样通过“看图”来理解 UI。它需要对像素级图像进行解析、识别按钮边界、计算 X/Y 坐标,最后再调用系统底层的鼠标或键盘事件。这种放弃精准的结构化数据解析,转而依赖大模型超强泛化能力的像素级交互,本质上是一种高算力代价的暴力美学。它用极高的推理成本,强行换取了跨应用、跨平台的通用性。

将这种架构特性折算为实际的账单,就能清晰地看到其对算力的恐怖吞噬力。当 Agent 陷入死循环或在验证操作结果时不断重试,Token 消耗会迅速演变成一个深不见底的黑洞。在实际的工程部署中,如果让 OpenClaw 7×24 小时全量运行并调用顶配大模型,其单月纯 API 调用成本即可高达 800 到 1500 美元。对于云厂商和大模型提供商而言,这种将闲置算力转化为持续、高频、大吞吐量 Token 消耗的底层设计,正是消化庞大推理集群冗余的最佳利器。

狂欢之后:算力去库存的长期可持续性存疑

OpenClaw 的爆火建立在一个高度特定的时间窗口之上:云厂商急需消化闲置的轻量级服务器库存,而普通用户对全天候运行的自主智能体充满着探索的新鲜感。然而,这种依赖“白菜价”服务器租赁和海量 API Token 轮询消耗的商业模式,对底层成本具有极高的敏感度。当大厂的低端算力库存被悉数清空、新客促销补贴停止,或是普通用户在收到第一份高昂的 API 账单后新鲜感褪去,当前这种“全民租服务器跑 Agent”的生态繁荣还能否维系?

将复杂的开源代码打包成 B2C 模式供个人用户折腾,注定只是云厂商算力去库存过程中的一种过渡形态。要看清 OpenClaw 乃至整个 AI Agent 市场的长期走向,我们需要跳出当下的热点炒作,基于商业收益最大化的逻辑进行推演。接下来的内容将分为两个维度:首先从宏观行业视角,剖析云厂商在低端库存耗尽后的下一步商业棋局与算力价格走势;随后从微观用户视角,为想要继续探索前沿技术但受限于资金预算的普通人,提供一套切实可行的成本控制与避坑指南。

当低端服务器库存耗尽时,云厂商的下一步棋

目前 OpenClaw 在个人用户端的狂欢,本质上建立在极其脆弱的成本结构之上——即云厂商为了清退低端轻量级服务器库存而提供的“白菜价”租赁,以及大模型厂商在价格战期间的 API 补贴。然而,商业逻辑的最终导向必然是收益最大化。随着这批闲置算力被逐渐消化,加上高端 GPU 芯片供应受限导致算力租赁端的成本压力不断向上游传导,这场由算力过剩引发的 C 端红利期注定会走向终结。

当轻量级服务器恢复标准定价,或者 API 接口的 Token 计费取消补贴时,OpenClaw 这种需要 24 小时高频轮询、极度依赖上下文记忆的 B2C 模式将面临严峻考验。对于普通用户而言,维持一个全天候在线的“赛博分身”,其隐藏的持续性账单将迅速超越其带来的新鲜感与实用价值。个人折腾开源代码、自行部署 Agent 的模式,最终会被证明只是一场由大厂出资赞助的“全民公测”与市场教育。

那么,当低端库存耗尽后,云厂商的下一步棋会怎么走?答案是收网与产品化升维。大厂并不会长期鼓励用户以极低的客单价去占用宝贵的公有云网络与计算资源。相反,他们会利用这波热潮中收集到的海量交互数据和 Agent 行为模式,将原本需要用户手动部署的复杂能力,直接封装进高溢价的商业产品中。

基于商业收益最大化的推演,云厂商未来的动作将呈现以下两大核心趋势:

- 从“卖散装算力”到“卖云电脑与高端 SaaS”:未来的 Agent 能力将作为增值服务(Add-on)被深度集成到企业级云办公套件或高端云端工作站中。用户不再需要去购买轻量级服务器并配置复杂的运行环境,而是直接订阅包含 AI 助手的标准化 SaaS 产品。这不仅能大幅提高客单价,还能将无序的算力消耗转化为可控、高毛利的商业闭环。

- 主战场向 B 端企业级市场与端侧转移:如行业观察指出,API调用只是企业使用AI最轻量的一种方式。真正庞大且可持续的算力消耗在于企业结合自身业务数据进行的后训练、微调以及私有化部署。资本市场近期的动向也印证了这一点,OpenClaw 概念爆火后,算力租赁板块及云服务商率先成为核心受益环节。随着 AI 算力从纯云端向边缘下沉,具备本地推理能力的 AI PC 和企业级 AI Box 将接棒低端云服务器,成为承载高可靠性、低延迟 Agent 任务的新基础设施。

个人用户的破局建议:如何低成本玩转AI Agent

OpenClaw 的全自动轮询机制虽然强大,但也极易成为吞噬 API 余额的“黑洞”。普通开发者想要在不破产的前提下体验前沿的 Agent 技术,不能仅凭一腔热血,而是必须建立严格的成本风控意识。以下是四条可以直接落地的实操建议:

- Step 1:物理隔绝风险 —— 务必设置 API 每日消费硬顶(Hard Limit)

Agent 在遇到复杂报错、接口超时或逻辑死胡同时,极易陷入无意义的“重试死循环”。如果直接接入按量付费的云端大模型,一晚上的代码死循环可能就会耗尽数月的预算。

实操建议: 登录你的模型供应商(如 OpenAI、Anthropic 或国内大厂)的 API 控制台,在计费(Billing)设置中,不仅要设置邮件提醒阈值(Soft Limit),更要强制设置停机阈值(Hard Limit)。建议个人在日常测试阶段,将硬顶严格限制在每日 2~5 美元(或 20~50 元人民币),一旦触发直接阻断后续的 API 请求。 - Step 2:算力端侧化 —— 探索本地量化小模型替代方案

并非所有的 Agent 任务都需要千亿参数的顶级闭源模型。正如行业趋势所示,AI 正在向边缘和终端下沉,OpenClaw 本质上支持本地优先与零云端依赖的部署模式。

实操建议: 对于文件整理、简单的日志分析或基础代码生成,完全可以通过 Ollama、LM Studio 等工具,在本地电脑上部署经过量化压缩(如 4-bit 或 8-bit)的开源小尺寸模型。将本地端侧模型作为日常任务的“主力军”,仅在处理高复杂度逻辑推理时才调用昂贵的云端大模型 API,通过这种“高低搭配”的路由策略大幅削减 Token 开销。 - Step 3:斩断无意义的轮询 —— 针对特定任务优化 Prompt

OpenClaw 这类智能体的基础架构依赖于持续的上下文读取与动作预测。模糊、宽泛的提示词(Prompt)会导致 Agent 无法准确判断任务是否完成,进而反复尝试调用错误的工具(Skills),白白燃烧计算资源。

实操建议: 在初始化 Agent 时,必须提供明确的边界条件与退出机制(Exit Condition)。例如,在系统提示词中硬性规定:“如果连续三次调用同一工具失败,请立即停止执行并向用户输出错误报告,绝对禁止自行重试。” 这种确定性的指令能有效阻断失控的 Token 消耗。 - Step 4:避坑指南 —— 警惕“免费试用”的自动扣费陷阱

许多云厂商或 API 聚合平台在注册初期会提供诱人的免费额度(Free Tier),前提是要求用户绑定信用卡。

实操建议: 传统 Chatbot 场景下,免费额度可能够用几个月;但在 Agent 的高并发、高频调用下,这些额度往往会在几天甚至几小时内被彻底抽干。一旦额度耗尽,系统通常会静默切换至高昂的标准计费模式。建议在测试阶段使用限制了单笔消费上限的虚拟信用卡,或者在控制台密切监控额度,并在试用期结束前主动移除支付方式,避免收到令人咋舌的次月账单。